机构名称:

¥ 1.0

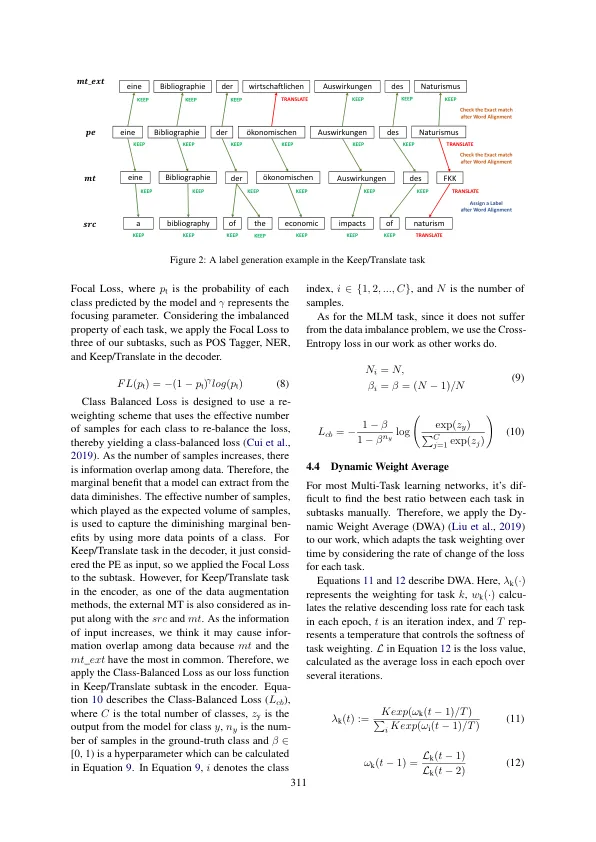

本文介绍了 Netmarble 提交的针对英语-德语语言对的 WMT21 自动后期编辑 (APE) 共享任务。首先,我们提出了一种训练阶段的课程训练策略。Facebook Fair 的 WMT19 新闻翻译模型被选中来参与大型且强大的预训练神经网络。然后,我们在每个训练阶段使用不同级别的数据对翻译模型进行后训练。随着训练阶段的进行,我们通过在不同训练阶段逐渐添加额外信息,让系统学会解决多项任务。我们还展示了一种将大量额外数据用于 APE 任务的方法。为了进一步改进,我们在微调阶段应用了动态加权平均的多任务学习策略。为了使用有限的数据对 APE 语料库进行微调,我们添加了一些相关的子任务来学习统一的表示。最后,为了获得更好的性能,我们在后训练和微调期间利用外部翻译作为增强机器翻译 (MT)。实验结果表明,我们的 APE 系统在开发数据集上显著提高了所提供的 MT 结果的翻译,TER 和 BLEU 分别提高了 -2.848 和 +3.74。它还证明了其在测试数据集上的有效性,质量高于开发数据集。

Netmarble AI 中心的 WMT21 自动后期编辑共享任务提交

主要关键词