机构名称:

¥ 1.0

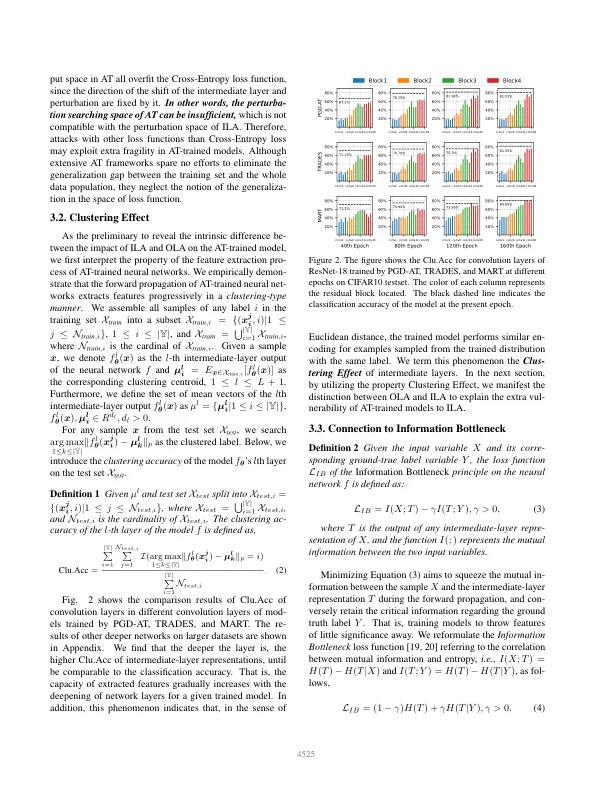

对抗训练(AT)是提高深度神经网络鲁棒性的最常用机制。最近,一种针对中间层的新型对抗攻击利用了对抗训练网络的额外脆弱性,输出错误的预测。这一结果说明对抗训练中对抗扰动的搜索空间不足。为了阐明中间层攻击有效的原因,我们将前向传播解释为聚类效应,表征神经网络对于与训练集具有相同标签的样本的中间层表示相似,并通过相应的信息瓶颈理论从理论上证明了聚类效应的存在。随后我们观察到中间层攻击违反了 AT 训练模型的聚类效应。受这些重要观察的启发,我们提出了一种正则化方法来扩展训练过程中的扰动搜索空间,称为充分对抗训练(SAT)。我们通过严格的数学证明给出了经过验证的神经网络鲁棒性界限。实验评估表明,SAT 在防御针对输出层和中间层的对抗性攻击方面优于其他最先进的 AT 机制。我们的代码和附录可以在 https://github.com/clustering-effect/SAT 找到。

从聚类效应角度解释神经网络的对抗鲁棒性

主要关键词