XiaoMi-AI文件搜索系统

World File Search System高质量发展 可持续未来

全力保障北京大兴国际机场首航运营:成为全球首家提供拥有自主知识产权“刷脸登机”自助值机设备的航空公司;全球首家提供无电池行李牌的航空公司,助力绿色智慧机场建设;首家与大兴机场确认交互数据、接入机场人脸数据的航空公司,开创民航人脸数据交互先河

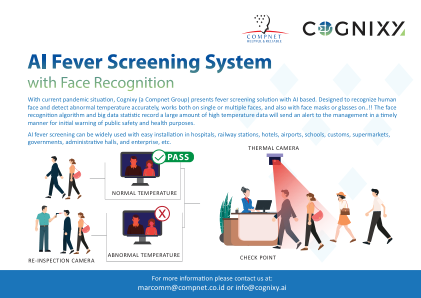

Camvi 发烧筛查系统 - cognixy.ai

鉴于当前的疫情形势,Cognixy(Compnet 集团旗下子公司)推出了基于人工智能的发烧筛查解决方案。旨在识别人脸并准确检测异常体温,既可以识别单张或多张脸,也可以在戴口罩或眼镜的情况下识别。!!人脸识别算法和大数据统计数据记录了大量的高温数据,将及时向管理层发出警报,用于初步警告公共安全和健康目的。

量子生成机器学习细节和指导

在开创性论文 [1] 和 [2] 中已开展和详述的工作的基础上,本项目的目的是弥合经典生成对抗网络 (GAN) 和量子生成对抗网络 (QGAN) 之间的差距,通过按照 [3] 中描述的工作生成图像形式的高维数据来合成真实数据(本工作中为图像)。此外,这项工作将研究我们是否可以在近期量子设备(即所谓的嘈杂中等规模量子 (NISQ) 设备)上实验实现真实世界图像的学习和生成,[3] 中提出的当前框架声称它们确实可以做到这一点。这项工作的第一部分将是利用 [1]、[2] 和 [3] 中提出的框架或类似框架,并应用它们来学习从开源人脸数据集(例如 Flickr-Faces-HQ (FFHQ) 或 CelebA,它们都是高质量的人脸图像数据集)中生成全分辨率的人脸图像。此外,还要研究使用量子电路作为生成器的 QGAN 是否可以在不进行降维或传统预处理/后处理的情况下成功生成人脸图像(由于颜色和不规则图像结构的存在,人脸图像是更复杂的图像类型)。这项工作的第二部分将涉及将生成的图像的输出与通过传统 GAN 生成的图像的输出进行比较,并研究 QGAN 方法与传统 ML 方法相比的效率如何。由于高效的量子算法可以解决线性方程,预计 QGAN 可以在比 GAN 更短的时间内学习数据分布。通过比较两种 ML 方法的效率,可以确定是否存在量子优势以及优势的程度。如果开发了任何新的量子算法,那么在设计阶段,人们通常会使用纸笔、非量子语言的 Python 研究代码,理想情况下,还会使用量子语言实现算法的某些部分,例如 IBM Quantum Lab 的 Qiskit 或 Xanadu 的 Pennylane 的量子计算开源框架,并提供 PyTorch 接口(参见 [4])。关键项目目标最初 3 个月 2024 年 1 月 1 日 – 2024 年 3 月 31 日

大脑——人工智能(个人语音助理)

语音助手的设计目的是让用户的工作更轻松。因为用户无需看屏幕就可以向他们发出命令。该系统最大的缺点是未经授权的用户可以访问机密数据,从而可能侵犯隐私。因此,用户数据的机密性、完整性和可用性 (CIA) 受到影响。针对这个问题,“人脸识别”的安全功能被设计成可以检测授权用户的脸部并将用户命令作为输入并通过合成语音提供响应。面部识别技术 (FRT) 是最具争议的新工具之一。它最早是在 20 世纪 60 年代开发的。最近它开始进入大众市场——无论是执法部门还是私人消费者。自动人脸识别涉及:

为视力有部分障碍的人提供的虚拟 AI 助手

摘要:如今,智能手机几乎可以帮我们完成每一项活动和任务。可以利用手机的功能和硬件来制作用于在线支付、内容消费和创作、可访问性等的应用程序。这些设备还可用于帮助和协助视障人士,并指导他们进行日常活动。由于视障人士有时难以感知周围的物体或人类,因此他们需要指导或帮助来识别物体、人脸、阅读文本和其他活动。因此,提出了这个 Android 应用程序来帮助和协助视力有部分障碍的人。该应用程序将利用人脸检测、对象和文本识别、条形码扫描仪和基本的语音聊天机器人等技术,可用于执行通过深度学习、人工智能和机器学习实现的基本命令。该应用程序将能够检测人脸数量,识别应用程序相机框架中的对象,从报纸、文档等中读出文本,并打开从条形码中检测到的链接,所有这些都以语音的形式输出给用户。

医学图像处理 II 计算机视觉和...

它是近年来计算机科学发展最快的领域之一,旨在使计算机能够像人类视觉系统一样理解和分析数字图像和视频。直到最近,计算机视觉还不具备很强的能力,但在许多领域取得巨大飞跃之后,计算机视觉的技术不断发展,在某些时候甚至超越了人类视觉的能力。计算机视觉具有多种任务,例如图像分析、图像处理和从图像中提取高维数据。因此,计算机视觉可用于许多应用,例如图像分类、对象识别、年龄估计、分析衰老对人脸的影响以及人脸验证等。

利用机器的情绪检测系统...

摘要本文介绍了一种基于实时检测、使用图像处理和人机交互的情绪检测系统。面部检测已经存在了几十年。再进一步,人类的表情可以通过视频、电信号或图像形式捕捉到,并被大脑感受到。通过图像或视频识别情绪对人眼来说是一项艰巨的任务,对机器来说也具有挑战性,因此机器检测情绪需要许多图像处理技术来提取特征。本文提出了一个具有人脸检测和面部表情识别(FER)两个主要过程的系统。本研究重点是识别面部情绪的实验研究。情绪检测系统的流程包括图像采集、图像预处理、人脸检测、特征提取和分类。为了识别这种情绪,情绪检测系统使用 KNN 分类器进行图像分类,使用 Haar 级联算法(一种对象检测算法)来识别图像或实时视频中的人脸。该系统通过从网络摄像头拍摄实时图像来工作。本研究的目的是建立一个自动面部情绪检测系统来识别不同的情绪,基于这些实验,系统可以识别出悲伤、惊讶、快乐、恐惧、愤怒等几种情绪。

全球人工智能 (AI) 专利统计分析简报

3.4 生物特征识别 3.4.1 指纹识别 3.4.2 人脸识别 3.4.3 虹膜识别 3.4.4 声纹识别 3.4.5 DNA识别 3.4.6 行为特征识别

特拉科人工智能

人工智能元数据丰富 Traco AI 使用机器学习和神经网络提供自动人脸识别搜索和字幕。通过与 Avid Interplay MediaCentral | CloudUX™ 和 Viz One 集成,Traco AI 可充当独特的服务器,与其他云解决方案相比,具有巨大的性能优势。借助 Traco AI,您现在可以自动丰富存档元数据,然后随时随地轻松地从庞大的存档(广播、体育、真人秀内容等)中搜索视频。此外,Traco AI 还会自动添加建议字幕,准确度极高。 应用程序功能: 人脸检测功能 Traco 的“AI Facer”搜索可根据眼睛和鼻子的独特生物特征信息自动识别人脸。然后,它会为检测到的人脸分配一个 ID,以便您可以搜索以该人为主角的视频内容。AI Facer 还允许您搜索同一场景中的人群。 快速搜索功能 得益于我们强大的可扩展节点系统,AI Facer 可以使用五个同时进行的进程,以比实时快 25 倍的速度扫描文件!自动介绍字幕功能 Traco AI 允许您将图形介绍字幕直接添加到直播中。数据库中的任何个人都具有基于其元数据的唯一 ID,因此在任何给定的广播中,Traco AI 都可以自动添加介绍字幕,包括该个人的姓名和头衔。自动 CC 生成功能 Traco AI 结合了语音到文本识别,允许自动生成隐藏式字幕 (CC)。使用 Traco AI,您还可以从识别的文本中提取关键字以改进视频搜索,并且语音元数据可以集成到 Avid MediaCentral、Viz One 等中。