XiaoMi-AI文件搜索系统

World File Search System第 80 号中央监视、控制、检查和维护 - 防卫自卫队

2022 年 3 月 31 日 — 零件编号或规格。所用设备的名称。组。名称 | 检查包装。交货地点。交货日期或施工期。2022 年 3 月 31 日星期四。公告第 68 号。2021 年 10 月 29 日。第 80 号中央监控控制检查和维护。

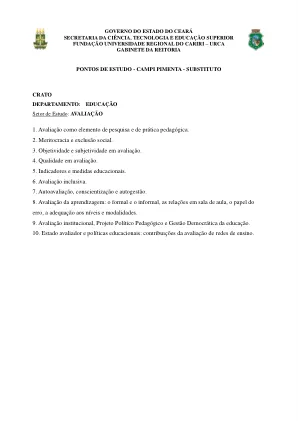

研究点

研究部门:药理学1。药代动力学(药物的吸收,分布和消除); 2。药效学(动作/反应,激动剂,拮抗剂,毒性); 3。心血管系统的临床药理学(抗高血压,心力衰竭治疗); 4。呼吸系统的临床药理学(COPD治疗和哮喘); 5。中枢神经系统I(阿尔茨海默氏症治疗,帕金森痴呆症,抗抑郁药和甘巴氏剂)的临床药理学6。中枢神经系统II的临床药理学(抗精神病药,抗焦虑药,镇静剂和催眠药)7。内分泌系统的临床药理学(糖尿病治疗 - 降血糖药物和胰岛素,甲状腺功能减退症和甲状腺功能亢进症); 8。骨骼肌系统的临床药理学(治疗骨质疏松症,胆碱能和抗胆碱能药物); 9。消化系统的临床药理学(治疗胃食管反流/溃疡肽,抗疾病和抗药性); 10。抗炎,皮质类固醇和阿片类镇痛药;

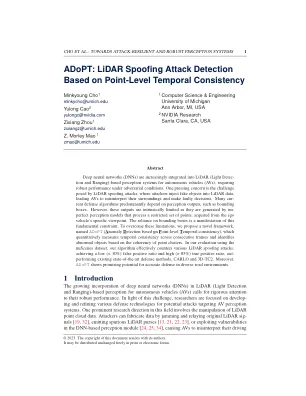

采用:基于点...

深度神经网络(DNN)越来越多地整合到LiDAR(灯光检测和范围)的自动驾驶汽车(AVS)的感知系统(AVS),在对抗条件下需要稳健的性能。一个紧迫的担忧是LiDAR SPOOFEF攻击所带来的挑战,在该攻击中,攻击者将假物体注入LiDAR数据中,导致AVS误解了周围的环境并做出错误的决定。许多经常出租防御算法主要取决于感知输出,例如边界框。但是,这些输出在本质上受到了限制,因为它们是由从自我车辆的特定视图中获得的一组限制点产生的。对边界框的依赖是这种基本约束的体现。为了克服这些局限性,我们提出了一个新的框架,称为采用(基于名称的基于d eTection o n p oInt级的t emporal一致性),该框架基于连续帧的时间一致性,并基于点簇的相干性来量身定量测量跨连续帧的时间一致性。在我们使用Nuscenes数据集的评估中,我们的算法有效地反驳了各种激光局部攻击,达到了低(<10%)的假阳性比率(<10%)的假阳性比(> 85%)真实的正比,超过了现有的现有的现有的先进防御方法,CARLO和3D-TC2。此外,采用在各种道路环境中表现出有希望的准确防御潜力。

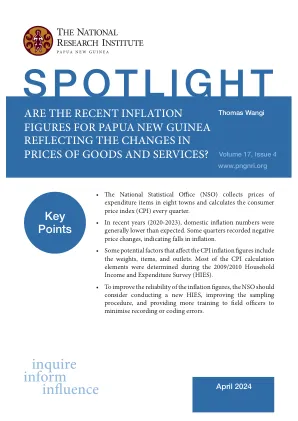

关键点

主要的障碍是缺乏广泛认可的公共数据源,这些数据源可以作为其主权方法的资产管理者的基础,从而确保跨解释的一致性,同时保持共同的方法论基础。相比之下,公司资产类别具有许多这样的来源,包括基于科学的目标计划,过渡途径计划和气候行动100+。今年,评估主权气候相关的机会和风险(ASCOR)项目发布了第一个国家数据库。IIGCC与市场从业人员进行了一个研讨会,专注于主要基于该数据库的准则,以及气候行动跟踪器(CAT)和气候变化绩效指数(CCPI)。作为主权资产的投资者,AXA IM积极参加了这些研讨会,从而发表了IIGCC在2024年中期评估净零净值的第一个准则。

分歧的干细胞机制,负责主体轴和附属物再生

此预印本版的版权持有人于2025年2月11日发布。 https://doi.org/10.1101/2025.02.11.637618 doi:Biorxiv Preprint

细菌核糖体中药物结合残基的进化分歧

摘要 针对细菌核糖体的药物在现代医学和兽医实践中被广泛用于治疗细菌感染和防止抗生素耐药性的传播。然而,大多数针对核糖体的药物研究仅限于少数模型生物。因此,我们不知道在模型细菌中观察到的核糖体药物结合位点是否像目前所暗示的那样在细菌中高度保守。在本研究中,我们使用一个简单但强大的计算流程来解决这个问题,该流程过滤掉罕见的变异和测序错误,以识别整个细菌生命树中核糖体药物结合位点的保守变化。这使我们能够评估来自 8,809 种细菌物种的 82 个细菌核糖体药物结合残基的保守性。对于这些残基中的每一个,我们追踪其在 40 多亿年的细菌历史中的进化。与核糖体药物结合残基高度保守的普遍看法相反,我们发现细菌门类在药物结合位点存在广泛的差异。此外,我们还发现,大约 10% 的细菌物种带有核糖体 RNA (rRNA) 替换,而这种替换此前仅在耐药细菌的临床分离株中观察到。总体而言,我们的工作表明,我们传统上将核糖体分为细菌和真核生物类型的方法过于简单且具有误导性,因为它忽略了广泛的谱系特异性变异,这些变异使得某些细菌的药物结合位点与大肠杆菌的差异比大肠杆菌与人类的差异更大。这些发现将对核糖体靶向抗生素的谱系特异性使用产生许多影响,这些抗生素目前被视为细菌蛋白质合成的通用抑制剂。

人工智能法案草案中的监管分歧——欧洲议会

虽然并非所有人工智能系统都对个人造成潜在危害,但公共和私营部门使用人工智能系统的例子都造成了直接或间接危害。问题是 AIA 是否以及如何减轻公共或私营部门人工智能造成的风险,以及它如何与欧盟法律的其他来源重叠或交织在一起。这项研究发现,公共和私营部门的人工智能使用之间存在风险趋同。随着服务提供商和用户之间的界限变得模糊,并且人工智能越来越成为“系统的系统”的一部分,对人工智能系统进行明确的风险评估将变得越来越具有挑战性。此外,该研究还记录了一般和部门监管方法之间的紧张关系(在适当的情况下)。AIA 提出了实现 AI 自我监管的程序步骤,与《通用数据保护条例》(GDPR)的设置非常一致,同时提出了实质性措施,例如禁止使用 AI 应用程序列表。该列表的治理和高风险应用程序或系统的分类可能会导致对 AI 系统的解读和发展产生分歧。此外,AIA 中提出的具体风险评估可能会导致风险分类产生分歧,例如,需要根据 GDPR 的要求对同一 AI 系统的数据进行风险评估。通过更好地协调数字(和基于 AI)系统的风险评估工作,可以实现监管一致性。