XiaoMi-AI文件搜索系统

World File Search System运动,气候变化和法律责任

作为体育界最有影响力和最有影响力的利益相关者,体育理事机构(尤其是国家机构)具有较高的责任,以确保他们以不会加剧问题的方式来确定并全面地管理气候变化的风险,而是导致缓解和适应解决方案。但是,我们对澳大利亚国家和州体育组织的气候反应的前314名的分析表明,这远非案件。附件H中详细规定的结果表明,截至2023年9月:

人工智能时代的法律责任

14 J. Henno, “1956: and artificial intelligence becomes a science”, Les Échos, August 2017, url> url>,在2024年1月4日。

NCO 的法律责任和权限限制

ELO:行动:编制一份 NCO 权力范围内的法律纪律方法清单。条件:作为学习者,参加 BLC,使用新环境中的直接领导视角,提供参考、实践练习和课堂讨论。标准:学习者将使用同行协作和评审,使用本课 80% 的内容,为他们的领导手册生成一份区分 NCO 权力类型、该权力的局限性和法律纪律方法的清单。学习领域:认知学习水平:了解未来运营环境的特征:

一种自动决策法律责任的工具

摘要。我们提出了SOID,这是一种使用基于SMT的自动推理来询问自主剂决策的工具。依靠Z3 SMT求解器和Klee象征性执行引擎,Soid al-Lows研究人员可以对有关代理行为的事实和反事实进行严格证明的答案,从而使有效的法律和工程责任制有害或其他错误的决策。我们在一对示例上进行定性和定量评估,i)从可解释的AI(XAI)文献中实现了经典决策树推理基准; ii)在类似的物理环境中发生车祸。对于后者,我们还贡献了Soid-GUI,这是一种基于领域的,基于网络的示例界面,用于法律和其他实践者,以指定事实和反事实查询,而无需复杂的编程或正式方法专业知识。

大型语言模型是否有法律责任说实话?

粗心的言论是一种由大型语言模型(LLM)造成的新型伤害,它在民主社会中构成了累积,长期风险,对科学,教育和共享的社会真理。llms产生合理,有益和自信的回答,但其中包含事实上的不准确性,误导性参考和有偏见的信息。这些微妙的误解有望随着时间的流逝而累积地降解和均质知识。本文探讨了LLM提供商创建“说明真相”的模型的法律义务的存在和可行性。我们认为,应要求LLM提供者通过开放的民主进程来减轻粗心的言论,并更好地与真理保持一致。我们在LLM中对“地面真理”的粗心言论定义,以及相关风险,包括幻觉,错误信息和虚假信息。我们评估了欧盟人权法和《人工智能法》,《数字服务法》,产品责任指令和人工智能责任指令中与真理相关的义务的存在。当前的框架包含有限的特定部门的真实职责。利用科学和学术界的职责,教育,档案和图书馆,以及一个德国案件,在该案件中,Google对由自动完整造成的诽谤责任负责,我们提出了一条途径,为狭窄和通用的LLMS提供者建立法律真理义务。

法律责任和对成果的道德考虑因素在商业运营中驱动的结果holzhausen 1

本文批判性地研究了人工智能(AI)的整合到业务运营中,重点是法律问责制和道德考虑的挑战。它首先追溯了AI的发展及其对商业的变革性影响,为研究关键的道德和责任挑战提供了基础。本文提出了研究结果,这些研究结果强调了为AI产生的结果分配责任的复杂性,并讨论了AI的国家和国际法律框架中的不同方法。它强调需要明确的法律结构和道德准则来管理AI在商业和社会中的作用。本文结论是通过强调协调的全球框架的重要性,以确保AI负责任的整合,并涉及理论和政策含义。调查结果表明,由于AI,法律趋势和社会影响发生了重大变化,并强调了迫切需要道德部署以防止社会偏见加强。

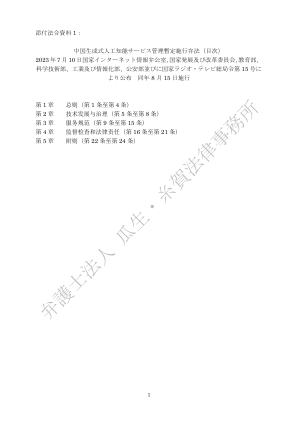

中国人工智能服务管理暂行办法2023(目录)...

第 3 章 服务规范 (第 9 条 至 第 15 条) 第 4 章 监督检查和法律责任 (第 16 条 至 第 21 条) 第 5 章 附 则 (第 22 条 至 第 24 条)

APT32F1023 数据手册V1.9

本资料内容为深圳市爱普特微电子有限公司在现有数据资料基础上慎重且力求准确无误编制而成,本资料中所记载的实例以正确的使 用方法和标准操作为前提,使用方在应用该等实例时请充分考虑外部诸条件,深圳市爱普特微电子有限公司不担保或确认该等实例在 使用方的适用性、适当性或完整性,深圳市爱普特微电子有限公司亦不对使用方因使用本资料所有内容而可能或已经带来的风险或后 果承担任何法律责任。基于使本资料的内容更加完善等原因,公司保留未经预告的修改权。

电池回收的材料研究

这项工作是作为由美国政府机构赞助的工作的帐户准备的。既不是对准确性,完整性或任何第三方使用或任何信息,或者使用任何信息,代理商,生产者或未披露的使用权限的保证,或承担任何法律责任或责任,或承担任何法律责任或责任,或者承担任何法律责任或责任,或承担任何信息,或者使用任何信息,或者使用任何信息,这些信息,代理商,生产者或未披露其使用权的权限,或者没有任何法律责任,或承担任何法律责任或责任。 以此处参考任何指定商业产品,流程或服务,商标,商标,制造商或其他方式不一定构成或暗示其认可,建议或受到美国政府或其任何机构或其承包商或其承包商或分包商的认可。 本文所表达的作者的观点和意见不一定陈述或反映美国政府或其任何机构,其承包商或子拖拉机的观点和意见。既不是对准确性,完整性或任何第三方使用或任何信息,或者使用任何信息,代理商,生产者或未披露的使用权限的保证,或承担任何法律责任或责任,或承担任何法律责任或责任,或者承担任何法律责任或责任,或承担任何信息,或者使用任何信息,或者使用任何信息,这些信息,代理商,生产者或未披露其使用权的权限,或者没有任何法律责任,或承担任何法律责任或责任。以此处参考任何指定商业产品,流程或服务,商标,商标,制造商或其他方式不一定构成或暗示其认可,建议或受到美国政府或其任何机构或其承包商或其承包商或分包商的认可。本文所表达的作者的观点和意见不一定陈述或反映美国政府或其任何机构,其承包商或子拖拉机的观点和意见。