XiaoMi-AI文件搜索系统

World File Search Systemquizartinib用于新诊断的FLT3-ITD阳性急性髓样白血病的诱导,合并和维持治疗

缓解,这意味着试验的随机化被打破。EAG进行了幼稚的ML-NMR比较,该比较表明,在公司的ML-NMR中应用的人口调整比Midostaurin相比,尤其是在累积的Rellapse分析中。委员会指出,两种间接治疗比较的大多数结果均未显示Quizartinib比Midostaurin的统计学显着改善,除了MAIC结果是复发的累积发生率。一位临床专家说,通常很难解释总体生存结果,因为有很多因素需要考虑。他们说复发率是最重要的结果。他们补充说,与Midostaurin相比,Quizartinib的复发速率可能较低,因为它是针对FLT3-ITD突变的。委员会得出的结论是,两种间接治疗比较的结果都高度不确定。但它

调查机器学习和自然语言处理技术用于检测饮食失调:系统文献评论

自然语言处理(NLP)和机器学习(ML)领域的最新发展已显示自动文本处理的显着改进。同时,人类语言的表达在发现心理健康问题中起着核心作用。虽然口语在接受患者的访谈中被隐式评估,但书面语言也可以为临床专业人员提供有趣的见解。现有的工作中经常研究心理健康问题,例如抑郁或焦虑。然而,还在研究饮食失调的诊断如何从这些新技术中受益。在本文中,我们介绍了该领域最新研究的系统概述。Our investigation encompasses four key areas: (a) an analysis of the metadata from published papers, (b) an examination of the sizes and speci fi c topics of the datasets employed, (c) a review of the application of machine learning techniques in detecting eating disorders from text, and fi nally (d) an evaluation of the models used, focusing on their performance, limitations, and the potential risks associated with current methodologies.

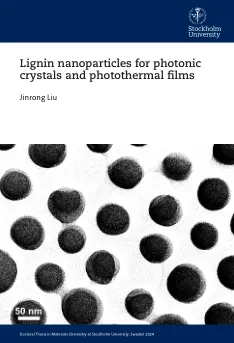

木质素纳米颗粒用于光子晶体和光热膜Jinrong liu

摘要,由于基于化石的材料引起的环境问题,从生物基础资源中开发了可持续材料。木质素是一种化学复杂的生物聚合物,存在于血管植物的木质组织中。木质素具有许多有用的特性,例如抗氧化活性,热稳定性,紫外线吸收性,刚度等。然而,木质素的固有挑战与其复杂的分子结构以及在水和常见溶剂中的溶解度差有关。一种利用木质素的一种策略是制造木质素纳米颗粒(LNP),以在水中产生胶体稳定的分散体。本论文旨在开发基于LNP的材料,这些材料可用于光子晶体和光热膜用于节能功能材料。论文的第一部分重点是阐明在LNP-Photonic Crystal(L-PC)的离心辅助组装过程中发生的现象。L-PC。在后续工作中,开发了一种改进的方法来提高L-PC的产量。研究了诸如初始木质素浓度以及稀释时间对粒径和稀释时间的影响,并研究了形成的LNP的PDI。经验模型以预测LNP的大小,并成功用于控制L-PC的颜色。此外,研究了L-PC的纳米结构。LNP-Chitosan膜和涂料并将其应用于室内热管理。将LNP含量从10到40 wt%调节。在论文的第二部分中开发了木质素吸收太阳能(光波长:250–2500 nm),基于LNP的复合膜和具有光热性能的涂层的能力。通过合并LNP,与纯壳聚糖膜相比,膜的机械强度和光热性能得到了改善。此外,通过使用LNP作为还原剂制备LNP-Silver-Chitosan(CC-AG@LNP)膜。用紫外线辅助在LNP的表面降低了银离子,并使用杂交纳米颗粒来通过铸造来制备膜。CC-AG@LNP膜表现出改善的湿势,并针对大肠杆菌表现出抗菌性能(灭菌作用> 99.9%)。总的来说,本文既有助于木质素聚集的基本见解,又有助于胶体颗粒的胶合颗粒,并展示了控制其组装并掺入具有附加功能的宏观材料中的方法。

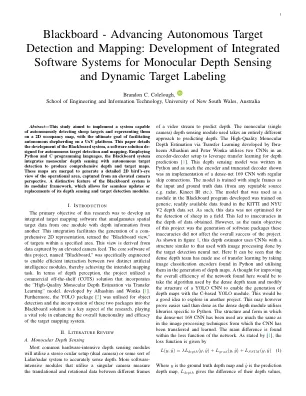

黑板 - 前进的自主目标检测和映射:开发用于单眼深度感应和动态tar

摘要 - 该研究旨在实施能够自主检测绵羊目标并在2D占用图上代表它们的系统,其最终目标是促进在UXV平台上自主牧羊。本文详细介绍了Blackboard System的开发,Blackboard System是一种用于自动目标检测和映射的软件解决方案。使用Python和C编程语言,Blackboard系统将单眼深度感测与自主目标检测,以产生全面的深度和目标图。这些地图是合并的,以产生从高架相机的角度捕获的操作区域的详细的2D鸟视图。黑板系统的独特功能是其模块化框架,它允许无缝更新或更换其深度传感和目标检测模块。

用于增强癌症免疫治疗的多种药物输送系统:概述

尽管免疫治疗具有明显的优势,但仍存在不可避免的脱靶效应,导致严重的不良免疫反应。近年来,药物递送系统(DDS)的研究和开发日益受到重视。在几十年的发展中,DDS已显示出以精确靶向的方式递送药物以减轻副作用的能力,并具有灵活控制药物释放、改善药代动力学和药物分布的优势。因此,我们认为将癌症免疫治疗与DDS相结合可以增强抗肿瘤能力。在本文中,我们概述了癌症免疫治疗中最新的药物递送策略,并简要介绍了基于纳米载体(脂质体、聚合物纳米胶束、介孔二氧化硅、细胞外囊泡等)和偶联技术(ADC、PDC和靶向蛋白质降解)的DDS的特点。我们的目的是向读者展示不同免疫机制下的各种药物递送平台,并分析它们的优势和局限性,为癌症免疫治疗提供更优越、更准确的靶向策略。

selpercatinib用于先前治疗的RET融合阳性晚期非小细胞肺癌

•与其他治疗方法相比,它的工作效果如何?•风险或副作用是什么?它们的可能性有多大?•治疗将如何影响我的日常生活?•如果治疗不起作用会发生什么?•如果我不想接受治疗会发生什么?是否还有其他治疗

利用数字技术用于伊博语言开发耶利米·安妮·恩纳·恩南·埃纳·埃博尼州,艾巴卡利基耶利米。

利用数字技术为伊博语言开发耶利米·安妮·安妮·安妮·安妮·埃纳尼·埃比尼州,阿巴卡利基耶利米jeremiah.nwankwegu@ebsu.edu.edu.edu.edu.ng摘要数字技术彻底改变了沟通,教育和文化保存,并为非葡萄酒提供了诸如非葡萄酒的开发机会。本文探讨了如何利用各种数字技术,包括移动应用程序,社交媒体平台,电子学习平台,人工智能以及诸如虚拟现实和增强现实等沉浸式技术,以促进和维护伊博语。通过检查现有的数字资源,例如语言学习网站,交互式应用程序和数字词典以及成功的计划,本研究表明了这些工具可以增强语言学习和文化参与的潜力。此外,它解决了诸如Internet访问,设备可用性和财务限制之类的挑战,提出了解决方案,例如扩大宽带基础设施,提供低成本设备以及确保多样化的资金来源。未来的方向强调了新兴技术,战略合作和可持续方法的重要性,以确保伊博语的充满活力和持久的未来。本文以呼吁利益相关者的呼吁进行了呼吁,包括教育机构,科技公司,政府和社区团体,以协作促进一个具有数字授权的生态系统,以支持数字时代的IGBO语言的持续活力。数字技术彻底改变了我们交流,学习和互动的方式。引言在21世纪,数字技术彻底改变了我们在全球范围内传达,学习和保存语言的方式。随着全球社区通过互联网和社交媒体越来越互动,已经出现了新的机会,以支持Igbo等世界少数族裔语言的发展和促进。如果利用,数字工具和平台,语言爱好者,教育者和社区的力量可以共同努力,以确保伊博语不仅生存,而且在现代时代蓬勃发展。从在线语言课程和交互式应用程序到虚拟文化交流和多媒体内容创建,利用技术推进Igbo语言发展的可能性是巨大而令人兴奋的。本文探讨了可以通过战略性地利用数字技术来振兴伊博语,加强其在母语中的使用的各种方式,并将其引入伊博散居者内外的新一代学习者。拥抱技术的变革潜力可以帮助我们在伊博语言保存和成长的故事中写下新篇章,并确保其在数字时代及以后的充满活力的存在。数字技术的定义和范围是指生成,存储或处理数据的电子工具,系统,设备和资源(Johnstone,Kervin和Wyeth,2023年)。这些技术包括广泛的应用程序,包括但不限于计算设备,通信工具和软件应用程序。它为语言发展和保存提供了新的可能性。数字技术的范围很广,涵盖了从基本硬件和软件到人工智能(AI)和虚拟现实(VR)的高级创新的所有内容。igbo语言的概述伊博语是尼日利亚所说的主要语言之一,主要是该国东南部地区的伊博人。它属于尼日尔 - 戈语言家族,该家族是世界上最大的语言家族之一。

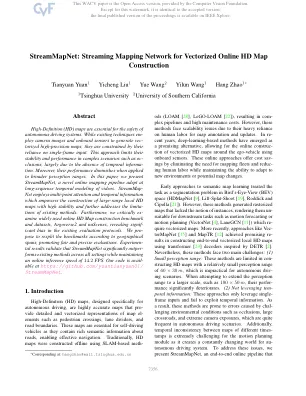

流媒体:流媒体映射网络用于矢量化的在线高清构造

高清(HD)地图对于自动驾驶系统的安全至关重要。虽然现有技术启用了相机图像和板载传感器以生成对高精度地图的审核,但它们受到对单帧输入的依赖的限制。这种方法限制了它们在诸如OCClusions之类的复杂情况下的稳定性和性能,这主要是由于缺乏时间信息。此外,当应用于更广泛的感知范围时,它们的性能会降低。在本文中,我们介绍了流媒体,这是一种新颖的在线映射管道,擅长于视频的长期时间建模。流媒体网络采用了多点的关注和时间信息,可以使大型本地高清图的构建具有高稳定性,并进一步解决了现有方法的限制。此外,我们严重地使用了广泛使用的在线HD MAP构造基准和数据集,Argoverse2和Nuscenes,在现有评估协议中揭示了显着的偏见。我们根据地理跨度来启动基准,从而促进公平而精确的评估。实验结果验证了流媒体网络在所有设置中都显着超过现有方法,同时保持在线推断速度为14。2 fps。我们的代码可在https://github.com/yuantianyuan01/ streammapnet上使用。

用于合成和分析高级功能层和涂层的电化学方法

他获得了博士学位。学位于2010年,在:化学技术与冶金学大学(UCTM) - 索菲亚(Bulgaria)的硅酸盐技术,结合材料和高温可融合的非金属材料领域的领域。 他的博士学位论文的标题为:“纳米复合材料混合涂料的调查和评估以保护腐蚀”。 他获得了硕士学位 在2004年获得UCTM – Sofia的冶金学和材料科学学院的化学工程学位,具有硅酸盐材料的专业,其论文的标题是:详细和表征带有perovskite结构的红色陶瓷色素,在Uji - Castellon(Spain)也呈现。 他的学士学位 论文于2002年在同一所大学发表,并致力于:“通过固定的光敏剂对饮料水进行灭菌”。 如今,他是8本书的作者,以及70多个出版物(H-Index 13和660引用),与先进的腐蚀保护系统,陶瓷材料回收,喷雾热解合成和陶瓷传感器元素有关。他获得了博士学位。学位于2010年,在:化学技术与冶金学大学(UCTM) - 索菲亚(Bulgaria)的硅酸盐技术,结合材料和高温可融合的非金属材料领域的领域。他的博士学位论文的标题为:“纳米复合材料混合涂料的调查和评估以保护腐蚀”。他获得了硕士学位在2004年获得UCTM – Sofia的冶金学和材料科学学院的化学工程学位,具有硅酸盐材料的专业,其论文的标题是:详细和表征带有perovskite结构的红色陶瓷色素,在Uji - Castellon(Spain)也呈现。 他的学士学位 论文于2002年在同一所大学发表,并致力于:“通过固定的光敏剂对饮料水进行灭菌”。 如今,他是8本书的作者,以及70多个出版物(H-Index 13和660引用),与先进的腐蚀保护系统,陶瓷材料回收,喷雾热解合成和陶瓷传感器元素有关。在2004年获得UCTM – Sofia的冶金学和材料科学学院的化学工程学位,具有硅酸盐材料的专业,其论文的标题是:详细和表征带有perovskite结构的红色陶瓷色素,在Uji - Castellon(Spain)也呈现。他的学士学位论文于2002年在同一所大学发表,并致力于:“通过固定的光敏剂对饮料水进行灭菌”。如今,他是8本书的作者,以及70多个出版物(H-Index 13和660引用),与先进的腐蚀保护系统,陶瓷材料回收,喷雾热解合成和陶瓷传感器元素有关。

svgeditBench:用于定量评估LLM SVG编辑功能的基准数据集

文本到图像模型近年来已显示出进展。随着这一进展,从文本中生成向量图也已提出。svg是向量图形的流行效果,SVG代表带有XML文本的场景。因此,大型语言模型可以直接处理SVG代码。考虑到这一点,我们专注于使用LLMS编辑SVG。用于定量评估LLMS编辑SVG的能力,我们提出了SVGeditBench。svgeditBench是评估LLMS编辑SVG代码能力的基准。在提议的基准下进行评估时,我们还显示了GPT-4和GPT-3.5结果。在实验中,GPT-4在定量和质量上都显示出与GPT-3.5的优势。该数据集可在https://github.com/mti-lab/svgeditBench上找到。