XiaoMi-AI文件搜索系统

World File Search System利用人源化单克隆抗体靶向 CA 19-9

手术切除术在预防肿瘤复发方面具有巨大潜力。这种信念源于一个不容置疑的事实:尽管对于可切除的胃肠道癌症患者来说,手术切除仍然是延长总生存期 (OS) 和潜在治愈的唯一机会,但由于远处复发,这一终点很少实现。例如,对随机前瞻性试验数据和单机构系列的分析强烈表明,在切除肿瘤后 12-15 个月内,接受胰腺癌、胆管癌和转移性结直肠癌切除术的所有患者中,近一半会出现疾病复发 (1-3)。换句话说,这些患者接受手术可能是为了缩短生存期。

SciELO 网络上研究交流中使用人工智能工具和资源的指南

编辑有责任进行适当的科学审查,确保已发表科学文献的质量和完整性。为此,他们必须接受培训,并能使用最新的工具和资源,以方便检测人工智能生成或修改的内容。编辑们应避免提供错误信息,因为这可能会带来不利后果,并对个人造成潜在伤害。

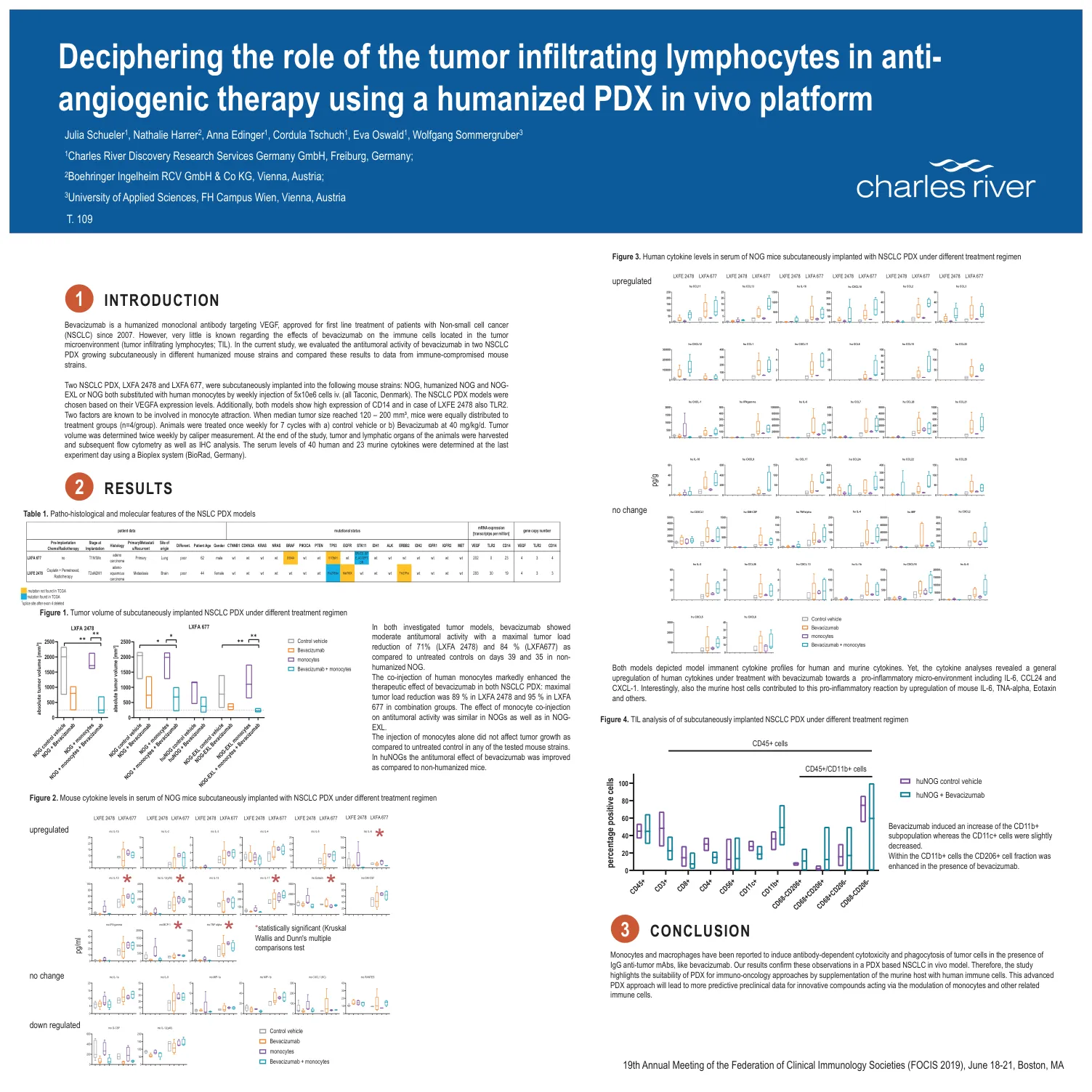

使用人源化PDX在体内平台中使用血管生成疗法

将两个NSCLC PDX,LXFA 2478和LXFA 677皮下植入以下小鼠菌株中:NOG,人源化NOG和NOG-EXL或NOG或NOG均通过每周的5x10E6细胞IV的每周损伤而被人类单核细胞取代。(所有Taconic,丹麦)。根据其VEGFA表达水平选择NSCLC PDX模型。此外,这两个模型均显示CD14的高表达,而在LXFE 2478的情况下也显示了TLR2。已知两个因素参与单核细胞吸引力。当中位肿瘤大小达到120 - 200mm³时,小鼠平均分布到治疗组(n = 4/组)。每周用a)对照车辆或b)贝伐单抗以40 mg/kg/d治疗7个周期的动物。肿瘤体积每周两次确定。在研究结束时,收集动物的肿瘤和淋巴器官,随后流式细胞仪以及IHC分析。使用Bioplex系统(德国Biorad)确定了在最后一个实验日确定40种人和23种鼠细胞因子的血清水平。

奥林匹克坝电力连接......

占用人必须允许 BHP 安全、不受阻碍地进入现场,以进行任何与提供电力服务有关的目的,包括完成和维护与现场的电力连接、读取任何仪表、在现场安装任何必要的设备以及对装置进行任何检查、检验或测试(TIR)。 4. 安全工作程序 4.1 未经 BHP 事先书面批准,占用人不得在装置上进行或安排进行任何电气工作(TIR)。 4.2 占用人必须实施、维护和遵守任何适用法律要求占用人遵守的任何安全程序(TIR)。 4.3 占用人及其任何雇员、代理人、承包商或受邀者必须遵守 BHP 不时通知的所有安全程序(TIR)。

文章 在不同建筑类型中使用人工智能算法实现智能建筑的节能

摘要:建筑物的供暖和制冷系统占总能耗的重要组成部分。欧盟的指令和承诺激励建筑业主和能源和建筑行业的相关利益相关者通过最大限度地利用可再生能源、信息和通信技术和自动化系统,实现净零能耗建筑。然而,建筑物翻新、就地使用可再生能源生产以及在中小型建筑中安装昂贵的信息和通信技术基础设施和自动化系统的高投资成本是欧盟建筑指令在中小型建筑中广泛采用的主要障碍。另一方面,在不同建筑物之间共享计算和数据存储资源的概念可以成为实现智能建筑和智能城市的替代方法,其中主要控制权位于服务器上。与其他专注于在建筑物或具有本地处理资源和数据存储的独立建筑物中实施 AI 技术的研究不同,本研究使用企业服务器来控制三种建筑类型的供暖系统,并研究在统一的节能平台中控制现有建筑的潜在好处。本研究的主要发现是,尽管 COVID-19 措施要求建筑物频繁通风,即使在使用旧式供暖系统的情况下,纳入所提系统的 AI 算法仍实现了约 20-40% 的显著节能,无论建筑类型、建筑功能和供暖系统类型如何。

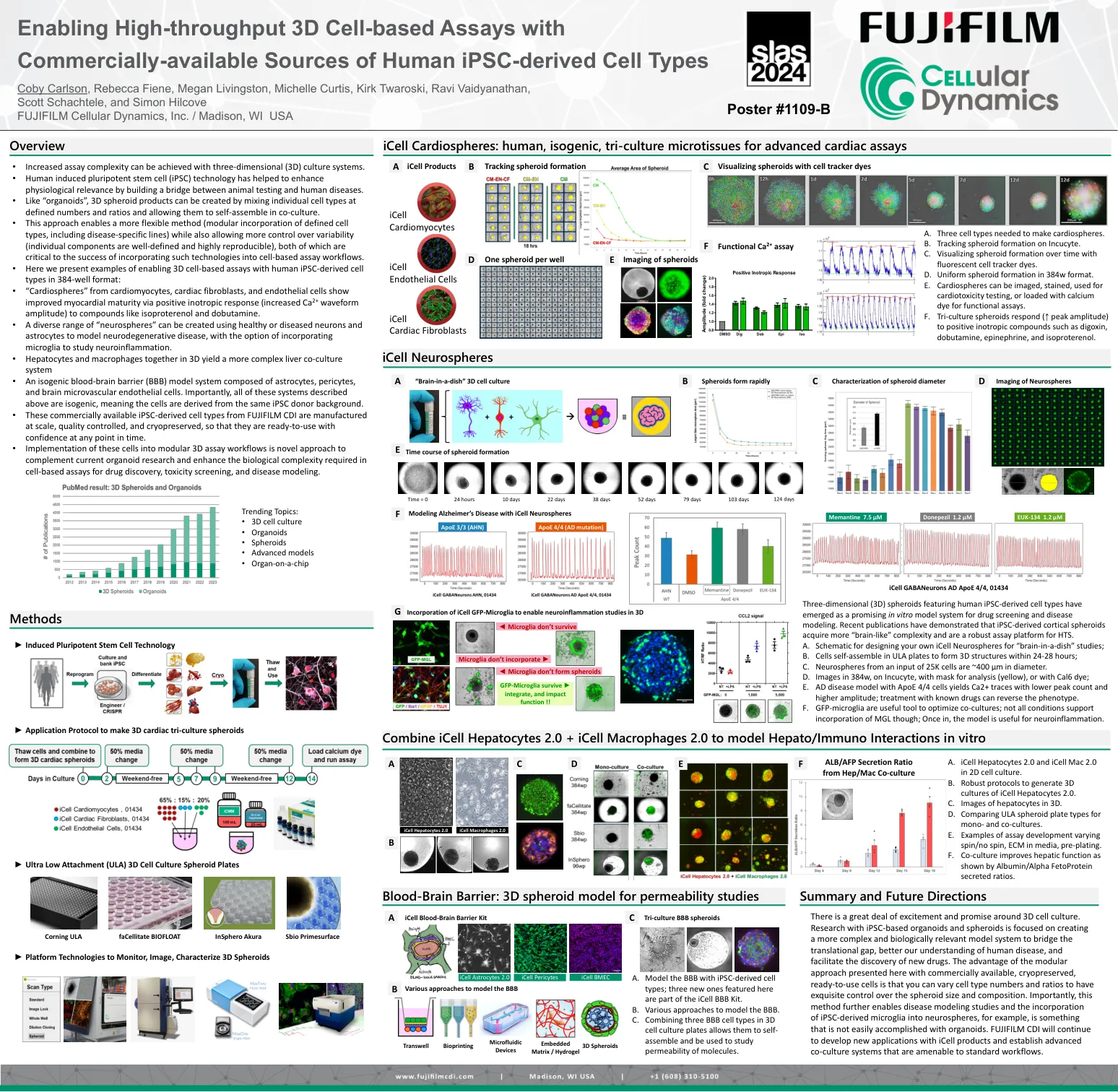

使用人IPSC衍生的细胞类型的商业可用来源启用高通量3D细胞的测定

具有人IPSC衍生细胞类型的三维(3D)球体已成为一种有希望的药物筛查和疾病模型的体外模型系统。最近的出版物表明,IPSC衍生的皮质球体具有更大的“大脑般”复杂性,并且是HTS的强大测定平台。A.示意图,用于设计自己的ICELL神经球,用于“脑中的大脑”研究; B.细胞在ULA板上自组装,在24-28小时内形成3D结构; C.来自25K细胞输入的神经球直径约为400 µm。D. 384W中的图像,在incucyte上,带有掩模用于分析(黄色)或cal6染料; E.具有APOE 4/4细胞的AD疾病模型产生峰值计数较低和幅度较高的Ca2+痕迹。已知药物的治疗可以逆转表型。F. GFP-Microglia是优化共培养的有用工具;但是,并非所有条件都支持纳入MGL;一旦进入,该模型对于神经炎症很有用。

调查有关使用勘测授权的投诉——亨特天然气管道报告给气候变化、能源、环境

(a) 条件 4 - HGP 作为权力机构的持有者,在使用权力机构的权力之前,必须尝试进行合理程度的谈判和/或沟通。HGP 必须在向土地所有者或占用者发出书面通知,表示有意进入权力机构权力范围内的土地之前,向部门证明这一点。 (b) 条件 8 - HGP 作为权力机构的持有者,必须尽合理努力解决与土地所有者或占用者在遵守权力机构条件方面的争议。应土地所有者或占用者和/或 HGP 的要求,部门将确定争议的有效性。部门将审查并提供解决方案指导。 (c)条件 12 - HGP 作为管理局的持有人(或其代理人),不得告知任何土地的所有者或占用人其土地可能被强制征用,除非所有者或占用人同时被告知征用必须经部长批准,且所有者或占用人能够在部长就此事作出任何决定之前陈述反对征用的理由。

产品专着,包括患者...

该产品是使用人血的成分制造的,该血液可能含有肝炎和其他病毒疾病的病因。通过使用人血或血浆制备的药物产生的药物导致感染的标准措施,包括选择供体,筛查单个捐赠和血浆池,以进行特定的感染标记以及包括病毒灭活/去除的有效制造步骤。尽管如此,当施用由人血或血浆制备的药物时,不能完全排除传播感染剂的可能性。这也适用于未知或新兴病毒和其他病原体。