XiaoMi-AI文件搜索系统

World File Search System婴儿发声与身体动作相一致

图 2 发声过程中运动的时间特性变化。(a)每个年龄组在发声前 3 秒开始并在发声后 3 秒结束的身体运动中位旋转速度的 z 分数。垂直实心黑线表示发声的开始,而垂直阴影区域表示该年龄组的发声持续时间中值。(b)每个年龄组在发声前 3 秒开始并在发声后 3 秒结束的身体运动中位旋转速度。垂直实心黑线表示发声的开始,而垂直阴影区域表示该年龄组的发声持续时间中值。水平阴影区域表示自举 95% 置信区间,黑线表示中值。红色中值区域表示旋转速度超出自举显着性检验界限的时间点。(c)发声前、发声中和发声后的中位身体速度。发声前后时间段的中位数与发声持续时间相同。误差线表示自举的 95% 置信区间。星号表示 p < 0.0001 的显著性。

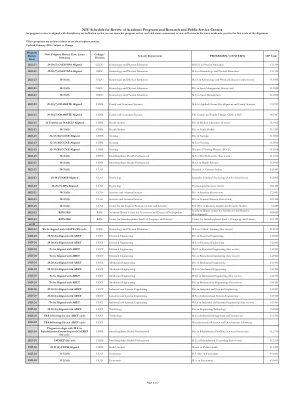

NIU 学术课程和研究及公共服务中心审查时间表 由于课程审查与学科认证周期相一致

NIU 学术课程和研究及公共服务中心审查时间表由于课程审查与学科认证周期相一致,因此在极少数情况下,课程审查和中期状态评估审查将在协调的第一个周期的同一学年进行。

认知训练引起的激活变化与主观认知能力下降的老年人的认知储备改善相一致

功能性磁共振成像(fMRI)用于评估认知训练对大脑激活的影响,大脑激活是学习阶段和教育水平的函数。40 名患有主观认知衰退(SCD)的老年人接受了 6 次 1 小时的记忆训练,训练方式为位置法。在训练前(PRE)、3 次训练后(POST3)和 6 次训练后(POST6)的单词表编码和检索过程中测量了脑成像(N = 29)。无论受教育程度如何,参与者都表现出从 PRE 到 POST6 在编码过程中左侧下额叶前回激活增加,而从 PRE 到 POST3 在检索过程中双侧额叶纹状体激活减少。从 PRE 到 POST3,右侧颞叶两个区域的激活变化随受教育程度而变化:受教育程度较低的参与者激活增加,而受教育程度较高的参与者激活减少。受教育程度较低的人这些区域最初不太活跃。结果表明,受教育程度较低的人发生了战略转变,而受教育程度较高的人则积累了专业知识,同时恢复了与教育相关的初始差异。© 2022 作者。由 Elsevier Inc. 出版。这是一篇根据 CC BY-NC-ND 许可协议开放获取的文章(http://creativecommons.org/licenses/by-nc-nd/4.0/)

国际计划英国分部 (PIUK) 的承诺和优先事项与人道主义组织气候与环境宪章相一致。总体而言,国际计划

在新的 2022-2027 年全球战略中,气候变化被提升为一个跨领域主题,涵盖发展和人道主义行动。扩大人道主义规划工作仍然是 PIUK 的战略目标之一,重点关注性别平等,以及气候变化和环境恶化对儿童和女孩的影响。此外,PIUK 的重点仍将是减少灾害风险和增强抵御力,并增加认识到发展和人道主义规划之间相互关系(“纽带”)的工作。特别是,PIUK 将继续高度重视支持社区,使他们做好应对冲击的准备并具有抵御力。2. 最大限度地提高我们工作的环境可持续性,并迅速减少我们的温室气体排放

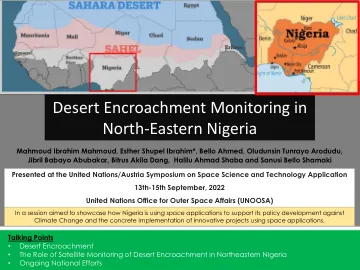

尼日利亚东北部沙漠侵蚀监测

虽然我们的NDVI轨迹模式结果与土地覆盖分析和统计结果相一致,但这一发现与其他研究的结果相一致,这些研究特别认为强化的农业活动是影响和加剧研究区荒漠化的主要因素。

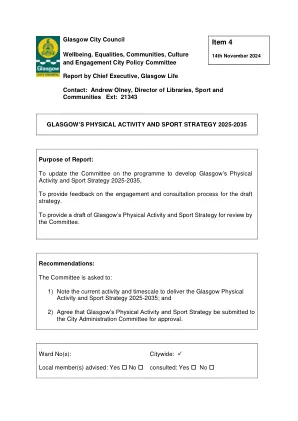

格拉斯哥市议会

摘要 战略审查强调了与体育活动和运动相关的众多地方、地区和国家关键政策和战略中所包含的明确和隐含的参考,并确定了这些政策是否支持新兴体育活动战略中阐明的关键优先事项。该研究表明,体育活动和运动在跨政策背景下对苏格兰人民做出了许多积极贡献,与苏格兰国家绩效框架、苏格兰公共卫生优先事项和苏格兰积极成果框架相一致。研究发现,与体育活动和运动相关的广泛政策之间存在强大的协同作用,这些政策与规划、交通、卫生和社会保健、经济发展、儿童和年轻人以及环境相一致。这些政策与格拉斯哥市议会战略计划的总体战略相一致,并且是其不可或缺的一部分。这种一致性为主要合作伙伴和利益相关者致力于增加人口参与体育活动和运动提供了强有力的证据,并证明了支持体育活动、运动和休闲的连贯叙述。战略审查清楚地表明了体育活动和运动战略的实施如何支持多个理事会和利益相关者政策的广泛政策。总之,格拉斯哥体育活动和运动战略的制定与地方、地区和国家政策和战略格局相一致。