XiaoMi-AI文件搜索系统

World File Search System沙子人工智能和人类自由中的一条线

即使在我们提倡的局限性范围内,在与刑事法律制度一样广泛的机制内部,AI仍然可以做很多事情。仅专注于审前空间:是的,我们的暂停将排除使用AI来决定拘留与释放的决策,但是该技术可以显着提高案例经理支持人们在获得基于社区的资源,服务和住房方面的能力。自然语言处理可以帮助总结案例笔记,法院文件和客户历史,而预测性则可以建议需要更紧急干预的客户。机器学习算法可以分析跨案例的模式,以建议针对单个客户需求量身定制的服务,同时保持人类的监督和敏感事项的决策。

镰状细胞:人类自然选择电影活动学生讲义

以下哪个语句最准确,并为支持相关索赔提供了有效的论点?a。权利要求1的论点:在一个人的红细胞中存在疟疾人寄生虫会触发镰状细胞等位基因形成。b。权利要求1的论点:蚊子唾液中的化学物质刺激红细胞中的镰状细胞等位基因。c。权利要求2的论点:在许多世代中,蚊子对杂合个体中存在的镰状细胞等位基因具有抵抗力。d。权利要求2的论点:当一个人出生并提供一些保护疟疾时,存在镰状细胞等位基因。

使用聚类自动编码器技术识别气候模式

摘要:在不同投影场景下,气候模拟的时空分辨率的复杂性产生了多种气候模式。本文通过一种无监督的深度学习技术提出了一种新的数据驱动的气候分类工作,该技术可以在尺寸上降低大量时空数值气候投影数据中的大量紧凑表示。我们旨在确定捕获多个气候变量的不同区域以及在不同气候变化方案下的未来变化。我们的方法利用卷积自动编码器与K-均值聚类(标准自动编码器)和在线聚类相结合,基于sindhorn - Knopp算法(群集自动编码器),整个Conterminous美国(CONUS)(CONUS)(CONUS)捕获来自数据驱动的气候型号的独特气候式的goldement offeration Androm intery Demplyicals todlement todlement todlemant througation dynerical offer -Gromys toym intery dynerical demancortial dynerical ofderational dynerical officolt offer。 (GFDL-ESM2G)。开发的方法在多个变暖方案下以0.125 8的0.125 8将70年的GFDL-ESM2G仿真压缩为较低维空间的空间分辨率为660000倍,然后在150年的GFDL-ESM2G仿真数据中测试了150年。结果表明,五个气候群体捕获了与人类专家定义的已知气候类别相匹配的物理合理和空间稳定的气候效果。结果还表明,与使用标准自动编码器相比,使用群集自动编码器可以将聚类的计算时间限制为9.2倍。我们五个独特的气候模式是由深度学习引起的 - 基于较低维空间的聚类,从而使我们能够在整个综合美国立即提供有关水力气学及其空间异质性的见解,而无需下载大量的大气候数据集。

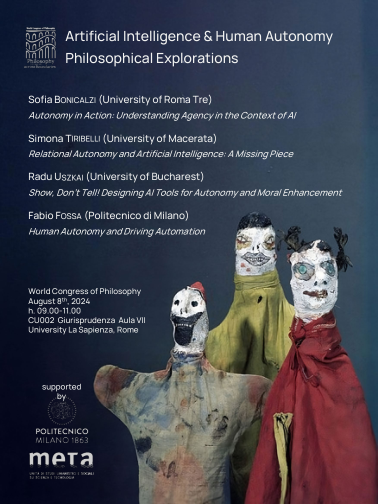

人工智能与人类自主哲学...

主体感是哲学和神经科学中一个激烈争论的话题,它指的是控制一个人的行为及其对外部世界的影响的主观体验。因此,主体感被认为是决策和行动中自主感和责任感的一个关键要素。研究表明,主体感受到诸如行动选择过程的流畅性、这些行动的结果以及其他个体的存在等因素的影响。最近,有几项研究探讨了与人工智能的互动如何影响主体感和自主感,特别是当涉及被认为具有自身意向性的设备时。虽然一些研究表明这些互动会削弱主体感,引发了对我们作为行为作者的体验的重要伦理考虑,但也有证据表明,当计算机辅助有限并允许人类主动时,主体感可以得到保留。在本文中,我将强调设计支持主体内部控制点的基于人工智能的系统的重要性。具体来说,我认为,尽管与人工智能设备的交互可以有效降低主动性,并可能对自主性产生不良影响,但允许人类主动性的平衡交互可以维持甚至提高我们的主动性,从而实现对环境的控制。

人类自主权受到威胁?来自……的挑战分析

摘要 自主性是一种核心价值,深深植根于许多社会的道德、法律和政治实践中。人工智能 (AI) 的发展和部署引发了有关 AI 对人类自主性影响的新问题。然而,对这些影响的系统评估仍然很少,而且通常是逐案进行的。在本文中,我提供了一个概念框架,它既将看似不相干的人类自主性问题联系在一起,也强调了它们之间的差异。在第一部分中,我区分了目前在“人类自主性”这一总称下解决的不同问题。特别是,我展示了如何区分作为真实性的自主性和作为代理的自主性,这有助于我们找出与 AI 部署不同的挑战。其中一些挑战已经众所周知(例如在线操纵或限制自由),而其他挑战则受到的关注较少(例如自适应偏好形成)。在第二部分中,我讨论了人工智能系统在自主性背景下可以承担的不同角色。特别是,我区分了承担代理角色的人工智能系统和被用作工具的人工智能系统。我的结论是,虽然没有“灵丹妙药”来解决对人类自主性的担忧,但考虑其各个维度可以帮助我们系统地解决相关风险。

一个新的实验范式来操纵人类自动化研究的风险

目的:两项研究可作为对新的实验多任务范式的操纵检查,该范式可以应用于人自动化研究(虚拟现实现实测试风险和自动化研究; VIRTRAS),在该研究中,可以将其作为虚拟现实环境的一部分操纵。背景:风险已被假定是影响人类自动化相互作用的重要上下文因素。然而,由于以道德方式进行了不同的操作风险,实验证据很少。在新范式中,风险因参与者执行任务的高度而异,包括在错误时实际上掉落的可能性。方法:使用主观的自我报告和客观措施,使用范式的关键组成部分来研究参与者在低(0.5 m)和高海拔(70 m)中的风险感知。结果:在高海拔条件下,风险感知显着较高,中等至较大的效应大小。此外,行为度量的结果表明,参与者的暴露时间习惯了。但是,在两个高度条件下,这种习惯似乎也同样发生。结论:操纵检查成功。新范式是自动化搜索的有前途的工具。它结合了风险的上下文因素,并创造了一种与现实生活中的经营者体验更可比的情况。此外,它还符合人类自动化研究中其他多任务环境的相同策略。应用:新的范式提供了改变人自动化研究中风险的背景因素的基础,该研究以前以前被忽略或以较低的方式进行操作。

信任机器智能:军事行动中的人工智能与人类自主协作

摘要 人工智能的不断进步使得军事系统的自主性水平更高。随着机器智能作用的不断扩大,人类与自主系统之间的有效合作将成为未来军事行动中越来越重要的一个方面。成功的人机自主协作 (HAT) 需要在机器智能中建立适当的信任水平,而这种信任水平会根据 HAT 发生的环境而有所不同。有关信任和自动化的大量文献,加上较新的关于军事系统自主性的研究,构成了本研究的基础。本研究研究了三类机器智能应用中信任的各个方面。这些包括数据集成和分析、所有领域的自主系统以及决策支持应用。每个类别中与适当校准信任水平相关的问题各不相同,信任不协调的后果和潜在的缓解措施也各不相同。

人工智能时代的人类自主性

当前的人工智能政策建议对人类自主性的风险各不相同。为了系统地应对自主性风险,我们需要面对概念本身的复杂性,并相应地调整治理解决方案。本文强调了自主性的两个不同维度——代理和真实性——并列出了人工智能部署可能影响每个维度的不同方式。最后但并非最不重要的是,本文讨论了一些政策挑战和影响。

使用卷积神经网络提高四类自愿想象 fNIRS 信号的分类准确率

多类功能性近红外光谱 (fNIRS) 信号分类已成为光学脑机接口的一种便捷方式。当信号由同一肢体的自愿和想象运动产生时,高精度的 fNIRS 信号分类是一项具有挑战性的任务。由于自愿和想象运动在时间和空间上的激活表现出相似的模式,传统浅层分类器的分类精度无法达到可接受的范围。本文提出了一种利用卷积神经网络 (CNN) 提高精度的方法。在这项工作中,几位参与者进行了自愿和想象手部运动(左手和右手)。这些四类信号是利用 fNIRS 设备获取的。根据任务分离信号并进行过滤。通过手动特征提取,使用支持向量机和线性判别分析对信号进行分类。CNN 的自动特征提取和分类机制被应用于 fNIRS 信号。从结果来看,CNN 将分类精度提高到了可接受的范围,这是任何卷积网络都无法实现的。