XiaoMi-AI文件搜索系统

World File Search SystemAI 开发者和部署者:重要的区别

正如隐私和安全法区分处理消费者个人数据的不同类型的公司一样,区分开发者和部署者可确保法律框架根据公司在 AI 生态系统中的角色准确地为其分配义务。因此,公司能够更好地履行这些义务并更好地保护消费者。例如,开发人员可以描述用于训练 AI 系统的数据的特征,但通常无法了解在另一家公司购买和实施 AI 系统后 AI 系统的使用方式。相反,使用该系统的部署者通常最有能力了解 AI 系统的使用方式、该使用是否符合其预期用途、是否以及如何纳入人工监督、AI 系统的输出、收到的任何投诉以及影响系统性能的现实因素。

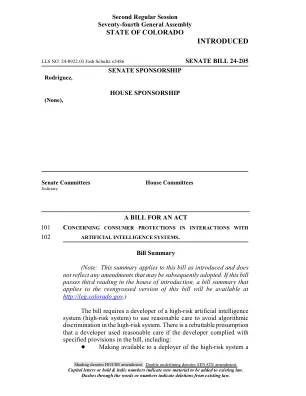

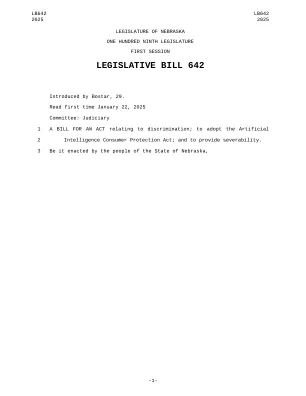

[FPF 幻灯片] 科罗拉多州人工智能法案

○ (i) 高风险人工智能系统在以下情况下继续学习:(a) 提供、出售、出租、许可、赠予或以其他方式提供给部署者;或 (b) 部署;○ (ii) 变更是……本节第 (10)(b)(i) 款所述的任何学习的结果;○ (iii) 当部署者或与部署者签约的第三方完成对此类高风险人工智能系统的初步影响评估时,该变更是由部署者或部署者签约的第三方预先确定的……;以及○ (iv) 该变更包含在高风险人工智能系统的技术文档中。

[FPF 立法] 政策简报:科罗拉多州人工智能法案

● 受监管实体的潜在范围更广:与通常适用于满足特定门槛的受监管实体的州数据隐私法不同,CAIA 适用于任何开发或部署高风险 AI 系统的个人或实体。此外,该法律的一部分适用于提供或部署面向消费者的 AI 系统的任何实体。 ● 特定角色的义务:CAIA 为部署者和开发者分配了特定角色的义务,类似于数据隐私制度下的控制者和处理者。部署者直接与个人互动并最终控制系统的使用方式,需要维护风险管理计划、进行影响评估并提供相关的消费者权利。另一方面,开发者必须提供部署者履行其职责所需的信息和文档。 ● 减轻算法歧视的注意义务:开发者和部署者有注意义务保护消费者免受算法歧视,这在实践中可能意味着 CAIA 的执行者将使用比例测试来评估开发者和部署者的行为。 “算法歧视”的定义似乎涵盖了故意歧视和差别影响。● 新型消费者权利:除了类似立法中常见的消费者权利(例如使用前通知权)外,如果高风险人工智能系统做出不利决定,CAIA 还为消费者提供了特殊权利。在这种情况下,部署者必须向消费者提供理由陈述、纠正权,并在可行的情况下上诉人工审查。● 总检察长权力:尽管 CAIA 没有创建私人诉讼权,但它赋予科罗拉多州总检察长执行法律和实施必要法规的重要权力。

重新定向 - 科罗拉多州大会|

声明披露有关高风险系统的指定信息;呢提供给高风险系统信息和文档的部署,以完成对高风险系统的影响评估所需的;呢制作公开陈述,总结了开发人员已经开发或有意,实质上修改的高风险系统类型,目前可以向部署者使用,以及开发人员如何管理算法歧视的任何已知或合理可预见的风险,这些风险可能是由开发或有意修改和实质性修改的这些高风险系统所产生的;和 !在发现或收到部署可信报告后的90天内,向高危系统的总检察长和已知的高风险系统披露,高风险系统已导致或合理造成的。该法案还要求高风险系统的部署者使用合理的护理来避免在高风险系统中算法歧视。有一个可反驳的假设,即如果部署者遵守法案中的规定规定,则部署者使用合理的护理,包括:!为高风险系统实施风险管理政策和计划;呢完成对高风险系统的影响评估;呢如果高危系统做出有关消费者的结果决定,请通知消费者指定项目;呢遵守联邦和州版权法的政策;和进行公开可用的声明总结了部署目前部署的高风险系统的类型,以及部署者如何管理任何已知或合理可预见的算法歧视风险。和 !在发现后的90天内,向总检察长发现算法歧视的发现,高风险系统已导致或合理地造成的算法歧视。需要通用人工智能模型(通用模型)的开发人员来为通用模型创建和维护指定的文档,包括:!

重新格罗斯 - 科罗拉多州大会|

声明披露有关高风险系统的指定信息;呢提供给高风险系统信息和文档的部署,以完成对高风险系统的影响评估所需的;呢制作公开陈述,总结了开发人员已经开发或有意,实质上修改的高风险系统类型,目前可以向部署者使用,以及开发人员如何管理算法歧视的任何已知或合理可预见的风险,这些风险可能是由开发或有意修改和实质性修改的这些高风险系统所产生的;和 !在发现或收到部署可信报告后的90天内,向高危系统的总检察长和已知的高风险系统披露,高风险系统已导致或合理造成的。该法案还要求高风险系统的部署者使用合理的护理来避免在高风险系统中算法歧视。有一个可反驳的假设,即如果部署者遵守法案中的规定规定,则部署者使用合理的护理,包括:!为高风险系统实施风险管理政策和计划;呢完成对高风险系统的影响评估;呢如果高危系统做出有关消费者的结果决定,请通知消费者指定项目;呢遵守联邦和州版权法的政策;和进行公开可用的声明总结了部署目前部署的高风险系统的类型,以及部署者如何管理任何已知或合理可预见的算法歧视风险。和 !在发现后的90天内,向总检察长发现算法歧视的发现,高风险系统已导致或合理地造成的算法歧视。需要通用人工智能模型(通用模型)的开发人员来为通用模型创建和维护指定的文档,包括:!

报告和建议 - 科罗拉多州议会 |

• 就“算法歧视”定义(CRS 第 6-1-1701(1) 节)拟议修改达成共识,可能取决于涉及 CRS 第 6-1-1702(1) 节和 CRS 第 6-1-1703(1) 节的棘手问题有多么棘手,其中行业和公共利益团体对开发者和部署者在防止算法歧视方面应承担哪些义务以及如何执行这些义务存在严重分歧。 • 如果能就影响评估的固定间隔达成共识,那么对“故意和实质性修改”定义的拟议修改可能会变得无关紧要。 • 利益相关者是否愿意接受对公司必须向司法部长 (AG) 提供信息的条款的拟议修改,可能取决于是否做出其他修改,包括法律的直接面向消费者的披露和解释条款,并应与 AG 办公室协商考虑。 • 对部署者风险管理计划要求的拟议变更可能会与对部署者影响评估义务的拟议变更一起考虑。

帐单 - 介绍-CORODADO.GOV

声明披露有关高风险系统的指定信息;呢提供给高风险系统信息和文档的部署,以完成对高风险系统的影响评估所需的;呢制作公开陈述,总结了开发人员已经开发或有意,实质上修改的高风险系统类型,目前可以向部署者使用,以及开发人员如何管理算法歧视的任何已知或合理可预见的风险,这些风险可能是由开发或有意修改和实质性修改的这些高风险系统所产生的;和 !在发现或收到部署可信报告后的90天内,向高危系统的总检察长和已知的高风险系统披露,高风险系统已导致或合理造成的。该法案还要求高风险系统的部署者使用合理的护理来避免在高风险系统中算法歧视。有一个可反驳的假设,即如果部署者遵守法案中的规定规定,则部署者使用合理的护理,包括:!为高风险系统实施风险管理政策和计划;呢完成对高风险系统的影响评估;呢如果高危系统做出有关消费者的结果决定,请通知消费者指定项目;呢遵守联邦和州版权法的政策;和进行公开可用的声明总结了部署目前部署的高风险系统的类型,以及部署者如何管理任何已知或合理可预见的算法歧视风险。和 !在发现后的90天内,向总检察长发现算法歧视的发现,高风险系统已导致或合理地造成的算法歧视。需要通用人工智能模型(通用模型)的开发人员来为通用模型创建和维护指定的文档,包括:!

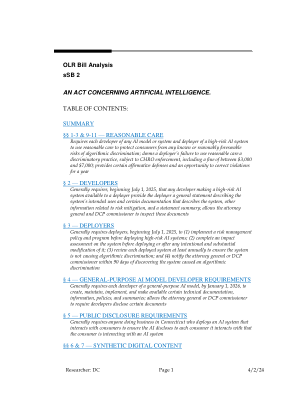

有关人工智能的法案。

该法案建立了一个监管人工智能 (AI) 开发者和部署者的框架。它要求他们采取合理的谨慎措施,保护消费者免受任何已知或合理可预见的算法歧视风险(即任何不合理的差别待遇或影响的风险,这些风险会基于某些特征,如年龄、种族或宗教,而不利于任何个人或群体)。它认为部署者未能采取合理的谨慎措施是一种歧视性做法,将受到人权和机会委员会 (CHRO) 的执法,包括处以 3,000 至 7,000 美元的罚款。

![[FPF 幻灯片] 科罗拉多州人工智能法案](/simg/e\ecff67a48a2b57f2eac469271169c6ca61be6ca6.png)

![[FPF 立法] 政策简报:科罗拉多州人工智能法案](/simg/5\51d2e8ee96113f98fba2187ac4b836af32dab523.png)