XiaoMi-AI文件搜索系统

World File Search SystemAI驱动无人驾驶汽车的伦理法律 - 电子书

人工智力现在存在于我们日常生活的许多领域中。它有望领导新的和有效的业务模型,以在私营和公共部门中有效和以用户为中心的服务。在深度学习,(深度)增强学习和神经进化技术方面的AI进步可以为人工通用智能(AGI)铺平道路。但是,AI的开发和使用也带来了挑战。数据语料库中普遍存在用于训练AI和机器学习系统的固有偏见归因于大多数这些挑战。此外,多个实例强调了在基于动力的决策中需要隐私,公平性和透明度的必要性。本书系列将为研究人员,领导者,决策者和决策者提供一条途径,以分享AI最前沿的研究和见解,包括其在道德,可解释的,可解释的,隐私的,可信赖的,可信赖的和可持续的方式中的使用。

评论CRISPR的生物伦理问题:基因组编辑技术Ashima Bhan,Satish Sasikumar,Arvind Goja,Rajendra TK Genetics和Molecu

评论CRISPR的生物伦理问题:一种基因组编辑技术Ashima Bhan,Satish Sasikumar,Arvind Goja,Rajendra TK Genetics and Molecular Biologary Lim,D。Y. Patil Biotechnologicy and BiioInformatics D. Y. Patil Vidyapeeth博士,D。通讯作者:Ashima Bhan。电子邮件 - ashimabhan@gmail.com摘要生物技术领域的最新和重大科学成就是CRISPR的发现(聚集了定期散布的短篇小说重复序列)。crispr已成为最现代,最受欢迎的工具之一,这主要是由于其低成本和效率,可用于编辑基因组。因此,这项技术几乎是生物医学和农业科学的每个维度的关键,并且在治疗病毒感染,血友病,癌症和遗传遗传异常方面具有潜在的应用。但是,当这种用于编辑基因的技术不公平地用于改善生物学特征时,道德问题可能会出现,这仅仅是出于美学的目的或比人群中其他人的优势。这不仅会导致社会歧视和动荡,而且有可能改变生物的进化进化。在这方面,应制定对CRISPR技术,风险评估,政策和程序的监管实施,以防止严重滥用这项技术。关键词:生物伦理学,生物技术,CRISPR,进化,优生学,基因编辑

人工智能和自主系统应用设计中的伦理

我们被媒体大肆宣传,谈论智能复杂系统、大数据分析 [附录中的第 1 项] 和机器学习、机器人和人工智能 [附录中的第 2 项]、超级自动化以及人机之争 [附录中的第 3 项] 的希望和危害。然而,严肃的研究,尤其是来自工程和信息通信技术 (ICT) 背景的研究,以及伦理学家和最终用户的研究,却严重缺乏。炒作可能预示着我们所知道的世界末日 [附录中的第 4 项],“因为自主系统会决定不加区别地派遣无人机”,而其他人则预示着一种增强的人类生存的愿景,其中可持续性存在于生活的各个方面,所有个人的“繁重工作”都将被消除,世界和平将通过集体意识专注于所有正确的事情 [附录中的第 5 项]。中间派观点承认一种既不是乌托邦也不是反乌托邦的中间道路,其中所有事情都是可能的,但不一定会发生,人类可能在某些时候做对,但并非总是如此 [附录中的第 6 项]。AI/AS 领域的谨慎乐观主义者对机器(硬件或软件)的未来充满信心,但即使不期待,他们也要做好准备,因为在此过程中会遇到困难、失败,甚至侵犯人权 [附录中的第 7 项]。尽管围绕机器伦理的话题有很多讨论和猜测,从“机器没有认知能力,怎么会有伦理?”一直到“人工智能拥有灵魂意味着什么”,[附录中的第 8 项] 我们脑海中最重要的应该是“人工智能”这个词,它位于“智能”之前。我们不是带着拟人化的希望深入研究机器,好像它以某种方式获得了“生命之气”,而是将它理解为一个由人类精心设计和实现的实体,使用

军事技术中工程师角色的伦理

顶点项目是设计一架轻型攻击机。设计任何类型的飞机时都必须考虑许多不同的组件,包括但不限于重量、推进力、燃油效率、空气动力学、尺寸和成本。但是,在专门设计攻击机时,必须包括防御机制以及武器装备。在设计造成伤害的东西时会出现一个道德问题:无论需要何种手段,工程师在改进军事技术方面的作用是否有益于社会?在整个学期中,我们将在顶点项目的进展过程中开设一门工程伦理课程,这将有助于激发许多科学家和工程师每天都面临的这种道德困境的冲突,现在在设计轻型攻击机时也面临着这种困境。

biden-harris过渡团队伦理计划

1。过渡团队成员将避免实际和明显的利益冲突。更具体地说,过渡团队成员不得参与他们知道的任何特定过渡事项,可能与成员的财务利益直接冲突,直接家庭成员,合作伙伴,客户或其他个人或其他个人或组织在过去12个月内与之建立了业务关系或有业务关系。即使没有直接冲突,团队成员也会引起总法律顾问的注意,任何可能出现冲突的潜力。在情况下,存在冲突的出现,以至于一个合理的人会质疑过渡小组成员的公正性或得出结论,该成员在特定问题上的工作将破坏公众对过渡团队的信心。

生物伦理学简介

● 自主性:万一您正在研究的病毒发生变异并逃出实验室,造成新的流行病,这可能会剥夺他人的生命和健康权利。 ● 后果:这可能会带来好或坏的后果。从好的方面来说,功能获得性研究通常是安全的,可以帮助预防未来的流行病并挽救生命。从坏的方面来说,逃逸的病毒可能会非常致命和灾难性的。 ● 公正性:这一决定可能为所有人带来同等的利益和风险。 ● 性格:假设您的主要价值观之一是诚实。您很可能必须对自己在实验室所做的事情保密,以免引起社会恐慌。这意味着这个决定会导致您损害您的一个关键价值观。 ● 普遍性:如果实验室里还有其他人从事功能获得性病毒学研究,您可能会感到安全,因为您知道世界将更好地应对未来的疾病爆发,尤其是因为逃逸病毒的可能性非常小。

人类生殖系基因组编辑形式之间的个人影响/身份影响区别在实践伦理中毫无用处

直接对人类胚胎进行基因改造是否会影响未来人的福祉?斯帕罗回答这个问题的方法违背了生物伦理学的一个核心目标:产生能够在研究、临床环境或公共政策中产生实际影响的观点。斯帕罗没有参与提供以经验为基础的人类身份描述的研究,而是不加批判地采用了帕菲特众所周知的两种基因干预类型的区分:“影响个人”和“影响身份”。这种区别对斯帕罗 (2022) 来说至关重要。鉴于对未来人的预期福利的合理关注,它允许他决定干预者是否对结果负有道德责任。影响个人的干预就是这种情况,因为只有在这种情况下,未来的人才会从干预中受益或遭受伤害。相比之下,目前通过 CRISPR 实现的体细胞或生殖细胞编辑通常涉及某种形式的选择——通过体外受精、体外胚胎核移植或植入前遗传学诊断——在植入妊娠母亲子宫之前选择“最佳孩子”。选择会影响身份,因为它会改变受孕时间,从而

为贯彻落实党中央、国务院关于人工智能发展的决策部署,推动人工智能技术在开源开放的产业生态中不断自我优化,充分发挥基础通用标准、伦理标准、安全标准、隐私标准的引领作用,指导人工智能国家标准、行业标准、团体标准的制定、修订和协调,形成标准引领人工智能产业全面规范发展的新格局,制定《国家新一代人工智能标准体系建设指南》。

全面贯彻党的十九大和十九届二中、三中、四中全会精神,落实党中央、国务院关于新一代人工智能发展的决策部署,坚持市场驱动与政府引导相结合,按照“统筹规划、分类施策、市场主导、急用先行、跨界融合、协同推进、自主创新、开放协作”的原则,立足国内需求,放眼国际,建立新一代人工智能国家标准体系,加强标准顶层设计和宏观指导。加快创新技术与应用转化为标准,加强标准实施和监督,推动创新成果与产业深度融合。注重对智能制造、工业互联网、机器人、车联网等相关标准体系的统筹和支撑。深化人工智能标准国际交流合作,注重国际国内标准协同,充分发挥标准对人工智能发展的支撑引领作用,保障高质量发展。

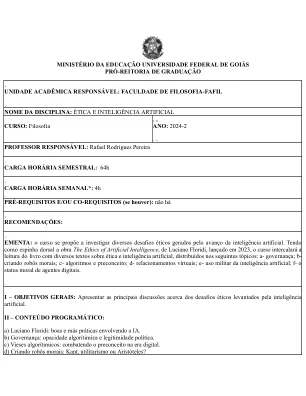

拉斐尔 - 学科计划POS 2024-2 [伦理和人工智能.docx

机器道德。剑桥:剑桥大学出版社,第1页。 451-463,2011。Greene,J。 “我们的无人驾驶困境”。 科学352(6293),1514-1515,2016。 kasirzadeh,A。 “两种类型的AI存在风险:决定性和累积性”。 arxiv:2401.07836v2,2024 Kitchin,R。“智慧城市和城市科学的伦理”。 菲尔。 trans。 R. Soc。 A 374:20160115,2016。 Liao,M。(ed)。 人工智能的伦理。 牛津:牛津大学出版社,2020年。 Levy,D。爱+与机器人的性 - 人类机器人关系的演变。 纽约:哈珀多年生,2008年。 Mendonça,R。,Filgueiras,F。和Almeida,V。算法制度主义 - 社会和的变化规则Greene,J。“我们的无人驾驶困境”。科学352(6293),1514-1515,2016。kasirzadeh,A。“两种类型的AI存在风险:决定性和累积性”。arxiv:2401.07836v2,2024 Kitchin,R。“智慧城市和城市科学的伦理”。菲尔。trans。R. Soc。 A 374:20160115,2016。 Liao,M。(ed)。 人工智能的伦理。 牛津:牛津大学出版社,2020年。 Levy,D。爱+与机器人的性 - 人类机器人关系的演变。 纽约:哈珀多年生,2008年。 Mendonça,R。,Filgueiras,F。和Almeida,V。算法制度主义 - 社会和的变化规则R. Soc。A 374:20160115,2016。Liao,M。(ed)。人工智能的伦理。牛津:牛津大学出版社,2020年。Levy,D。爱+与机器人的性 - 人类机器人关系的演变。纽约:哈珀多年生,2008年。Mendonça,R。,Filgueiras,F。和Almeida,V。算法制度主义 - 社会和

人工智能伦理研究领域

● 文章/视频:人工智能如何推荐视频 [ 链接 ] ● 视频:人工智能、社交媒体和选举 [ 链接 ] ● 视频:人工智能和社交媒体营销 [ 链接 ] ● 文章:人工智能在社交媒体中的利弊 [ 链接 ] ● 文章:视频游戏人工智能的社会和哲学影响 [ 链接 ]