XiaoMi-AI文件搜索系统

World File Search Systemai模仿和人类尊严:聊天机器人用作违反自尊的

本文调查了人类与AI驱动的聊天机器人的互动如何冒犯人的尊严。当前的聊天机器人,由大语言模型(LLM)驱动,模仿人类语言行为,但缺乏真正的人际际尊重所必需的道德和理性能力。人类倾向于拟人化聊天机器人 - 的确,聊天机器人似乎是故意设计的,以引起这种反应。结果,人类对聊天机器人的行为类似于道德药物之间互动的典型行为。借鉴了尊严的二人关系说明,我们认为以这种方式与聊天机器人进行交互与用户的挖掘不兼容。我们表明,由于第二个人的尊重是基于对二个人道德权威的相互认可,因此鉴于缺乏互惠性,以传达第二个人的尊重的方式行事以道德上有问题。因此,这种聊天机器人的互动等于微妙但有明显的侵犯自尊的行为 - 我们有责任表现出自己的尊严。我们通过讨论四个实际的聊天机器人用例(信息检索,客户服务,咨询和陪伴)来说明这一点,并提出,与聊天机器人进行这种互动的社会压力越来越多,迄今对人类尊严的威胁不足。

欧洲人工智能法规:布鲁塞尔效应与人类尊严?

经过多年的公众咨询和审议,欧盟委员会提出了全面监管人工智能 (AI) 的法律框架。最引人注目的是,人工智能高级专家组 (AI HLEG) 自 2018 年以来就制定了道德准则和政策建议。虽然中国和美国等国家或欧洲委员会等国际组织正在制定法律框架来规范人工智能的开发和使用,但欧盟委员会于 2021 年 4 月 21 日提出的提案(人工智能法案或 AIA)似乎使联盟处于最有力的地位,可以为一项关键的新兴技术制定具有全球意义的监管标准。在简要总结了未来监管的起源、背景和主要特征之后,本文探讨了“布鲁塞尔效应”是否会体现在突破性的人工智能监管中,或者欧盟及其成员国是否会冒着仓促采用无能的法律框架的风险,而这项技术对社会的影响仍未得到充分理解。此外,拟议的

尊严,多样性与平等政策声明

5.1工作中的尊严 - 这是关于大学社区的所有成员都受到尊严和尊重的对待,并防止他们受到不良或不公平的对待。平等 - 平等是机会平等,并建立一个包容性的社会,每个人都可以参与并有机会发挥自己的潜力。多样性 - 多样性一词的意思是“多样化和不同”,因此“多样性”不仅仅是平等。这是关于重视多样性和个体差异,创造一种文化,环境和实践,这些文化,环境和实践尊重和价值差异,以使社会,组织和个人的利益受益。5.2歧视类型:直接歧视 - 直接歧视发生时,当某人的对待比另一个人受到保护的特征不那么受保护时,就会发生直接歧视。直接通过关联歧视 - 这是对某人的直接歧视,因为他们与拥有受保护特征的另一个人相关联。直接通过感知歧视 - 这是对个人的直接歧视,因为其他人认为自己具有特定的特征,即使该人实际上没有该特征,也适用。间接歧视 - 当有条件,规则,政策或实践适用于所有人(尤其是具有共享受保护特征的人)时,这可能会发生。间接歧视是合理的。骚扰 - 这是与相关的受保护特征有关的不必要的行为,其目的或效果是违反个人的尊严或为该人创造一个令人生畏,敌对,贬低,羞辱,羞辱或冒犯的环境。

人类尊严——以及人工智能的生物伦理学。

作者讨论了人工智能(AI)在各个领域,特别是在健康领域日益增长的影响力,以及在其变得至关重要之前从伦理和生物伦理角度解决其影响的紧迫性。它还探讨了如何将人类尊严(天主教生物伦理学和世界人权宣言的核心原则)作为人工智能监管的基石。人工智能在医疗保健领域的应用引发了道德挑战,例如数据偏见和不公正风险。强调需要开发一种促进透明度、责任感和尊重人类尊严的“算法学”或算法伦理。此外,它还强调了人工智能对医患关系、医疗行业实践和治疗决策的影响,并指出人工智能不应取代人类的判断。最后,强调需要对医生和卫生专业人员进行人工智能的道德使用培训,将生物伦理原则融入他们的培训中,以确保技术服务于共同利益而不损害人类尊严。

有尊严的生命权,对气候流离失所者:

气候变化的毁灭性影响正在全球感受到,并且由于气候条件恶化,自然灾害正在扩大。人类活动在全球范围内导致了有害的环境影响,证据揭示了未来危害更大的预测。低谎言的小岛发展中国家(SID)和沿海社区特别容易受到气候变化的影响,包括海平面上升,高强度旋风,国王潮汐和珊瑚漂白剂。1许多岛屿社区,尤其是土著社区,生活在失去文化和身份的不断威胁下,因为环境退化迅速侵蚀了其存在的痕迹。2此外,由于环境灾难,妇女和女孩以及残障人士面临的脆弱状态更高。3没有州,没有城市,没有社区必须与悬挂在他们身上的一把Damocles一起生活。对于许多人来说,有尊严的生命权的概念(RTLWD)4已经处于危险之中。

缅因州尊严死亡法案年度报告

执行摘要根据 22 MRS § 2140(17),卫生与公众服务部(以下简称“部”)应生成并向公众提供根据缅因州尊严死亡法案(以下简称“法案”)收集的信息的年度统计报告。该部门必须在每年 3 月 1 日前向对健康事务具有管辖权的立法机关联合常设委员会提交一份报告副本。本报告适用于在 2023 日历年完成书面申请以加速死亡药物的患者。在日历年内完成口头申请但未提出书面申请的患者将被纳入下一年度的报告中。本报告提供有关患者主导护理使用情况的统计数据,即 22 MRS 第 418 章。具体而言,本报告提供有关据称符合该法案要求的患者的信息、符合条件的患者死亡的根本原因以及为符合条件的患者开具或分发的终止生命药物处方数量。 2023 年,有 80 名患者启动了该流程(比 2022 年多 19 名)。四人在提出书面请求之前去世。截至本报告撰写时,仍有 9 名患者活着,但其中 3 名在 2023 年底完成了要求,目前还未过去 6 个月。患者居住在 14 个县。患者未居住的两个县是皮斯卡塔奎斯和华盛顿。患者年龄较大。男性和女性的比例没有显著差异,癌症是报告最多的疾病。引言第 129 届缅因州立法机构通过了 2019 年第 271 章公共法,称为《尊严死亡法案》(附录 A)。该法案允许医生向被诊断患有绝症的缅因州居民开药,目的是让患者自行服用药物,以加速患者死亡。该法案规定了患者和医生合法采取这一行动的条件。这些条件包括但不限于患者向医生提出口头和书面请求、提醒过程中的所有步骤必须是自愿的并且患者有能力做出这样的决定、第二位医生确认诊断和预后、以及合格证人对这些步骤的证明。

经期尊严圆桌会议 2024 年 2 月 29 日 10:00

1. 开发双语研究型学习和电子学习材料。 2. 研究有效的经期疼痛信息是什么样的。 SPPINN 课程项目旨在为学校护士和其他年轻人可能向其寻求严重经期疼痛建议的人开发教育材料,帮助他们找到适当的服务和支持。最终结果是确保每个人都能获得或受益于威尔士提供的严重经期疼痛治疗和支持。 威尔士子宫内膜异位症网站 介绍了子宫内膜异位症的背景。据称,在威尔士,诊断子宫内膜异位症平均需要 10 年时间。 威尔士子宫内膜异位症网站包含基于证据的信息和建议,并附有个人故事,适合任何有兴趣进一步了解该疾病的人。该网站完全是双语的,内容易于阅读。十分之一的女孩在月经期间会感到疼痛或其他因素,这可能是由于子宫内膜异位症引起的。正在开发一种报告工具,以尝试减少人们被诊断的平均时间。

零工经济中的就业分类和人类尊严

企业的驱动力是什么?1 简单地说,就是利润。2 但目的是什么?3 就业分类对企业的利润有重大影响。4 全球公认的两种最常见的工人分类是独立承包商和雇员。5 这种分类决定了个人是否有权获得报酬、是否有资格享受福利以及是否受到歧视保护。6 所有这些因素都会让雇主付出代价,并导致其整体利润减少。7 在二十世纪,就业分类在特定领域受到了激烈的诉讼:零工经济。8 零工经济主要在二十一世纪发展起来,为工人提供了从事灵活和临时工作的能力。9 对一些人来说,灵活性是有益的,因为它允许人们

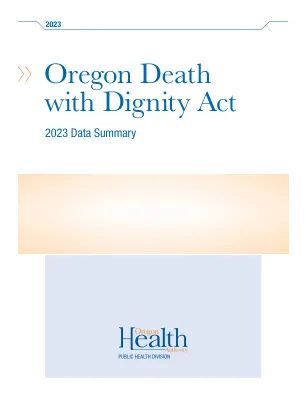

俄勒冈州尊严死亡法案:2023 年数据摘要

男性 207 (56.4) 152 (50.0) 1,152 (52.9) 1,511 (53.1) 女性 160 (43.6) 152 (50.0) 1,024 (47.1) 1,336 (46.9) 年龄 18–34 1 (0.3) 1 (0.3) 12 (0.6) 14 (0.5) 35–44 7 (1.9) 3 (1.0) 38 (1.7) 48 (1.7) 45–54 18 (4.9) 13 (4.3) 122 (5.6) 153 (5.4) 55–64 40 (10.9) 29 (9.5) 372 (17.1) 441 (15.5) 65–74 113 (30.8) 96 (31.6) 662 (30.4) 871 (30.6) 75–84 116 (31.6) 101 (33.2) 606 (27.8) 823 (28.9) 85+ 72 (19.6) 61 (20.1) 364 (16.7) 497 (17.5) 年龄中位数(范围) 75 (29-102) 75 (29-99) 73 (25-102) 73 (25-102) 种族和民族 白种人 343 (93.5) 293 (96.4) 2,091 (96.3) 2,727 (96.0) 非裔美国人 2 (0.5) 1 (0.3) 1 (0.0) 4 (0.1) 美洲印第安人 2 (0.5) 2 (0.7) 4 (0.2) 8 (0.3) 亚裔 7 (1.9) 5 (1.6) 32 (1.5) 44 (1.5) 太平洋岛民 1 (0.3) 0 (0.0) 1 (0.0) 2 (0.1) 其他 2 (0.5) 0 (0.0) 6 (0.3) 8 (0.3) 两个或多个种族 2 (0.5) 1 (0.3) 8 (0.4) 11 (0.4) 西班牙裔(任何种族) 8 (2.2) 2 (0.7) 28 (1.3) 38 (1.3) 未知 0 0 5 5 婚姻状况 已婚(包括已登记同居伴侣)