XiaoMi-AI文件搜索系统

World File Search System当联合学习符合水印时

摘要:联合学习(FL)是一种允许多个参与者协作训练深神经网络(DNN)的技术,而无需集中数据。除其他优点外,它具有保护隐私性的财产,使其对在敏感环境(例如医疗保健或军方)的应用中具有吸引力。尽管没有明确交换数据,但培训程序需要共享有关参与者模型的信息。这使各个模型容易受到恶意演员的盗窃或未经授权的分配的影响。为了解决机器学习(ML)的所有权保护问题,在过去的五年中已经开发了DNN水印方法。大多数现有的作品都以集中式的方式着重于水印,但仅针对FL及其独特的限制设计了一些方法。在本文中,我们概述了联合学习水印的最新进步,阐明了这一领域中出现的新挑战和机遇。

符合巴黎的牲畜部门的选项

在高峰之后,大多数专家都同意,HIC(占受访者的89%)和麦克风(75%的受访者)应迅速下降牲畜排放。大多数专家都同意,与全球总体减少目标保持一致,高,中等和低收入的国家应具有牲畜生产的温室气体(GHG)减少目标 - 应为2036年61%(SD 22.9)(SD 22.9)(SD 9.4)。最多的专家同意,减少牲畜产品的消费(58%)和减少养殖动物的数量(45%)有可能对这一目标做出很大的贡献,并且从减少较大的GHG足迹的动物数量中,可以通过较大的GHG足迹来识别出更为中等的贡献。最多的专家认为,牲畜生产的加剧几乎没有贡献到实现目标。大多数专家都同意,减少温室气体不应以养殖动物福利为代价,也不应导致养殖动物数量增加。

物理学符合普朗克量表的哲学

剑桥大学出版社,爱丁堡大楼,剑桥CB2 CB2 2RU,英国40 40 West 20th Street,纽约,纽约,10011-4211,美国10 Stamford Road,Oakleigh,VIC 3166,VIC 3166,澳大利亚Ruiz de Alarc´on 13,28014 Madrid,Madrid,Spain Dock House,Spain Dock House,Spain Dock House,spain Dock House,Sess the Waterfront,south Invary cape town Invary 800001,div)

2024-FCSS符合条件的剥削指南。 ...

•合格的时间范围:在资金协议的特定时间范围内应产生符合条件的费用。仔细管理费用以确保它们属于指定的时间范围很重要。•合理的支出:开支必须是合理的,并且必须进行资金预定的计划。例如,购买与该计划无直接相关的奢侈品不会被视为合理的费用。•遵守法规:组织在使用资金时必须遵守所有适用的法律和法规。这包括遵守适用的联邦,省和市法律,以及该计划的任何法规。•文档:所有费用都必须记录,可审核和由适当记录(例如发票,收据和时间表)提供支持。保持准确的记录以确保所有费用都有资格获得资金很重要。

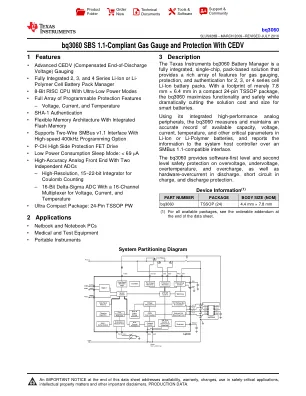

BQ3060 SBS 1.1符合cedv

BQ3060在从Ti发货之前校准用于电压。将为每个单元校准BQ3060电压测量信号链(ADC,高压翻译,电路互连)。从每个单元连接到BQ3060的VCX输入的外部过滤器电阻必须为1KΩ。在4V电池电压下,在室温下,工厂校准设备的精度为+/- 10mV。没有任何客户电压校准,只要过滤器电阻值为1kΩ,这就是预期的准确度。如果需要更好的电压精度,则需要客户电压校准。有关校准和编程的应用程序说明BQ3060在产品Web文件夹中可用。有关更多详细信息,请参见数据闪存编程和校准BQ3060加油表(SLUA502)。

嵌入人工智能的处理符合 RGPD

1956 年,约翰·麦卡锡首次使用人工智能或 AI 这个术语,指的是“创造智能机器,特别是智能计算机程序背后的科学与工程”:欧盟委员会为制定欧洲人工智能战略而成立的高级人工智能小组 (IA - HLEG) 将该术语应用于任何“表现出智能行为的系统,这种系统能够分析其环境并以一定程度的自主性采取行动,以实现特定目标”1。还有其他定义,但都可以归纳为这样一个概念:人工智能是机器以人类思维的方式行事的能力,包括创造力方面和从复杂甚至不完整的信息中进行复杂分析和推理的能力2。

imt-战略计划-508-符合- ...

作为内政部首席信息官 (CIO),我很高兴发布内政部 (DOI) 2024-2029 年信息管理和技术 (IMT) 战略计划 (IMTSP,计划)。该计划是内政部广泛参与和合作的结晶。从各个局和办公室确定了目标领导者,并定期向高级管理层通报我们在记录这项多年计划方面的进展。我们举行了听证会,在场外举行了信息管理技术领导团队 (IMTLT),并进行了规划和集思广益会议。我为团队的工作和最终的计划感到自豪,它:• 包容并代表了不同的观点,

符合 ISO 26262 的功能安全

考虑到汽车行业的供应结构,ISO 26262 包含了在分地开发的情况下规范安全相关责任的要求。这就是开发接口协议 (DIA) 的目的,该协议涵盖了相关公司在其接口上达成的明确详细协议。如下节所述,客户仅仅向其供应商提出以“符合 ISO 26262 的方式”工作的一般要求或仅仅说明特定的安全分类是远远不够的。明确就技术层面达成协议,特别是安全目标、安全目标分类以及要实施的安全措施等。对于确保开发超出供应边界的安全产品也至关重要。

符合道德的人工智能回归测试选择

摘要 — 测试自动化在软件开发中很常见;通常需要反复测试以识别回归。如果测试用例数量很大,则可以选择一个子集并仅使用最重要的测试用例。回归测试选择(RTS)可以实现自动化,并通过人工智能(AI-RTS)进行增强。然而,这可能会带来道德挑战。虽然人工智能中的此类挑战通常已得到充分研究,但在道德 AI-RTS 方面仍存在差距。通过探索文献并借鉴我们开发行业 AI-RTS 工具的经验,我们通过确定三个挑战(分配责任、决策偏见和缺乏参与)和三种方法(可解释性、监督和多样性)为文献做出了贡献。此外,我们还提供了一份道德 AI-RTS 清单,以帮助指导参与该过程的利益相关者的决策。