XiaoMi-AI文件搜索系统

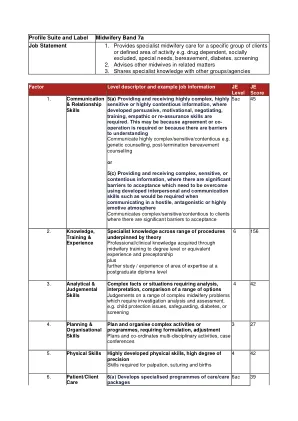

World File Search System助产乐队7A作业语句

5(a)需要提供高度复杂,高度敏感或高度争议的信息,其中需要有说服力,动机,谈判,培训,同理心或再保证技能。这可能是因为需要一致或合作,或者是因为理解高度复杂/敏感/有争议的障碍,例如遗传咨询,终止后丧亲咨询

全球和平与国际组织

尝试通过率先到达终点来取胜,但主要目的是发挥创造力和说服力。设计一个至少有 20 个方格的板。剪下本单元中的卡片并面朝下放置。轮流拿起一张卡片。它会要求您画出、写下或表演一个单词或事件的含义。有些卡片会要求您表演或画一个单词,以便其他人可以“猜出”它是什么。其他卡片上会写着“投票”——这意味着全班必须投票决定您是否可以继续前进,这取决于您是否足够有说服力或足够有创造力。如果成功,您将移动卡片上指示的方格数。如果没有,您必须在轮到您时重试。如果卡片上没有写着“投票”,请不要向其他玩家展示。如果您抽到的卡片与您之前的另一个人相同,则您不能重复他或她所做的事情。如果需要,您可以在每张卡片上设置时间限制。您也可以制作自己的卡片以添加到堆栈中。

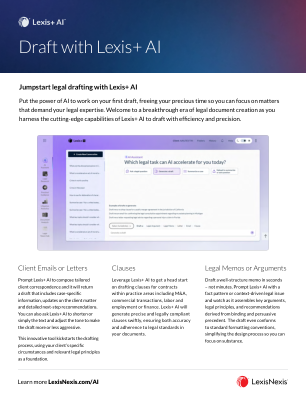

使用 Lexis+ AI 进行起草

在几秒钟内(而不是几分钟)起草一份结构良好的备忘录。向 Lexis+ AI 提供事实模式或上下文驱动的法律问题,然后观察它如何汇总关键论点、法律原则以及从具有约束力和说服力的先例中得出的建议。草稿甚至符合标准格式约定,简化了设计流程,让您可以专注于实质内容。

值得信赖的人工智能管弦乐团

大型语言模型现在已经足够复杂,能够通过有说服力的论据在辩论中击败人类对手。第一代人工智能代理已经承担了许多业务运营,但公司管理层尚未达到让人工智能代理进入董事会的程度。在可预见的未来,人类干预仍将是人工智能决策层中的最高权力。

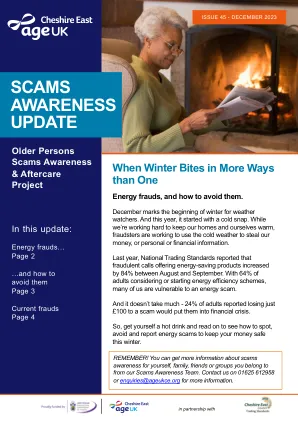

骗局意识更新公告问题2023年12月45日

能源提供者或监管机构的模仿:有人与您联系,说他们是您的能源提供商或GEM的能源监管机构。他们告诉您,他们可以为您带来便宜的能量,或者您将退款。他们所需要的只是您完成交易的银行详细信息。他们对报价非常有说服力,因此您忘记,如果他们是您的能源提供商,他们应该已经拥有您的银行详细信息。和,Ofgem是调节器,因此请勿提供更便宜的能量或退款。

人工智能可以说服人类

摘要 利用深度学习和网络规模语料库的 Transformer 模型的出现使人工智能 (AI) 能够解决许多高阶认知任务,这对美国乃至全球的工业、政府和劳动力市场具有重要意义。在这里,我们研究了目前最强大、公开可用的 AI 模型 GPT-3 是否能够影响人类的信念,而信念是一种最近被视为其他人类独有的社会行为。在三项预先注册的实验中,实验对象来自不同的美国人样本(总计 N = 4,836),我们发现一致的证据表明,人工智能生成的信息在许多政策问题上具有说服力,包括攻击性武器禁令、碳税和带薪育儿假计划。此外,人工智能生成的信息与普通人类编写的信息一样具有说服力。与人类作者相比,参与者认为人工智能信息的作者更注重事实和逻辑,但不那么愤怒、独特,也不太可能使用讲故事的方式。我们的结果表明,当前一代大型语言模型可以说服人类,即使在两极分化的政策问题上也是如此。这项研究对于在政治背景下规范人工智能应用具有重要意义,可以抵消其在虚假宣传活动和其他欺骗性政治活动中的潜在用途。

护理国家资料

4A-需要提供复杂,敏感或有争议的信息,其中需要有说服力,激励性,谈判,培训,移情或再保证技能。这可能是因为要求或合作需要理解障碍;或5A-需要提供高度复杂,高度敏感或高度争议的信息,其中需要有说服力,动机,谈判,培训,同理心或再保证技巧。这可能是因为需要达成共识或合作,或者是因为存在理解和/或5C的障碍 - 提供和接收复杂,敏感或有争议的信息,在这种情况下存在重大的接受障碍,需要使用已发达的人际交往和沟通技巧来克服这些障碍,例如在敌对,具有敌意,具有敌意或高度情绪化的患者中,需要进行诸如人性化和沟通技巧,并需要良好的敏感/信仰良好的信息,以敏感的敏感/信仰良好的信息,以敏感的敏感/信仰良好的信息,以敏感的敏感性,敏感性的信息,放心/某些患者可能由于感觉障碍,状况或残疾而可能有更多的沟通需求。 5C传达有关患者/客户患者/客户的复杂,敏感或有争议的信息可能具有挑战性的行为,例如不可预测的行为是客户群

Vandevelde,Eric D.Chris Whittaker 碳捕获项目的中游运输协议:关键问题和注意事项 Martie Kutscher ClarkChris Whittaker碳捕获项目的中游运输协议:关键问题和注意事项Martie Kutscher Clark

Martie以她能够处理新兴技术引起的新法律问题的能力而闻名,并提供了预期未来风险的战略顾问。她在将复杂的技术概念提炼成清晰,有说服力的论点方面使她成为了人们的追求 - 在需要对法院和事务调查员的复杂技术进行细微的解释的情况下,她的结果驱动的焦点和战略方法使她成为了塞里康谷(Silicon Valley)的许多知名公司的信任倡导者和顾问。