XiaoMi-AI文件搜索系统

World File Search System非洲的人工智能(AI)部署

致谢 本研究是在开放非洲创新研究 (Open AIR) 网络的支持下进行的,该网络是开普敦大学、约翰内斯堡大学、开罗美国大学、肯尼亚斯特拉斯莫尔大学、尼日利亚高级法律研究学院和渥太华大学之间的合作项目。我们感谢 Open AIR、加拿大社会科学与人文研究委员会 (SSHRC) 和国际发展研究中心 (IDRC) 对本研究提供的支持。本文表达的观点为作者观点,并不一定代表研究资助者的观点。本文包括作者在渥太华大学法律、技术和社会中心 (CLTS) 主办的 2020 年 We Robot 虚拟会议 (CLTS, 2020) 上提交的论文的部分内容。

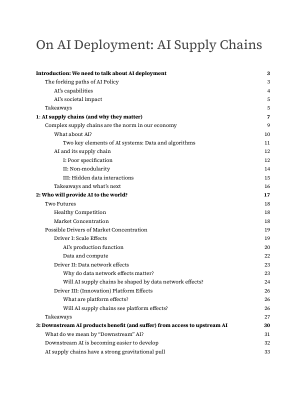

关于人工智能部署:人工智能供应链

7 虽然这本身就是一个有趣的案例研究,但我们注意到,这在很多方面都是可能的,因为科技行业和特殊利益集团很早就为可访问性、网络开发等问题制定了标准。目前尚不清楚这种方法是否能带来理想的结果。

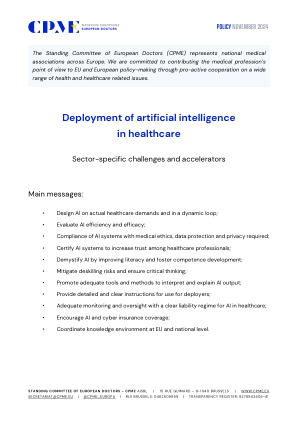

人工智能在医疗保健领域的部署

1 欧洲议会和理事会 2024 年 6 月 13 日第 (EU) 2024/1689 号条例,规定了有关人工智能的协调规则并修订了第 (EC) 300/2008 号条例、(EU) 167/2013 号条例、(EU) 168/2013 号条例、(EU) 2018/858 号条例、(EU) 2018/1139 号条例和 (EU) 2019/2144 号条例以及 2014/90/EU 指令、(EU) 2016/797 号指令和 (EU) 2020/1828 号指令(《人工智能法》),OJ L,2024/1689,2024 年 7 月 12 日,ELI:http://data.europa.eu/eli/reg/2024/1689/oj。 《人工智能法案》于 2024 年 8 月 1 日生效,并制定了统一的规则,要求人工智能在投放市场、投入使用或使用之前必须以人为本、值得信赖和安全,同时遵守《欧洲联盟基本权利宪章》所规定的基本权利。2 欧洲委员会《人工智能与人权、民主和法治框架公约》,由部长委员会于 2024 年 5 月 17 日在其第 133 届会议上通过。3 欧盟委员会卫生和食品安全总司 (DG SANTE) 委托普华永道 (PwC) 牵头的财团对人工智能在医疗保健领域的部署进行研究。该研究计划为期 12 个月,从 2024 年 2 月到 2025 年 2 月,将包括与利益相关者进行几次有针对性的磋商,以收集有关人工智能在医疗保健领域的部署的数据、见解和观点。欧盟委员会通信网络、内容和技术总司 (DG CONNECT) 还委托了由安永牵头的财团,通过参与针对特定利益相关者的在线调查和/或访谈,对人工智能在欧洲医疗保健中的应用对经济的影响进行研究。4 Gillner, Sandra。“我们现在正在实施人工智能,那么为什么不问问我们该怎么做?人工智能提供商如何看待和引导诊断人工智能在复杂医疗保健系统中的传播。”社会科学与医学 340 (2024):116442。

安全部署人工智能系统

[1] 国家网络安全中心等。安全人工智能系统开发指南。2023 年。https://www.ncsc.gov.uk/files/Guidelines-for-secure-AI-system-development.pdf [2] 澳大利亚信号局等。参与人工智能(AI)。2024 年。https://www.cyber.gov.au/sites/default/files/2024-01/Engaging%20with%20Artificial%20Intelligence%20%28AI%29.pdf [3] MITRE。ATLAS(人工智能系统对抗性威胁格局)矩阵版本 4.0.0。2024 年。https://atlas.mitre.org/matrices/ATLAS [4] 国家标准与技术研究所。人工智能风险管理框架 1.0。 2023 年。 https://www.nist.gov/itl/ai-risk-management-framework [5] 开放式全球应用安全项目 (OWASP ®)。LLM 人工智能网络安全与治理清单。2024 年。 https://owasp.org/www-project-top-10-for-large-language-model-applications/llm-top-10-governance-doc/LLM_AI_Security_and_Governance_Checklist-v1.pdf [6] 开放式全球应用安全项目 (OWASP ®)。OWASP 机器学习安全十大安全风险。2023 年。 https://owasp.org/www-project-machine-learning-security- top-10/ [7] 网络安全和基础设施安全局。安全设计。2023 年。 https://www.cisa.gov/securebydesign [8] 国家安全局。拥抱零信任安全模型。 2021 年。https://media.defense.gov/2021/Feb/25/2002588479/-1/- 1/0/CSI_EMBRACING_ZT_SECURITY_MODEL_UOO115131-21.PDF [9] 网络安全和基础设施安全局。零信任成熟度模型。2022 年。https://www.cisa.gov/zero-trust-maturity-model [10] 网络安全和基础设施安全局。转变漏洞管理

简介/ISOPREP 预部署

2023 年 7 月 6 日 — 对可能的 IED 做出反应。识别爆炸装置的视觉指示器。对 IED 攻击做出反应。机组人员概述。C-IED/HME 意识培训。MET 培训。

推进负责任的开发和部署-...

并在整个生命周期内管理可信赖的人工智能的风险。举例来说:1)人工智能知识和资源的供应商可以包括:内容创建者;数据提供者和数据注释者;投资者;数字基础设施提供商;硬件制造商。2)人工智能生命周期中的参与者可以包括参与以下活动的公司、国家、研究机构:系统的规划和设计;数据的收集和处理;模型的构建和使用;模型的验证和确认;部署系统,无论分销渠道如何(包括开源软件的分发);以及系统的操作和监控;3)人工智能系统的用户/运营商可以包括企业,包括金融机构和“实体”经济中的企业(例如,制造、采购和商品和服务流动);将人工智能用于个人用途、商业或研究活动的个人或其他参与者;以及国家。

技术部署和更新建模

本研究提出了一个基于经典 S 曲线的新模型,该曲线描述了最大容量下的部署和稳定。此外,该模型还扩展到增长后稳定期,其中技术能力根据设备寿命的分布进行更新。我们得到了两个定性不同的结果。在“快速”部署的情况下,其特点是部署时间相对于平均设备寿命较短,生产会出现显著波动。在“慢速”部署的情况下,生产单调增加,直到达到更新稳定期。这两个案例研究与直觉相反地验证了这些结果:核电站是快速部署,智能手机是慢速部署。这些结果对于长期工业规划很重要,因为它们使我们能够预测未来的商业周期。我们的研究表明,商业周期可以内生地源于安装和更新的工业动态,这与将波动归因于外生宏观经济因素的传统观点形成鲜明对比。这些内生循环与更广泛的趋势相互作用,可能会受到宏观经济条件的调节、放大或减弱。这种部署和更新的动态与长寿命基础设施技术(例如支持可再生能源行业的技术)有关,并对行业参与者具有重大的政策影响。

蓝绿部署架构注意事项

Deloitte 评估了客户的情况,并推荐了基于蓝绿方法的解决方案。推荐的解决方案包括采用单个应用程序负载均衡器 (ALB)、单个侦听器和两个侦听器规则。其中一条规则将根据指定的“路径”将应用程序流量引导至实际生产环境(蓝色),而另一条规则则使用“路径+标头”标准将流量路由到绿色(即测试环境)。每条规则依次与一个不同的目标组相关联。部署和成功测试后,通过在规则之间切换目标组,将发生流量重定向。这完全消除了停机时间,并为全面测试以及受控流量切换和故障转移提供了足够的时间范围。