XiaoMi-AI文件搜索系统

World File Search System视觉识别过程中大脑中的节律性信息采样

当我们注视一个物体时,视觉信息会持续地被视网膜接收。一些研究观察到了这种刺激时间内感知敏感度的行为波动,这些波动与大脑波动有关。然而,特定大脑区域是否在刺激时间中表现出波动(即刺激在不同时间点以有节奏的方式被或多或少地处理)尚未得到研究。在这里,我们在随机时刻揭示了面部图像的随机区域,并使用 MEG 记录了男性和女性人类参与者在执行两项识别任务时的大脑活动。这使我们能够量化来自刺激的每个视觉信息快照在时间和大脑中的处理方式。刺激时间的波动(有节奏的采样)主要出现在早期视觉区域,频率为 theta、alpha 和低 beta。我们还发现它们对大脑活动的贡献大于之前研究的节律处理(处理单个视觉信息快照时的波动)。非节律性采样在视觉皮层的后期潜伏期也可见,要么是早期刺激时间点的瞬时处理,要么是整个刺激的持续处理。我们的结果表明,连续的大脑振荡周期会处理连续时刻传入的刺激信息。总之,这些结果促进了我们对与视觉处理相关的振荡神经动力学的理解,并表明在研究视觉识别时考虑刺激的时间维度的重要性。

lmpt:长尾多标签视觉识别的特定于类的嵌入损失

长尾的多标签视觉识别(LTML)任务是由于标签共发生和不平衡的数据分布,这是一项极具挑战性的任务。在这项工作中,我们为LTML提出了一个统一的框架,即促使特定于班级的嵌入损失(LMPT)进行调整,从而通过结合文本和im im Im operational数据来捕获语义功能相互作用,并在头部和尾部同步改进型号。具体来说,LMPT通过班级感知的软边距和重新投资介绍了嵌入式损失函数,以学习特定的班级上下文,并带有文本描述(字幕)的好处,这可以帮助建立类之间的语义关系,尤其是在头和尾部之间。fur-hoverore考虑到类失样的类别,分配平衡的损失被用作分类损失函数,以进一步提高尾部类别的性能而不会损害头部类别。在VOC-LT和可可-LT数据集上进行了广泛的实验,这表明我们的方法显着超过了先前的最新方法,而LTML中的零拍夹。我们的代码在https://github.com/richard-peng-xia/lmpt上完全公开。

可旋转的天线启用了带视觉识别的无线通信系统:原型实现

摘要 - 可润滑的天线(RA)是一种具有巨大潜力来利用额外空间自由度(DOF)的新兴技术,它通过灵活地改变每个天线的三维(3D)方向/无视。在此演示中,我们开发了具有RA支持的无线通信系统的原型,该原型具有视觉识别模块,以评估RA在实用环境中提供的绩效增长。尤其是通过对数字伺服电机,定向天线和微控制器进行机械驱动的RA的开发,该电动机能够动态调整RA方向。此外,RA的方向调整是由目标识别模块提供的目标的方向指导的,从而显着提高了系统响应速度和定向精度。实验结果表明,与常规的基于固定天线的系统相比,基于RA的通信系统在通信覆盖效果方面取得了出色的改进。索引术语 - 可润滑的天线,视觉识别,3d orimitation。

通用任务驱动的医疗图像质量增强,梯度促销

摘要 - 感谢任务驱动的图像质量增强(IQE)模型等最新成就,例如ESTR [1],图像增强模型和视觉识别模型可以相互增强彼此的定量,同时产生我们人类视觉系统可感知的高质量处理的图像。但是,现有的任务驱动的IQE模型倾向于忽略一个基本的事实 - 不同级别的视力任务具有不同的图像特征要求,有时甚至相互矛盾。为了解决这个问题,本文提出了针对医疗图像的任务驱动IQE的广义梯度促进(GradProm)培训策略。具体来说,我们将任务驱动的IQE系统分为两个子模型i。e。,一种用于图像增强的主流模型,也是视觉识别的辅助模型。在训练期间,GradProm仅使用视觉识别模型和图像增强模型的梯度更新图像增强模型的参数,但是只有当这两个子模型的梯度以相同的方向对齐时,这是通过其余弦相似性来衡量的。如果这两个子模型的梯度不在同一方向上,则GradProm仅使用图像增强模型的梯度来更新其参数。从理论上讲,我们已经证明了图像增强模型的优化方向不会被GradProm的实现下的辅助视觉识别模型偏差。从经验上讲,对四个公开但具有挑战性的医学图像数据集的广泛实验结果证明了Gradprom的表现优于现有最新方法。

中小企业人工智能应用现状及所需支持

来源:ImageNet 主页(http://image-net.org/challenges/talks_2017/ILSVRC2017_overview.pdf)(注)ILSVRC(ImageNet 大规模视觉识别挑战赛)是一项基于人工智能的

RoboTHOR:一个开放的仿真到现实具象人工智能平台

视觉识别生态系统(例如 ImageNet、Pascal、COCO)在现代计算机视觉的发展中发挥了不可否认的作用。我们认为,在这些生态系统出现之前,交互式和具身视觉 AI 已经达到了与视觉识别类似的发展阶段。最近,各种合成环境已被引入以促进具身 AI 的研究。尽管取得了这些进展,但在模拟中训练的模型如何很好地推广到现实这个关键问题仍然基本上没有答案。为模拟到现实的具身 AI 创建一个可比的生态系统提出了许多挑战:(1)问题固有的交互性,(2)现实世界和模拟世界之间需要紧密结合,(3)复制可重复实验的物理条件的难度,(4)以及相关成本。在本文中,我们引入了 R OBO THOR 来使交互式和具身视觉 AI 的研究民主化。 R OBO THOR 提供模拟环境框架

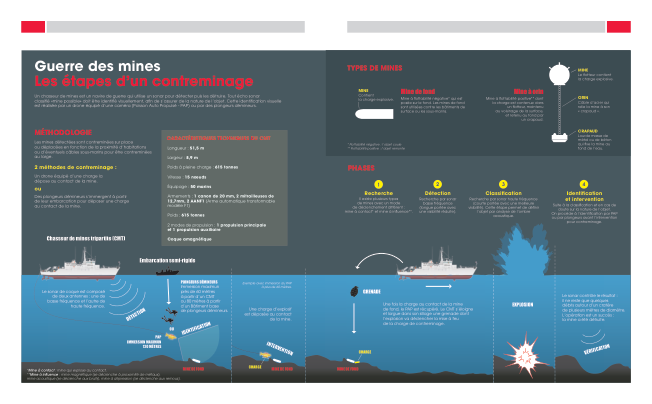

地雷战 反地雷战的阶段

扫雷舰是一种使用声纳探测并摧毁水雷的军舰。任何被归类为“可能为水雷”的声纳回波都必须进行目视识别,以确保物体的性质。这种视觉识别是由配备摄像头的无人机(Poisson Auto Propulsé - PAP)或扫雷潜水员进行的。

6 3 3 设计数字。 AC GruszynskL C Fayad。 LJT B da ...

这项关于数字设计的研究与一项更大的研究相关,该研究涉及计算机图形时代的视觉传达专业实践,其中包括传播专业的本科生和视觉艺术专业的研究生。在所讨论的子项目中,目标是鼓励未来的视觉传达专业人士探索 Macintosh 平台在执行典型设计任务时计算机图形的潜力和局限性。为此,开发了试点任务(实验项目),以测试自今年 2 月以来 NID 提供的设备和软件(2 台 Macintosh Classic、1 台 Personal LaserWriter;Aldus SuperPaint、Aldus PageMaker、MS Word、Adobe Illustrator、Adobe Photoshop)。每位研究员的工作重点如下:(1)视觉识别程序、海报、传单和广告;(2)插图和图形效果;(3)摄影图像和动画编辑。同时,进行书目研究,并整理与项目感兴趣的文章的参考文件。在开发的项目中,我们重点介绍:UFRGS 信息学院的计划、视觉识别;中心宣传册

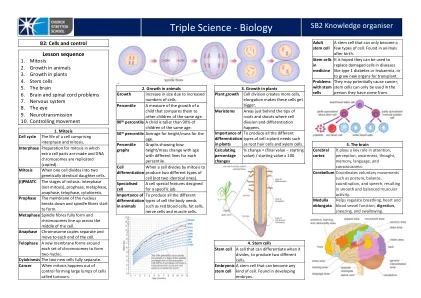

三重科学 - 生物学

8。瞳孔位于虹膜虹膜中心的一个孔,允许光撞击视网膜。虹膜控制瞳孔的直径和大小,从而控制到视网膜的光量。角膜覆盖虹膜和学生的眼睛的透明前部。镜头透明的双孔结构与角膜一起有助于折射光,以专注于视网膜上。视网膜要接收镜头聚焦,将光转换为神经信号的光,并将这些信号发送到大脑以进行视觉识别。视神经

arxiv:2110.13470v1 [cs.cv] 2021年10月26日

摘要。本文着重于基于脑电图的视觉识别,旨在预测受试者根据其脑电图信号观察到的视觉对象类别。主要挑战之一是不同受试者的信号之间的巨大变化。它限制了识别系统仅适用于模型培训所涉及的主题,这对于经常添加新主题的现实场景是不可能的。可以通过为每个新用户收集大量数据来缓解此限制,但有时是昂贵的,有时是不可行的。为了使任务更加实用,我们引入了一个新颖的问题设置,即基于自适应EEG的视觉识别。在此设置中,可以使用大量现有用户的预录用数据(源),而仅提供了新用户(目标)的少量培训数据。在推理时,仅根据目标用户的信号评估模型。此设置具有挑战性,尤其是因为在评估来自目标主题的数据的模型时,来自源主题的培训样本可能无济于事。为了解决新问题,我们设计了一个简单而有效的基线,该基线可最大程度地减少不同受试者的特征分布之间的差异,这使模型可以提取主题无关的特征。因此,我们的模型可以学习在受试者之间共享的常识,从而显着提高了目标主题的识别绩效。在实验中,我们在各种设置下证明了我们方法的效果。我们的代码可在此处获得1。

![arxiv:2110.13470v1 [cs.cv] 2021年10月26日](/simg/8\8c0fbd9c733984fddffae4a33c915bd778444b9d.webp)