机构名称:

¥ 1.0

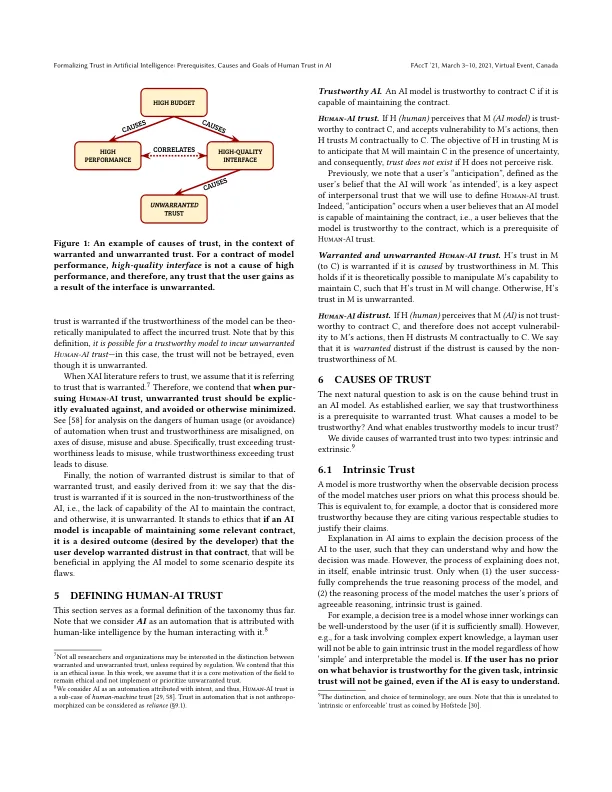

信任是人与人工智能互动的核心组成部分,因为“不正确”的信任程度可能会导致技术的误用、滥用或废弃。但人工智能中信任的本质究竟是什么?信任的认知机制的先决条件和目标是什么,我们如何促进它们,或评估它们在特定互动中是否得到满足?这项工作旨在回答这些问题。我们讨论了一种信任模型,该模型受到社会学家定义的人际信任(即人与人之间的信任)的启发,但并不完全相同。该模型基于两个关键属性:用户的脆弱性;以及预测人工智能模型决策影响的能力。我们结合了“契约信任”的形式化,即用户与 AI 模型之间的信任是某种隐性或显性契约将持有的信任,以及“可信度”的形式化(与社会学中的可信度概念不同),以及“有根据的”和“无根据的”信任的概念。我们将有根据的信任的可能原因描述为内在推理和外在行为,并讨论如何设计值得信赖的 AI,如何评估信任是否已经体现,以及信任是否有必要。最后,我们使用我们的形式化阐明了信任与 XAI 之间的联系。

人类对人工智能信任的先决条件、原因和目标