XiaoMi-AI文件搜索系统

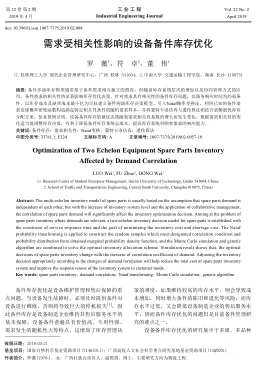

World File Search System需求受相关性影响的设备备件库存优化 - 工业工程

摘要:备件多级库存模型通常建立在备件需求相互独立的假设基础上,但随着库存系统层次的提高和协同管理的应用,备件需求的相关性将显著影响库存优化决策。针对需求相关的备件库存问题,以服务响应时间为约束,以最小化库存成本和缺货成本为目标,建立了备件两级库存决策模型。利用Nataf概率变换,从得到的边际概率密度函数中构造满足指定相关性条件和概率分布的随机样本,结合蒙特卡洛模拟和遗传算法求解最优库存分配方案。仿真结果表明,备件库存最优决策随着需求相关系数的增大而发生变化。调整库存

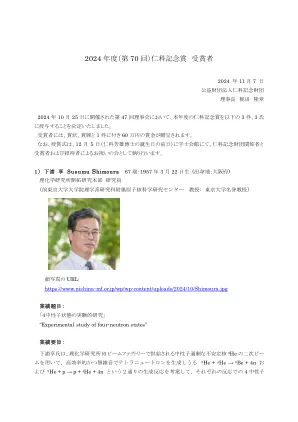

2024(70)Nishina纪念奖得主

图2 :(顶)8 He + P→P + 4 He + 4n反应的示意图。 (培养基)使用此反应的RIBF实验设备。左侧的8 HE梁被入射,并与氢靶标反应,并使用由电磁体和一组探测器组成的武士光谱仪分析了生成的4和质子P。 (底部)获得的4个中子系统的能量光谱。水平轴E 4n是4-中子系统的能量,减去4-中子的质量总和。观察到峰(红线)显示了MEV的四脉,宽度γ= 1.75±0.22(统计)±0.30(标准)MEV。

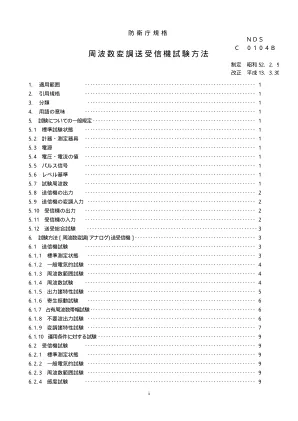

调频发射机/接收机测试方法

显示 R 1 = 75Ω R a = 50Ω 的情况。 R 2・R 3:耦合电路的电阻 E:SG 输出电压 dBμ V 测试设备的输入信号电平:E-6 [dBμ V]

医疗保健领域对人工智能的接受度

3 另外,道具的展示顺序也是随机的。 4 由于10个项目中有4个被呈现,因此如果随机呈现,每个项目出现的次数可能会有所不同。因此,可以使用平衡的不完全区组设计(Louviere 和 Flynn,2010)来确保项目出现的频率相等。然而,由于本章的样本量非常大,达到 150,010(使用下面描述的计数方法),我们确定由于随机呈现而导致的出现次数差异很小。

桂宿舍E栋集体邮件收集更换工程

2024 年 10 月 17 日——... 规格仅为标准尺寸,因此在实际工作之前,请务必在现场进行测量和勘察。 此外,我们还将对必要的事项进行监督。

荣获日本人工智能学会2023年度研究小组优秀奖

颁奖典礼 2023年度研究组优秀奖将颁发给2023年4月至2024年3月期间举行的日本人工智能学会年会上发表的特别优秀的研究论文。 住电株式会社通过其特殊子公司住电Friend株式会社(以下简称“Friend”),主要推进残疾人士的就业。 在本文中,我们报告了与 Friend 合作应用“残疾人参与式主动学习”的案例研究。我们已通知弗兰德的员工,他们的工作迄今为止主要集中在办公室支持任务上,他们将能够通过创建评估我们主要产品(如电线和电缆)的人工智能直接参与设计和质量评估过程。 颁发此奖是为了认可该项目在考虑“未来社会的人工智能”方面的重要性,将其作为创造一个让更多残障人士能够在公司各种任务中发挥积极作用的环境以及有效利用深度学习技术的一项新举措。欲了解更多详细信息,请参阅以下论文。 ■ 使用残疾人参与式主动学习方案对电线电缆产品进行线路追踪和详细质量评估 https://www.jstage.jst.go.jp/article/jsaisigtwo/2023/SAI-048/2023_01/_pdf/- char/ja

“社会认可”的概念分析:关于人工智能伦理

本次演讲的目的有两个。1) 通过介绍社会接受度和类似概念的概念分析和分类,促进人工智能技术等需要跨学科和跨学科研究的领域的合作与交流。2) 引入这种分类将澄清在 ELSI 和社会接受度讨论中可能没有被忽视的道德问题。为此,我们介绍了 Benham Taebi 对社会接受度和道德可接受度概念的区分,并开发了该区分的修改版本。通过在可接受度概念中引入经济和技术层面以及道德领域,可以澄清可接受度领域之间的冲突。这种澄清使人们能够更详细地讨论人工智能的道德问题。

机场电站应急发电机维护及检查服务

截止日期前 4 天 - 成功的竞标者将是团队设定的估计价格范围内提供最低出价的竞标者。但是,如果投标价格在预算、结算和会计命令(1949 年帝国法令第 165 号)第 85 条范围内...