机构名称:

¥ 2.0

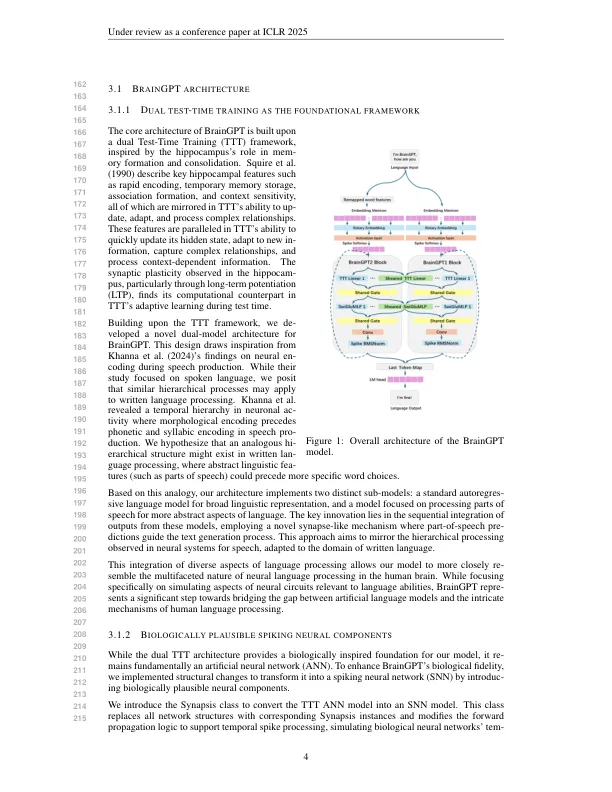

基于人工神经网络 (ANN) 的大型语言模型 (LLM) 表现出色,但在计算效率和生物可解释性方面面临挑战。我们提出了 BrainGPT,这是一种基于测试时间训练 (TTT) 框架并受到脉冲神经网络 (SNN) 和神经生物学原理启发的新型 LLM 架构。我们的方法采用双模型结构,模拟人脑中观察到的分层语言处理,并利用具有自适应阈值的专门积分和激发神经元模型。通过多阶段训练策略,包括量化感知预训练、ANN 到 SNN 的转换和受生物启发的无监督学习,我们实现了从 ANN 到 SNN 的数学证明的无损转换,保留了 100% 的原始 ANN 模型的性能。此外,受生物启发的无监督学习优化了维持 100% ANN 性能所需的最大时间步骤。与原始 TTT 模型相比,BrainGPT 的能源效率提高了 33.4%,训练收敛速度提高了 66.7%。这项工作推动了节能且可生物解释的大型语言模型的开发,这些模型的性能可与最先进的基于 ANN 的模型相媲美,同时显著改进了 TTT 框架。

BRAINGPT:一个受大脑启发的基于 SNN 的大型

主要关键词