XiaoMi-AI文件搜索系统

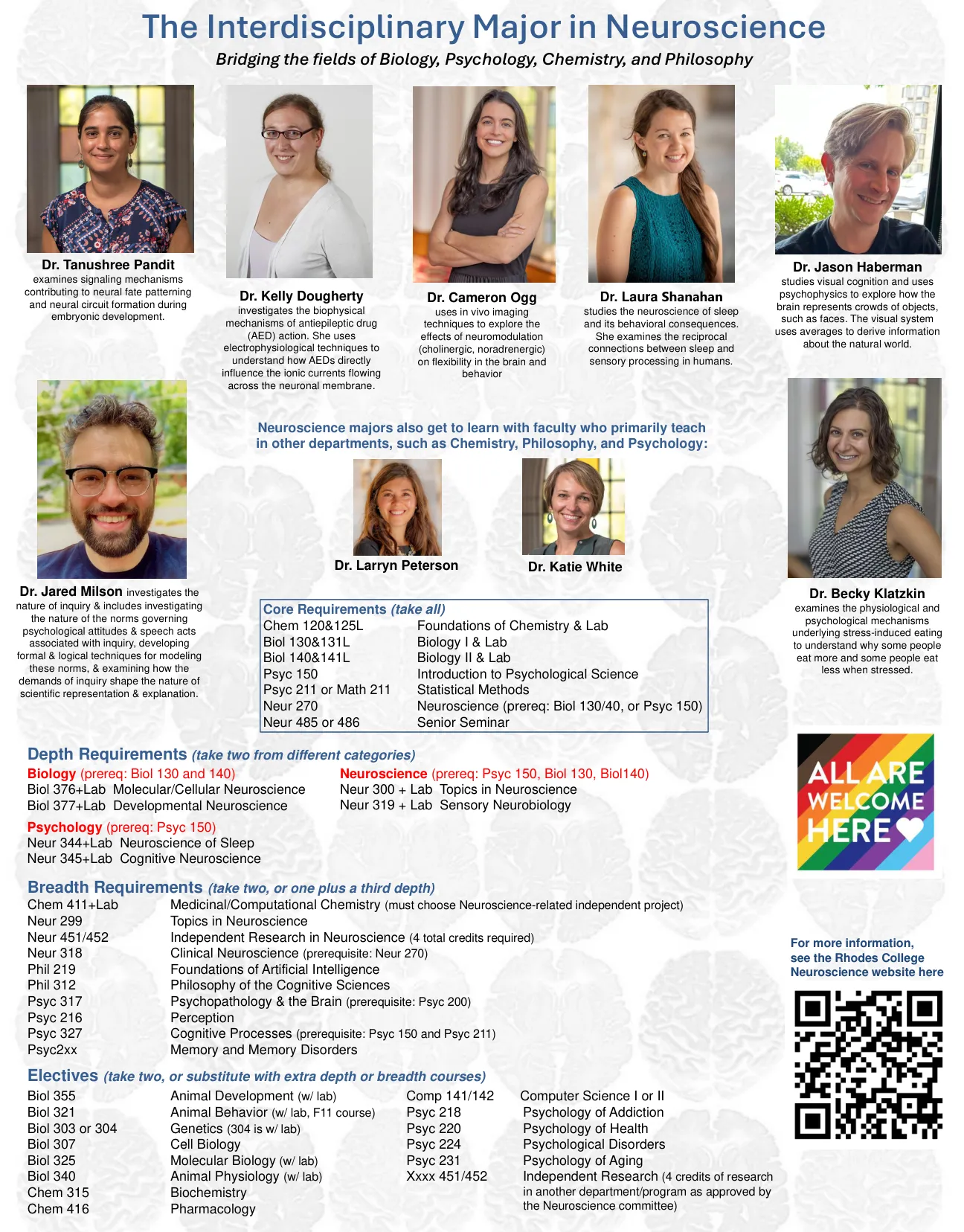

World File Search System连接生物学、心理学、化学和哲学领域

广度要求(选修两门,或一门加第三门深度课程) Chem 411+Lab 药物/计算化学(必须选择与神经科学相关的独立项目) Neur/Psyc 299 神经科学/心理学主题 Neur 451/452 神经科学独立研究(共需 4 个学分) Phil 219 人工智能基础 Phil 312 认知科学哲学 Neur 318 临床神经科学(先决条件:Neur 270 或 Psyc 200) Psyc 317 精神病理学与大脑(先决条件:Psyc 200) Psyc 216 感知 Psyc 327 认知过程(先决条件:Psyc 150 和 Psyc 200 或 211)

桥接生物学,心理学,化学和哲学领域

Breadth Requirements (take two, or one plus a third depth) Chem 411+Lab Medicinal/Computational Chemistry (must choose Neuroscience-related independent project) Neur 299 Topics in Neuroscience Neur 451/452 Independent Research in Neuroscience (4 total credits required) Neur 318 Clinical Neuroscience (prerequisite: Neur 270) Phil 219 Foundations of Artificial Intelligence Phil 312 Philosophy of the认知科学PSYC 317心理病理学与大脑(先决条件:PSYC 200)PSYC 216感知PSYC 327认知过程(先决条件:PSYC 150和PSYC 211)

课程目录描述每次提供本课程时,它涵盖了一个特定的哲学领域或西方和非W

人工智能(AI)。随着AI技术的迅速发展,从哲学的角度来理解其含义变得越来越重要。我们将研究人工智能和机器学习的性质,以及它们的道德,社会和形而上学的含义。该课程分为两部分。第一部分提供了对机器学习技术的基本理解,其工作方式,其当前局限性和问题是什么以及土著知识如何帮助支持更好,更符合道德的AI的发展。该课程的第二部分参与了与AI在艺术,战争,政治和劳动中的应用有关的哲学问题。我们会问诸如“人工智能可以制造艺术?”,“自主武器是战争更合理的形式?

课程完成后,学生将能够:

1。为学生提供了现代计算方法的基本原理(专家系统,遗传算法,神经网),这是对理解AI哲学问题所必需的。2。介绍了人工智能哲学领域中的一些中心,目前讨论了问题和关键概念:机器人伦理,机器行动的责任,人与人工制品之间的情感依恋话题,以及有关人类和非人类人格的条件的讨论。3。使学生能够以知情的,有争议的方式质疑自己对机器智力和人格的观念。4。为学生提供欣赏新的AI发展与生物伦理学,心理哲学和规范道德哲学(责任和责任)中类似问题的问题的联系。

人工智能、伦理与社会

AIES 会议每年由 AIES 指导委员会召集,其技术计划由来自计算机科学、法律与政策、社会科学、伦理学和哲学领域的计划联合主席设计。我们的目标是鼓励这些领域和相关领域的优秀学者展示和讨论与道德、法律、政策、心理学、其他社会科学和人工智能相关的最佳成果。除了从一开始就参与这些讨论的学者群体外,我们还明确欢迎对这一主题较新的学科专家,他们希望通过思考人工智能在自己的领域开辟新天地。在此背景下,我们对今年的计划感到非常兴奋,欢迎您参加 AIES 2023!

对自己进行建模:自由能原理揭示了我们对代表的隐性概念

抽象的预测处理理论在心理哲学中越来越流行;这种过程理论通常从自由能原理(FEP)获得支持 - 自适应自组织系统的规范原理。然而,关于FEP的哲学解释,例如代表性与非代表性的哲学解释存在当前的辩论。在这里,我们认为这些不同的解释取决于关于限定(或不符合资格)代表性的隐式假设。我们在工具上部署自由能原理(FEP),以区分四个主要的代表概念,分别侧重于组织,结构,内容相关和功能方面。讨论了这些不同方面在产生自由能原理的代表性或非代表性解释方面重要的各种方式。我们还讨论了如何将自由能原理视为一种统一的观点,即传统上属于不同本体论的术语 - 例如,模型和期望的概念与自动载体和同步的概念可以得到协调。但是,本文并没有试图解决代表主义者与非代表性的辩论,并揭示了一些简单的代表权,而是展示了如何使用自由能原则来揭示有关参与辩论的人的事物;也就是说,我们对哪种表示形式的隐藏假设 - 在这个持续的哲学辩论中有时是对立的起点的假设。“严厉地握住它!看到它退回!(是谁?是你吗?)”沃尔特·惠特曼(Walt Whitman)的“手机镜”(1860)简介在计算和系统神经科学上围绕大脑是一种预测机器,它使用内部(生成的)模型来连续生成感知,动作和学习的服务。一种围绕这个想法并迅速获得突出的理论 - 尤其是在心理和认知科学哲学领域 - 预测性处理(PP)(Clark,2013; Hohwy,2013,2020)。自由能原理(FEP)是一项规范性建议,扩展了PP,为其提供了适应性自组织的基本原理(Hohwy,2020)。FEP和相关的预测处理在神经科学之外迅速获得了突出,尤其是在心理哲学领域(Clark,2013; Hohwy,2013,2020)。尽管这一事实,FEP的一些基本含义

人工智能伦理中的信任与可信度

摘要 由于人工智能(AI)研究及其部署和应用的广泛进展,近年来有关人工智能系统的公开辩论也获得了动力。随着《可信赖人工智能伦理指南》(2019)的发布,信任和可信度的概念在人工智能伦理辩论中引起了特别的关注;尽管人们普遍认为人工智能应该值得信赖,但信任和可信度在人工智能领域的含义并不明确。在本文中,我详细概述了迄今为止《人工智能伦理指南》中使用的信任概念。在此基础上,我从实践哲学的角度评估了它们的重叠和遗漏。我认为,目前,人工智能伦理倾向于过载可信度的概念。因此,它有可能成为一个流行词,无法转化为人工智能研究的工作概念。然而,我们需要的是一种方法,这种方法也借鉴了其他领域对信任的研究成果,例如社会科学和人文学科,尤其是实践哲学领域。本文旨在朝这个方向迈出一步。

电子科学出版物

Oleg Volodymyrovych Batiuk – 法学候选人,副教授; Mykhailo Mykhailovych Birgeu – 法学博士、教授(摩尔多瓦共和国); Inna Viktorivna Bolokan – 法学博士、副教授; Botnaru Stela - 法学博士、副教授; Brynza Serhiy – 教授、康复训练博士; Natalya Volodymyrivna Verlos - 法学博士、副教授; Wojciech Wojtyla - 哲学领域人道主义科学博士(波兰共和国); Voloshyna Vladlena Kostyantynivna – 法学候选人,副教授; Natalya Viktorivna Galitsyna – 法学博士、教授; Nataliya Zenoviivna Derevyanko – 法学哲学博士; Petro Vasyliovych Dikhtievskyi – 法学博士、教授; Dudorov Oleksandr Oleksiyovych – 法学博士、教授; Ibragimov Solijon Ibragimovych - 法学博士、教授(塔吉克斯坦共和国); Kolpakov Valery Kostiantynovych - 法学博士、教授; Kurinny Yevhen Volodymyrovych – 法学博士、教授; Kushnir Serhiy Mykolayovych – 法学博士、教授; Maksym Ivanovich Smirnov – 法学候选人,副教授; Semen Hryhorovych Stetsenko – 法学博士、教授; Mykhailo Mykhailovych Ternuschak – 法学博士;威廉·J.Watkins – 法学博士(美国); Fedchyshyn Dmytro Volodymyrovych - 法学博士; Sharaya Anna Anatolyivna – 法学候选人,副教授。

人类大脑自组织的七个特性

摘要:自组织原理在新兴的计算哲学领域具有根本意义。自组织系统已在科学和哲学的各个领域得到描述,包括物理学、神经科学、生物学和医学、生态学和社会学。虽然系统架构及其一般用途可能取决于特定领域的概念和定义,但大脑系统中明确确定了自组织的(至少)七个关键特性:1)模块化连接,2)无监督学习,3)自适应能力,4)功能弹性,5)功能可塑性,6)从局部到全局的功能组织,以及 7)动态系统增长。本文根据神经生物学、认知神经科学和自适应共振理论 (ART) 以及物理学的见解对这些特性进行了定义,以表明自组织在最小化结构系统复杂性的同时实现了稳定性和功能可塑性。本文讨论了一个基于实证研究的具体示例,以说明模块化、自适应学习和动态网络增长如何为人类握力控制提供稳定而可塑的体感表征。提出了对机器人“强”人工智能设计的启示。