XiaoMi-AI文件搜索系统

World File Search System传感器数据如何强化机器人中的AI

所述资源可供专业开发人员应用 TI 产品进行设计使用。您将对以下行为独自承担全部责任: (1) 针对您的应用选择合适的 TI 产品; (2) 设计、 验证并测试您的应用; (3) 确保您的应用满足相应标准以及任何其他安全、安保或其他要求。所述资源如有变更,恕不另行通知。 TI 对您使用 所述资源的授权仅限于开发资源所涉及 TI 产品的相关应用。除此之外不得复制或展示所述资源,也不提供其它 TI 或任何第三方的知识产权授权 许可。如因使用所述资源而产生任何索赔、赔偿、成本、损失及债务等, TI 对此概不负责,并且您须赔偿由此对 TI 及其代表造成的损害。

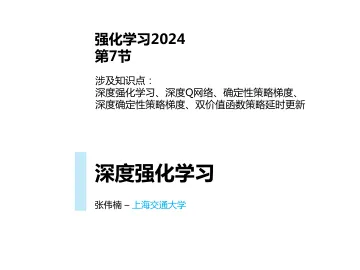

基于深度强化学习算法的火力⁃目标分配方法

plaa m makingabilit p e,whichcanp, the:lightife for:lightife fim⁃taietassignmietassignmient;diepieinfoifieinfoightimciemientlieaightimning;q⁃l

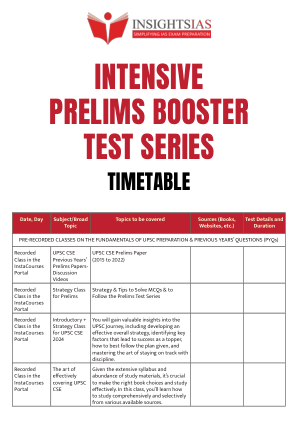

强化初赛强化测试系列

» 森林及其分布 » 森林保护 » 动物区系 印度经济和人文地理 • 印度的农业类型和主要作物 • 农业气候区 • 土地改革和土地利用模式 • 畜牧业、渔业和水产养殖 • 水资源 - 可用性和潜力:湖泊、河流、水坝、电力和灌溉项目、湿地和河流交汇处 • 矿产资源 - 分类和分布 • 能源资源 - 常规和非常规资源 • 印度的人口和增长趋势 - 密度、性别比例、识字率、部落和种族群体 • 农村和城市定居点 - 类型和模式 • 行业 - 类型及其位置因素 • 交通和通讯 - 铁路、公路、内陆水运、航运和海港、航空运输 • 来自印度的基于地图的问题(州、城市、河流、湖泊、重要地点(包括拉姆萨尔遗址、生物圈保护区、野生动物保护区和国家公园)的位置)

基于强化学习

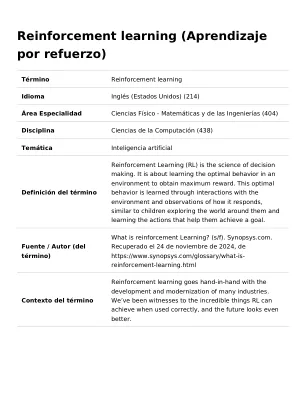

摘要:乘车共享中的核心问题是设计合理的算法以匹配驱动程序和Pasengers。受到各种约束的影响,例如在现实世界中的天气,流量和供应按需动态,需要优化多个目标,例如总平台收入和乘客等待时间。由于其在约束和优化目标方面的复杂性,乘车共同的匹配问题成为移动运输领域的核心问题。但是,现有的研究缺乏对驾驶员收入公平性的探索,并且某些算法实际上不适用于工业环境。为了解决这些缺点,我们开发了一种面向公平的动态匹配算法,用于乘车共享,有效地优化了驾驶员之间的总体平台效率(预期的总驾驶员收入)和收入公平(驱动程序之间加权摊销公平信息的熵)。首先,我们在场景设置中引入了匹配结果对随后匹配的时间依赖性,并使用了强化学习来预测这些时间依赖性,克服了仅依赖历史数据和当前情况下订单分配的传统匹配算法的限制。然后,我们实施了一系列优化解决方案,包括引入时间窗口匹配模型,修剪操作和度量表示调整,以增强算法的适应性和大型数据集的可伸缩性。这些解决方案还确保该算法的效率。最后,在实际数据集上进行的实验表明,基于强化学习的公平性算法分别在公平,平台效用和匹配效率方面,比传统算法相比,改善了81.4%,28.5%和79.7%。

使用强化

菲律宾不健康的饮食习惯,包括食用垃圾食品,引起了健康风险,例如肥胖,糖尿病和心血管疾病。回应,人们对植物性饮食的兴趣越来越大,该饮食强调水果,蔬菜,全谷物和豆类,并且在管理2型糖尿病等疾病方面一直有效。为了解决这些健康问题,研究人员开发了一种基于植物性的芝士蛋糕,作为一种营养和无乳制品的甜点。这项通过批量数据收集进行的研究主要涉及来自Z Gen gen Age Group(10-25岁)的参与者,其中一半以上是女性。各种芝士蛋糕配方,S498,缺乏复合蔬菜成分的S498,因为其中性口口相传,其质地,出色的纹理和味道是首选的。它的象牙白色颜色与受控的芝士蛋糕非常相似,从而增强了其整体吸引力。进行营养分析,研究人员选择了配方S256,因为其复合蔬菜成分,与制作健康甜点的目标保持一致。该研究最终以无乳制品的植物性芝士蛋糕为顶,以迎合越来越多的女性采用植物性饮食。包括Momordica Charantia(苦瓜)的S256的感觉分析显示,使用原子吸收分光光度法确定了明显的矿物质含量(62.69%铁和20.11%锌)。此外,它含有40.70%的维生素C,通过高性能液相色谱法确定,增强了芝士蛋糕的营养价值。这项研究支持全球向基于植物的饮食的转变,促进了烹饪知识并使个人和社区受益。