XiaoMi-AI文件搜索系统

World File Search SystemMOS2中的Moiré工程光 - 摩擦相互作用... 引用了原始发表的论文(记录的版本):Jafarzadeh,S.,Nooshkam,M.,Qazanfarzadeh,Z。等(2024)。解锁潜在的O 加油否认:气候变化反动运动和瑞典极右媒体 有效的微孔子频率梳 可用性比较拟人化数字人的健康参与者和基于文本的聊天机器人,以此作为对心理健康问题的响应者:随机对照试验 朝着光网络中的可解释的强化学习:RMSA用例 和电热膜蒸馏 基于滑动触摸的探索,用于用多指双手建模未知对象形状 原子能洞察纳米片分裂水的竞争边缘 引用原始发表的论文(记录的版本):Konzock,O。,Nielsen,J。(2024)。试图评估微生物Biote的生产成本 引用了原始发表的论文(记录的版本):Bainsla,L.,Zhao,B.,Behera,N。等(2024)。 中的大面外旋转轨道扭矩 引用了原始发表的论文(记录的版本):Monsel,J。,Ciers,A.,Kini Manjeshwar,S。等(2024)。耗散和色散cav 引用了原始发表的论文(记录的版本):Kumar,R。,Srivastav,S.,Roy,U。等(2024)。镁的电噪声光谱 用快速电子梁探测光学叠液 基于机器学习的极化签名分析,用于检测和分类窃听事件和有害事件

van der waals异质结构中的Moiré超级晶格代表了高度可调的量子系统,在多体模型和设备应用中都引起了极大的兴趣。然而,在室温下,Moiré电位对光物质相互作用的影响在很大程度上仍然没有。在我们的研究中,我们证明了MOS 2 /WSE 2中的Moiré潜力促进了室温下层间激子(IX)的定位。通过执行反射对比光谱,我们证明了原子力显微镜实验支持的原子重建在修饰内部激子中的重要性。降低扭转角时,我们观察到IX寿命会更长,并且发光增强,表明诸如缺陷之类的非辐射衰减通道被Moiré电位抑制。此外,通过将Moiré超晶格与硅单模腔的整合,我们发现,使用Moiré捕获的IXS的设备显示出明显较低的阈值,与利用DelaCalized IXS的设备相比,较小的一个数量级。这些发现不仅鼓励在升高温度下在Moiré超晶格中探索多体物理学,而且还为利用光子和光电应用中的这些人工量子材料铺平了道路。

法国样本中的社会机器人拟人化量表(SRA)的开发和验证

Dayle David,Meggy Hayotte,PierreThérouanne,Fabienne d'Arripe-Longueville,Isabelle Milhabet。法国样本中社会机器人拟人化量表(SRA)的开发和验证。媒介人类计算机研究杂志,2022,162,pp.102802。10.1016/j.ijhcs.2022.102802。hal-03609583

建议引用:Hermann, Erik (2021):拟人化的人工智能、依恋和消费者行为,营销快报,ISSN 1573-059X,Springer US,纽约,第 33 卷,Iss。1,第 157-162 页,https://doi.org/10.1007/s11002-021-09587-3

人工智能 (AI) 是一种变革性的力量,正在(重新)塑造市场营销研究、战略和行动,可以概念化为“使用计算机器来模拟人类固有的能力,例如执行物理或机械任务、思考和感觉” (Huang & Rust, 2021 , p.31)。随着人工智能及其智能水平的稳步发展,人工智能的情感和社交能力以及人性化程度也有望提高。人工智能应用包括智能个人/数字助理(如 Siri 或 Alexa)、聊天机器人和服务机器人,已经具备人类的形态、名称和品质,例如人类的语音和交互以及情感感知能力(例如,Huang & Rust, 2021 ; Ramadan et al., 2021 ; Wan & Chen, 2021 )。将类似人类的属性和特征赋予非人类主体和物体,是拟人化的核心(Epley 等人,2007 年)。拟人化

61组织拟人化牙齿... div>

摘要。本文对拟人化牙齿机器人领域的现代发展及其在实践教育中的使用进行了回顾。该研究的目的是评估机器人拟人化的身体和功能方面,它们对学生的心理测量特征的影响以及对技术数据发展的前景分析。工作讨论了拟人化机器人的关键组成部分,例如运动传感器,系统识别系统和语音综合,以及使用云技术来提高教育过程的有效性的可能性。结果表明,拟人化机器人有助于改善教育技术,加深对教育材料的理解以及学生之间专业技能的发展。然而,注意到需要进一步研究的技术挑战,包括改善运动的现实主义,语音互动和感觉系统的整合。假定数据处理和云服务的进一步开发将有助于创建更具互动性和适应性的教育平台,这将增加学生的参与和满意度。

liu,Y.,Ning,S.,Zhang,M.,Font,X。,&Zeng,H。(2024)。可以拟人化1

研究假设实验设计拟人化解释提示类型研究1拟人化解释提示→文明的行为意图(主要效果)

所有人都太人性化了吗?绘制和减轻拟人化AI

由大语言模型承保的高度能力的对话代理的开发有可能以深刻的方式塑造用户与这项技术的互动,尤其是当技术是拟人化或类似于人类的技术时。尽管拟人化AI的影响通常是良性的,但拟人化设计功能也会带来新的风险。例如,用户可以与类似人类的AI建立情绪连接,从而产生通过过度依赖来侵犯用户隐私和自主权的风险。为了更好地理解拟人化AI系统的可能陷阱,我们做出了两个贡献:首先,我们表达了过去嵌入了交互式系统中的拟人化特征,并利用了这种先验来突出拟人化表征的当前影响。第二,我们提出了研究方向,以告知拟人化AI的道德设计。在进行AI负责任的发展时,我们将方法推广到通过用户与拟人化AI相互作用引起的伦理远见,评估和缓解危害的方法。

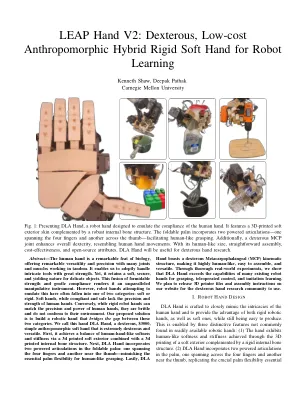

Leap Hand V2:灵巧,低成本的拟人化杂交刚性刚性软手,用于机器人学习

摘要 - 人类的手是生物学的非凡壮举,具有许多关节和肌肉的同时,具有出色的多功能性和精度。它使我们能够以极大的力量处理复杂的工具。然而,它保留了柔软,安全且屈服于精致物体的性质。强大的强度和柔和的合规性融合使其成为无与伦比的操纵仪器。但是,试图模拟这一点的机器人之手通常属于两个类别之一:软或刚性。柔软的手,虽然符合性和安全性缺乏人类手的精度和力量。相反,虽然刚性机器人的手可以与人体的精确性和力量相匹配,但它们是脆弱的,不符合其环境。我们提出的解决方案是建立一个机器人手,弥合这两个类别之间的差距。我们称此手DLA手,一种灵巧的,$ 3000,简单的拟人化软手,非常灵巧且多才多艺。首先,它通过3D打印的软外部与3D打印的内部骨结构相结合,达到了人体手状的柔软度和刚度的平衡。接下来,DLA手在可折叠的棕榈中结合了两个动力的表达:一个横跨四个手指,另一只手指靠近拇指,模仿了类似人类的握把的基本棕榈灵活性。最后,DLA

可用性比较拟人化数字人的健康参与者和基于文本的聊天机器人,以此作为对心理健康问题的响应者:随机对照试验

近年来,增强学习(RL)已成为一种有力的工具,可在光网络(例如路由和波长分配(RWA)[1]等光网络中解决复杂而染色的优化问题[1],路由,调制和频谱分配(RMSA)[2]以及虚拟网络嵌入[3]。RL实现的性能效果表明其在现实世界中的应用潜力。但是,与其他机器学习(ML)算法类似,RL模型具有黑盒性质,使它们难以解释。这种特征使RL模型难以信任,因此在实际的光网部署中采用。对于监督的ML模型,Shap(Shapley添加说明)[4]是一种可解释的AI方法,已被广泛采用。Shap是一种基于合作游戏理论的方法,用于量化单个特征对模型决策过程的影响。Shap值提供了对每个功能的相对重要性(影响)的见解,从而估算了它们如何对模型的输出做出贡献。将这种解释性框架应用于传播质量(QOT)预测任务时,已显示出有希望的属性[5]。最近,由于需要解释和使RL模型的决策过程透明的驱动,可解释的RL(XRL)受到了越来越多的关注。在光网络的上下文中,XRL的概念仍然相对尚未探索。先前建议通过反向工程网络状态[6]或网络中资源使用分析(链接)来解释和解释RL模型的决策[1,7]。但是,这些研究并未分析不同特征如何影响RL药物的决策。因此,在光网络背景下,RL代理学到的政策仍然存在一段差距。这至关重要,因为网络运营商需要在其在实际网络中部署之前了解RL学习策略背后的推理。在这项工作中,我们旨在利用Shap(Shapley添加说明)[4]来解释应用于RMSA问题的RL模型的行为。为此,我们提出了一种使用训练有素的RL代理的观察和行动来以有监督的学习方式训练ML模型的方法。由Shap使用所得的ML模型来提取解释。与[2]中的RMSA问题的每个组件分别求解,RL代理解决路由问题,基于路径长度的调制格式选择以及基于第一拟合策略的频谱分配。我们分析了该问题的三种变化,改变了奖励函数和选择RL代理的不可行的动作的可能性。我们特别有兴趣解释重要的网络和LightPath请求特征,该特征导致RL模型拒绝该请求。结果允许我们确定哪些功能和哪些值范围影响RL代理接受或拒绝LightPath请求。我们观察到,通过更改奖励功能,RL策略会更改拒绝请求时所考虑的重要功能。引入了防止RL模型采取不可行的措施的掩码,使功能的重要性更加均匀地分布在不同的路由选项上。我们认为,提出的方法对于增加将在真实网络中部署的RL模型的可信度可能是有价值的。

拟人化和AI炒作-UCL Discovery

人类对拟人化的天生倾向。我们不禁以独特的人类方式思考非人类,在非人类中“看到”类似人类的特征,并做出相应的反应[1]。,但是这些推论可能会产生误导。推断我们回家时很高兴见到我们是很安慰的,也许很自然。这样的推论对于我们的宠物狗来说似乎是合理的。,但对我们的宠物岩石来说却不太如此。随着复杂的AI的出现,技术人工制品的拟人化已经变得广泛[2,3]。这不是最不重要的,因为这种技术通常被设计为像人类一样。的确,在许多情况下,这就是推动他们成功的原因。流行的基于LLM的Convertion App replika获得了知名度,因为它对用户感到与人交谈的感觉。replika用户认为他们的replika具有某些人类属性,例如情感的能力(例如,爱情,欲望,狂热,善良和悲伤)。这部分是因为聊天机器人伴随着类似人类的头像。,这也是因为它有能力维持人级对话并使用第一人称代词,Ben Schneiderman和Micheal Muller对[4]批评了GPT-4。

人工智能中的拟人化:炒作与谬论

魏森鲍姆一生中的大部分时间都在警告人们将人类特质投射到人工智能上会带来危险。本论文同样通过主要关注人工智能拟人化的一些负面伦理后果,对人工智能的拟人化进行了研究。对这些后果进行详尽的分析几乎是不可能的,但通过关注拟人化作为一种炒作形式和谬论,本文表明了拟人化如何夸大了人工智能系统的能力和性能,以及扭曲了对它们的一系列道德判断。本文的结构如下。在第一部分,本文解释了拟人化的含义,以及这种现象在人工智能领域的一些表现方式。本文重点指出拟人化是围绕人工智能的炒作的一个组成部分。在这种情况下,炒作被理解为对人工智能能力和性能的歪曲和夸大,而炒作的组成部分则被理解为炒作的一部分。在第二部分中,本文表明拟人化通过其谬误性扭曲了道德判断。它通过关注人工智能的四个核心道德判断来说明这一点:关于其道德品质和地位的判断,以及关于对人工智能的责任和信任的判断。第三部分通过提供简短的总结和结论结束了这项工作。* Adriana Placani adrianaplacani@fcsh.unl.pt