XiaoMi-AI文件搜索系统

World File Search SystemImageNet 十年之后:人工智能的 360° 视角

神经网络回归已有 10 年。在这一周年纪念日的推动下,我们对人工智能 (AI) 采取了整体视角。认知任务的监督学习得到了有效解决——前提是我们拥有足够高质量的标记数据。然而,深度神经网络模型不易解释,因此黑盒和白盒建模之间的争论成为了焦点。注意力网络、自我监督学习、生成建模和图神经网络的兴起拓宽了人工智能的应用空间。深度学习也推动了强化学习作为自主决策系统核心构建块的回归。新人工智能技术可能带来的危害引发了透明度、公平性和问责制等社会技术问题。控制人才、计算资源以及最重要的数据的大型科技公司在人工智能领域的主导地位可能会导致人工智能的极端分化。尽管人工智能驱动的对话代理最近取得了戏剧性和出人意料的成功,但备受瞩目的旗舰项目(如自动驾驶汽车)的进展仍然难以捉摸。必须小心调节该领域的言论,并使工程进步与科学原理保持一致。

人工智能的 360° 视角 - ePrints Soton

神经网络回归已有 10 年。在这一周年纪念日的推动下,我们对人工智能 (AI) 采取了整体视角。认知任务的监督学习得到了有效解决——前提是我们拥有足够高质量的标记数据。然而,深度神经网络模型不易解释,因此黑盒和白盒建模之间的争论成为了焦点。注意力网络、自我监督学习、生成建模和图神经网络的兴起拓宽了人工智能的应用空间。深度学习也推动了强化学习作为自主决策系统核心构建块的回归。新人工智能技术可能带来的危害引发了透明度、公平性和问责制等社会技术问题。控制人才、计算资源以及最重要的数据的大型科技公司在人工智能领域的主导地位可能会导致极端的人工智能鸿沟。尽管最近人工智能驱动的对话代理取得了戏剧性和出人意料的成功,但自动驾驶汽车等备受瞩目的旗舰项目的进展仍然难以捉摸。必须注意缓和围绕该领域的言论,并使工程进展与科学原理保持一致。

ImageNet 十年之后:人工智能的 360° 视角

神经网络回归已有 10 年。在这一周年纪念日的推动下,我们对人工智能 (AI) 采取了整体视角。认知任务的监督学习得到了有效解决——前提是我们拥有足够高质量的标记数据。然而,深度神经网络模型不易解释,因此黑盒和白盒建模之间的争论成为了焦点。注意力网络、自我监督学习、生成建模和图神经网络的兴起拓宽了人工智能的应用空间。深度学习也推动了强化学习作为自主决策系统核心构建块的回归。新人工智能技术可能带来的危害引发了透明度、公平性和问责制等社会技术问题。控制人才、计算资源以及最重要的数据的大型科技公司在人工智能领域的主导地位可能会导致人工智能的极端分化。尽管人工智能驱动的对话代理最近取得了戏剧性和出人意料的成功,但备受瞩目的旗舰项目(如自动驾驶汽车)的进展仍然难以捉摸。必须小心调节该领域的言论,并使工程进步与科学原理保持一致。

巨大的量子加速需要多少结构?

我面向广大科学界人士,介绍了三十年来哪些类型的问题可以通过量子计算机实现指数级加速的研究——从经典算法(如 Simon 和 Shor 的算法)到 2022 年 4 月 Yamakawa 和 Zhandry 的突破。我既讨论了量子电路模型(这是我们在实践中最终关心的,但我们的知识根本不完整),也讨论了所谓的 oracle 或黑盒或查询复杂性模型,我们已经设法获得了更为透彻的理解,然后为我们对电路模型的猜想提供了信息。我讨论了将注意力转移到采样任务上的优缺点,就像在最近的量子霸权实验中所做的那样。我对广泛重复的关于实际机器学习和优化问题的指数量子加速的说法提出了一些怀疑。通过许多例子,我试图传达“奇异守恒定律”,根据该定律,每个允许指数量子加速的问题都必须具有一些不寻常的属性,以允许振幅集中在未知的正确答案上。2022 年 5 月 21 日在比利时布鲁塞尔举行的第 28 届索尔维物理会议上发表的报告员演讲的编辑记录。

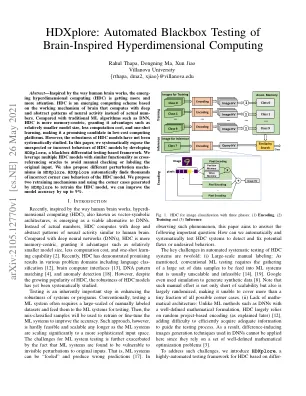

HDXPlore:自动化的黑盒测试脑启发的超维度计算

摘要 - 由人脑的工作方式吸引,急剧的高维计算(HDC)正在受到越来越多的关注。HDC是一种基于大脑的工作机理的新兴计算方案,该方案具有深层和抽象的神经活动模式而不是实际数字。与传统的ML算法(例如DNN)相比,HDC以内存为中心,授予其优势,例如相对较小的模型大小,较小的计算成本和一声学习,使其成为低成本计算平台中的有前途的候选人。但是,尚未系统地研究HDC模型的鲁棒性。在本文中,我们通过开发基于黑盒差异测试的框架来系统地揭示HDC模型的意外或不正确行为。我们利用具有与交叉引用甲环类似功能的多个HDC模型,以避免手动检查或标记原始输入。我们还提出了HDXplore中不同的扰动机制。HDXplore自动发现了HDC模型的数千种不正确的角案例行为。我们提出了两种重新训练机制,并使用HDXplore生成的角病例来重新培训HDC模型,我们可以将模型准确性提高高达9%。

智慧城市可解释人工智能调查

摘要:可解释人工智能 (XAI) 的出现改善了人类的生活,并设想了使用明智行动、增强的用户解释和解释以及坚定的决策过程的智能城市概念。XAI 系统可以释放黑盒 AI 模型的潜力并明确描述它们。该研究全面调查了智能城市 XAI 技术的当前和未来发展。它还强调了推动智能城市 XAI 发展的社会、工业和技术趋势。它详细介绍了实现智能城市 XAI 技术的关键。本文还讨论了智能城市的 XAI 概念、各种 XAI 技术用例、挑战、应用、可能的替代解决方案以及当前和未来的研究增强。详细概述了研究项目和活动,包括为智能城市开发 XAI 的标准化工作。总结了从最先进研究中吸取的经验教训,并讨论了各种技术挑战,以揭示未来研究可能性的新见解。所提出的关于智慧城市的 XAI 研究是首创的、严谨的、详细的研究,旨在帮助未来的研究人员为智慧城市实施 XAI 驱动的系统、架构和应用程序。

ImageNet 十年之后:人工智能的 360° 视角

神经网络回归已有 10 年。在这一周年纪念日的推动下,我们对人工智能 (AI) 采取了整体视角。认知任务的监督学习得到了有效解决——前提是我们拥有足够高质量的标记数据。然而,深度神经网络模型不易解释,因此黑盒和白盒建模之间的争论成为了焦点。注意力网络、自我监督学习、生成建模和图神经网络的兴起拓宽了人工智能的应用空间。深度学习也推动了强化学习作为自主决策系统核心构建块的回归。新人工智能技术可能带来的危害引发了透明度、公平性和问责制等社会技术问题。控制人才、计算资源以及最重要的数据的大型科技公司在人工智能领域的主导地位可能会导致人工智能的极端分化。尽管人工智能驱动的对话代理最近取得了戏剧性和出人意料的成功,但备受瞩目的旗舰项目(如自动驾驶汽车)的进展仍然难以捉摸。必须小心调节该领域的言论,并使工程进步与科学原理保持一致。

黑箱人工智能在福利索赔行政裁决中的合意应用的规范维度

最近,要求行政紧缩的呼声包括要求机构在做出有关福利资格的决定时,用更少的资源做更多的事情。1 这种经济逻辑与自动审议纠纷的商业案例相吻合。计算法律研究领域提出了部署自然语言处理来分类案件申请,或以其他方式在过去的裁决中寻找模式,以便为解决纠纷提供信息(甚至完成)。2 例如,过去,某种医疗记录组合可能总是导致获得残疾福利。行政人员可能会决定快速处理此类索赔,甚至可能决定根据这些医疗记录授予福利。相反,看起来与过去成功的索赔太不一样的索赔可能会在一开始就被拒绝,理想情况下会给出一些如何改进的指示。从长远来看,更雄心勃勃的监控计划可能会为行政裁决提供信息。例如,美国有人呼吁通过证据审查福利接受者的资格,这些证据可能包括监视他们的社交媒体信息。3 然而,使用黑盒人工智能来拒绝

人工智能为何会犯这个错误? - Periscope

越来越复杂的学习方法(例如 boosting、bagging 和深度学习)使 ML 模型更加准确,但更难解释和说明,最终形成了黑盒机器学习模型。模型开发人员和用户通常都会在性能和可理解性之间做出权衡,尤其是在医学等高风险应用中。在本文中,我们提出了一种新颖的方法,用于在给定特定实例的情况下为通用机器学习模型的预测生成解释。该方法名为 AraucanaXAI,基于替代的局部拟合分类和回归树,用于提供通用机器学习模型预测的事后解释。所提出的 XAI 方法的优势包括对原始模型的卓越保真度、处理非线性决策边界的能力以及对分类和回归问题的本机支持。我们提供了 AraucanaXAI 方法的打包开源实现,并在 AI 的医疗应用中常见的多种不同设置中评估了其行为。这些问题包括模型预测与医生专家意见之间可能存在的分歧以及由于数据稀缺导致的预测可靠性低。

超越可解释性的 AI 可解释性要求

摘要 随着人工智能 (AI) 在社会中的兴起,越来越多的人开始在日常生活中接触复杂且不透明的软件系统。这些黑盒系统通常难以理解,因此对最终用户来说并不可信。可解释人工智能 (XAI) 的研究表明,解释有可能解决这种不透明性问题,使系统更加透明和易于理解。然而,可解释性和可解释性之间的界限充其量是模糊的。虽然 XAI 中对可解释性有许多定义,但大多数定义都没有超越输出的合理性,即提供可解释性。与此同时,XAI 之外的当代研究已经采用了更广泛的可解释性定义,并研究了除算法及其输出之外的系统方面。在本立场文件中,我们认为 AI 系统的需求工程师需要考虑可解释性以外的可解释性要求。为此,我们提出了一个医疗领域的假设场景,该场景展示了 XAI 研究人员通常不会考虑的各种不同的可解释性要求。这篇文章旨在在 XAI 社区中引发讨论,并激励 AI 工程师在提出可解释性要求时跳出黑匣子。