机构名称:

¥ 1.0

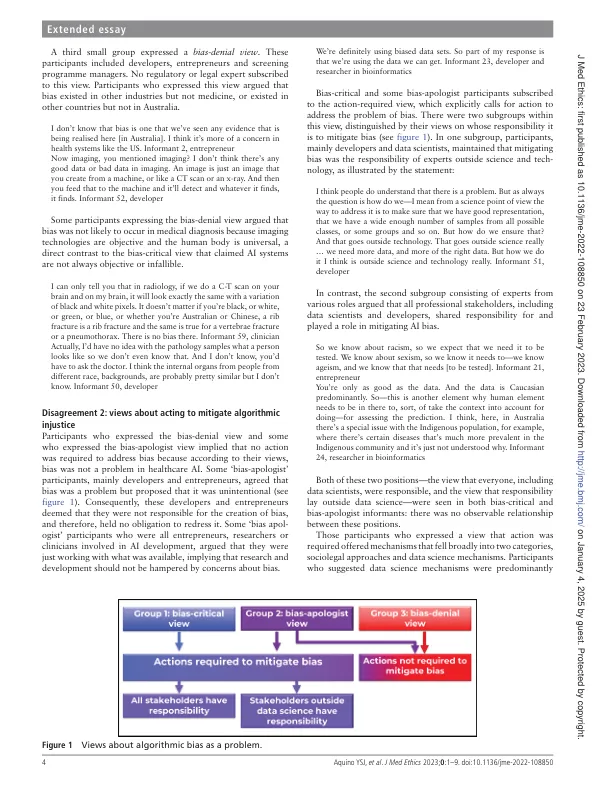

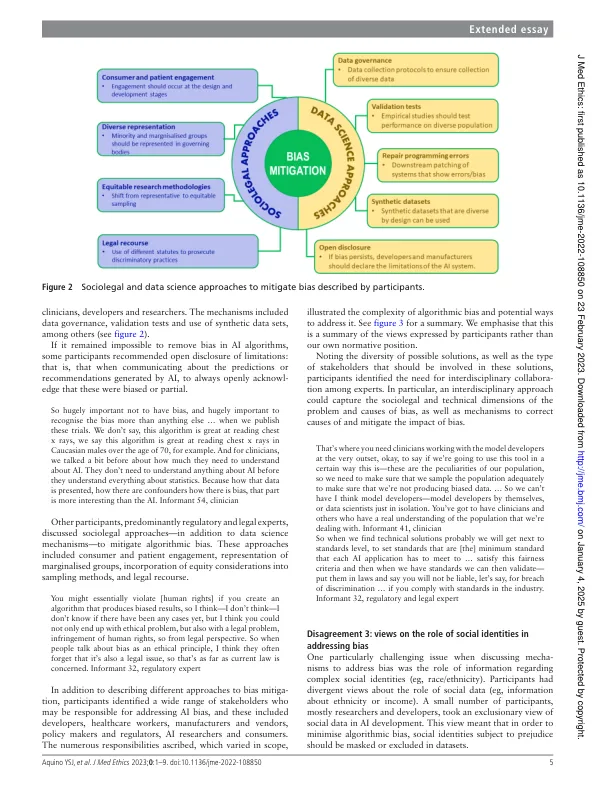

摘要背景人们越来越担心人工智能 (AI) 在医疗保健领域的应用可能会使本已代表性不足和边缘化的群体处于不利地位(例如基于性别或种族)。目标我们的目标是调查利益相关者在试图减轻算法偏见时所认可的各种策略,并考虑算法偏见责任的伦理问题。方法这项研究涉及对医疗保健工作者、筛查项目经理、消费者健康代表、监管者、数据科学家和开发人员的深入、半结构化访谈。结果研究结果显示在三个关键问题上存在相当大的不同观点。首先,对于偏见是否是医疗保健 AI 中的一个问题,人们的看法各不相同,大多数参与者都同意偏见是一个问题(我们称之为偏见批判观点),少数人持相反观点(偏见否认观点),还有一些人认为人工智能的好处大于偏见问题带来的任何伤害或错误(偏见辩护者观点)。其次,对于减轻偏见的策略以及谁应该对这些策略负责存在分歧。最后,对于是否在人工智能的发展中纳入或排除社会文化标识符(例如种族、民族或性别多元化身份)以减轻偏见,存在不同的看法。结论/意义根据参与者的观点,我们列出了利益相关者可能采取的应对措施,包括加强跨学科合作、量身定制的利益相关者参与活动、了解算法偏见的实证研究和修改人工智能开发中主导方法的策略,例如使用参与式方法,以及增加研究团队和研究参与者招募与选择的多样性和包容性。

一项定性研究

主要关键词

![征文:教育和教育研究中的人工智能国际研讨会 (AIEER) AIEER 2024 教育和教育研究中的人工智能国际研讨会是第 27 届欧洲人工智能会议 ECAI 2024 [https://www.ecai2024.eu/] 的一部分。本次研讨会定于 2024 年 10 月 19 日至 20 日星期六和星期日举行。 研讨会范围 本次研讨会有两个不同的重点,旨在更广泛地面向教育人工智能领域。 第 1 部分。由社会科学主导的讨论,讨论人工智能应用可能有助于解决的教育中的实际问题。这包括教育和教学人工智能的研究,也包括社会科学、经济学和人文学科,包括所有学科,如教育和教学实际行动、以教育需求为重点的劳动力市场研究、教育史和相关教育文化遗产,以及决策和行为科学观点的信息预测。一方面,我们关注人工智能、教育和社会之间的联系。这包括定量和定性研究、分析教育和劳动力市场数据的数据科学方法、推荐系统的人工智能方法以及数字化学习。另一方面,我们关注如何使用人工智能来突破该领域的界限。这包括开发新方法(包括使用人工智能的方法)、寻找和提供可访问的新数据源、丰富数据等等。在这两种情况下,不同观点之间的沟通和相互理解至关重要,这也是本次研讨会的目标之一。更广泛地说,我们感兴趣的是人工智能方法如何影响教育的所有领域以及企业和劳动力市场。这包括从小学到高等教育的所有教育部门如何受到人工智能方法的影响和对其作出反应的方法。用人工智能方法设计数字化未来为教育提出了几个问题:在最广泛的层面上,立法和规范问题;在公司层面,关于投资决策以及如何保持生产力和劳动力的问题;在个人层面,关于资格以及哪些技能需要应用和可能重新学习的问题。因此,技能和资格是教育和教育研究中人工智能的核心。第 2 部分。关于可以开发哪些人工智能应用程序(以及如何开发)来解决第 1 部分提出的问题的(计算机科学主导)讨论。使用基于人工智能的系统来支持教学或学习已经发展了 40 多年,但近年来,由于 COVID-19 大流行期间电子学习工具的使用增加以及最近生成人工智能的爆炸式增长,其增长显着增加。我们正处于这一领域发展的关键时刻,人工智能专家和教育专家必须携手合作,以在教学过程中最佳地利用这项技术。本次研讨会旨在为展示新提案和反思这一具有如此社会意义的领域的最新技术创造空间。在第一部分中,我们特别关注人工智能的技术方面,重点关注用于内容创建(生成式人工智能)、学生分析(机器学习)、学习分析或教师可解释的人工智能方法的具体技术](/simg/9/997626a7f59d17e25a28a70110fbadb440a4a51a.png)