机构名称:

¥ 1.0

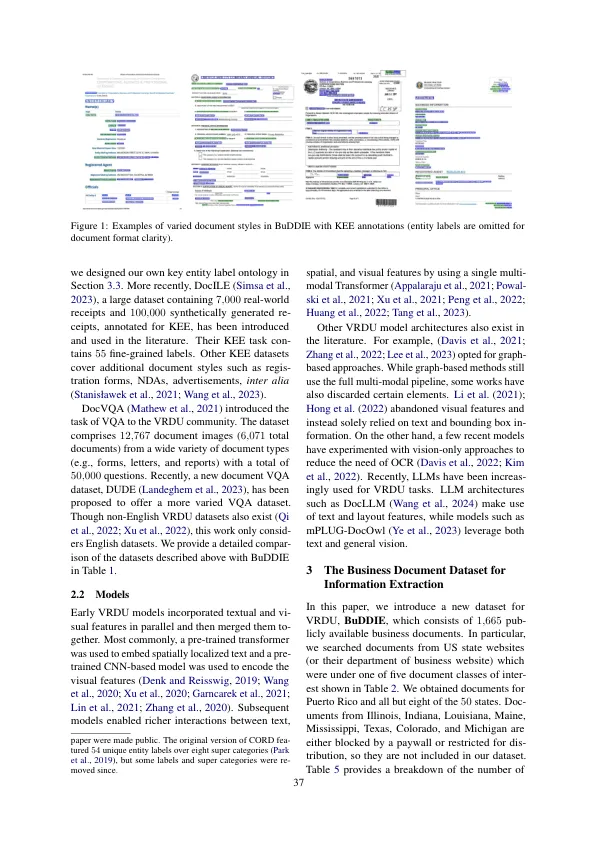

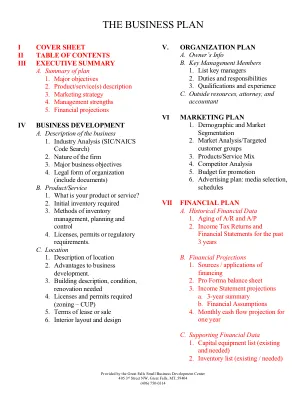

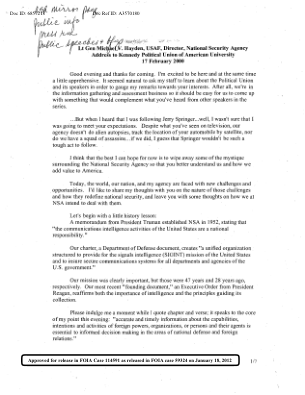

视觉丰富文档理解 (VRDU) 领域旨在解决多模态领域中大量已得到充分研究的 NLP 任务。目前已有多个数据集用于研究 VRDU 的特定任务,例如文档分类 (DC)、关键实体提取 (KEE)、实体链接、视觉问答 (VQA) 等。这些数据集涵盖带有稀疏注释的文档(如发票和收据),因此它们支持一到两个相关任务(例如实体提取和实体链接)。遗憾的是,只关注单一特定类型的文档或任务并不能代表文档在实际中通常需要如何处理 — — 在实际中,文档的风格和要求会多种多样。在本文中,我们介绍了 BuDDIE(用于信息提取的业务文档数据集),1 这是第一个包含 1,665 份真实业务文档的多任务数据集,其中包含丰富而密集的 DC、KEE 和 VQA 注释。我们的数据集由美国州政府网站上的公开业务实体文件组成。这些文件的结构化和样式和布局因州和类型(例如表格、证书、报告等)而异。我们为 BuDDIE 提供了数据多样性和质量指标,以及每个任务的一系列基线。我们的基线涵盖了 VRDU 的传统文本、多模态和大型语言模型方法。

BuDDIE:用于多任务信息提取的商业文档数据集

主要关键词