机构名称:

¥ 1.0

联合学习(FL)的最新进步试图通过在本地任务上对本地数据或个人架构进行细调客户端参数来提高客户层的性能。这种个性化的现有方法是修剪全球模型,要么对本地客户分布进行微调。但是,这些措施的方法要么以保留重要的全球知识为代价,要么预先确定用于微调的网络层,从而导致在客户端模型中次优的全局知识的次优储存。通过彩票票证假设的开明,我们首先引入了一个假设,用于在离开其余参数冻结的同时找到最佳的客户子网络以本地微调。然后,我们使用此过程,通过此过程直接通过同时发现用于个性化的操作参数以及在培训期间的全局聚合参数,提出了一个新颖的FL框架,即FedSelect。我们表明,此方法在CIFAR-10上实现了有希望的结果。

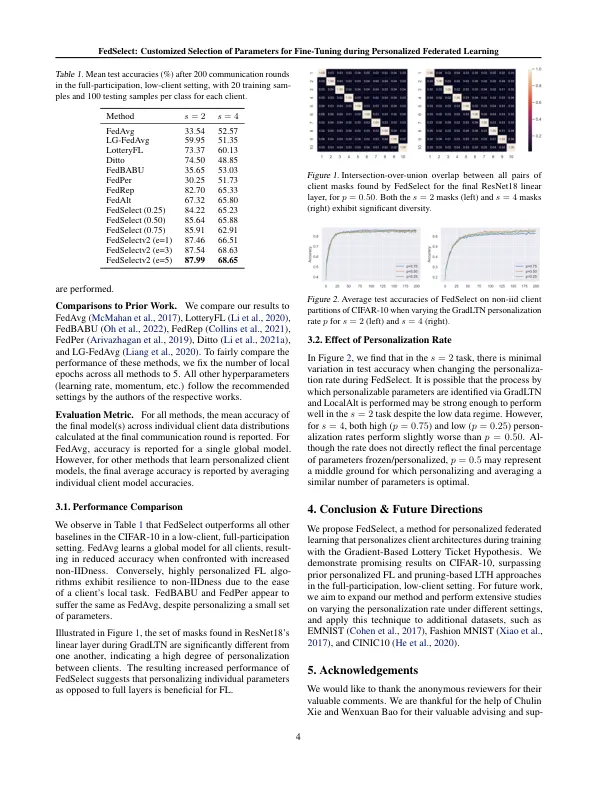

fedSelect:定制的选择参数的选择 - ...