XiaoMi-AI文件搜索系统

World File Search System雪莱家庭医疗中心疫苗政策声明

但这种态度如果广泛传播,只会导致悲剧性后果。1998 年,在一项毫无根据的指控(后来撤回)发表后,许多欧洲人选择不给孩子接种疫苗。由于免疫不足,欧洲爆发了大规模的麻疹疫情,数人死于疾病并发症。2012 年,美国有超过 48,000 例百日咳病例,导致 22 人死亡。大多数受害者是 6 个月以下的婴儿。许多感染这种疾病的儿童的父母都有意识地决定不接种疫苗。2015 年,加利福尼亚州迪斯尼乐园爆发了麻疹疫情(可能是由一名从菲律宾来的受感染的公园游客引发的)。疫情最终蔓延到 147 人,而且许多人年龄太小,无法接种疫苗。

全新 Bing - 我们对负责任的 AI 的态度

新版 Bing 以网页搜索结果为基础。这意味着,我们会将用户查询的响应集中在网页上的高排名内容上,并提供网站链接,以便用户了解更多信息。Bing 通过高度重视相关性、质量和可信度以及新鲜度等特征来对网页搜索内容进行排名。我们在 Bing 的网站站长指南中更详细地描述了这些特征(请参阅“Bing 如何对您的内容进行排名”中的“质量和可信度”)。我们认为有根据的响应是来自新版 Bing 的响应,其中的声明由输入源中包含的信息支持,例如来自查询的网页搜索结果、Bing 的事实核查信息知识库,以及对于聊天体验而言,来自特定聊天的近期对话历史记录。无根据的响应是那些声明没有基于这些输入源的响应。

华盛顿虐待儿童修正案

涉嫌虐待或忽视的记者必须在报告适当之前具有某种心理状态。任何人,无论是要求还是仅被允许举报,都必须“合理的理由相信孩子遭受虐待或忽视儿童。。。..“'本法定规定的目的是通过建立不需要绝对,确定的诊断记者虐待或忽视的标准来鼓励报告。”6然而,由于报告立法的目标是在最早可能的阶段发现可疑的虐待,因此“相信的合理理由” Standard可能会给最初不愿举报的个人带来麻烦的障碍。因此,应将华盛顿的标准降低为“滥用或忽视的合理原因”。由于报告何时存在最小症状,因此对早期探测的好处显然超过了对恶意和毫无根据的报告的恐惧。

Blackfoot 医疗中心疫苗政策声明

但这种态度如果广泛传播,只会导致悲剧性后果。1998 年,在一项毫无根据的指控(后来撤回)发表后,许多欧洲人选择不给孩子接种疫苗。由于免疫不足,欧洲爆发了大规模的麻疹疫情,数人死于疾病并发症。2012 年,美国有超过 48,000 例百日咳病例,导致 22 人死亡。大多数受害者是 6 个月以下的婴儿。许多感染这种疾病的儿童的父母都有意识地决定不接种疫苗。2015 年,加利福尼亚州迪斯尼乐园爆发了麻疹疫情(可能是由一名从菲律宾来的受感染的公园游客引发的)。疫情最终蔓延到 147 人,而且许多人年龄太小,无法接种疫苗。

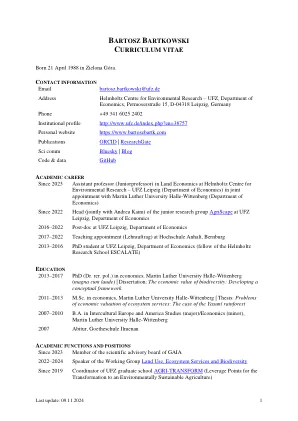

Bartosz Bartkowski Curriculum Vitae

博客:▪在自己的博客上定期贡献▪农业经济期刊的绩效指标,WUR经济学博客,2022年。▪农业经济杂志的绩效指标,农业政策博客,2022年。▪异质景观中的农业环境政策:权衡的艺术,渐进的农业转弯,2021年。▪为什么我们与选择不同的购物方式,农业政策博客,2020年。▪农业经济学和环境与资源经济学期刊排名的综合,Agrarpolitik-Blog,2019年。▪土壤属于谁?土壤生态系统服务的制度经济学观点,ESP-DE,2018年。▪为什么多样化的生态系统在经济上有价值,ESP-DE,2017年。▪生物多样性作为我们知识的表达的价值,环境研究,UFZ,2015年。▪人类中心主义或概念毫无根据的妖魔化,环境研究,UFZ,2014年。▪对自然的经济评估 - 根源全部完成?,环境研究,UFZ,2014年。奖项

最佳实践简报:2024 年:针对城市和县的 12 个预测(全部为 AI 明星)

又到了一年一度的这个时候,我们重新拿起数字水晶球,对未来一年做出预测。今年的预测截然不同,影响深远。和往年一样,我每年都会对全国各城市和县最流行的趋势发表看法。新年伊始,我们对政治不安全感又一次心生恐惧。虽然最近我们对数字鸿沟表示担忧,但现在我们必须面对日益扩大的文化鸿沟以及对政府及其机构日益增长的不信任。这当然导致了毫无根据的阴谋论和对科学技术的不信任惊人地增加。明年也是总统选举年,基于选举的技术受到攻击,这只会加剧文化鸿沟。公共部门的每个人,无论是个人还是职业,都会受到影响。尽管如此,以下是我的预测,我很高兴地报告,有许多领域值得乐观和发展。毫不奇怪,人工智能 (AI) 在每个领域都发挥着主导作用。

持有平台负责

是否应对用户造成的危害承担责任?一个双面平台可以实现公司和用户之间的交互。有两种类型的公司:有害和安全。有害企业对用户施加了更大的成本。如果公司有深层口袋,则平台责任是无根据的。承担责任用户的企业损害企业会阻止有害公司加入平台。如果公司是判断证明,则平台责任在降低社会成本方面起着重要作用。承担平台责任,该平台有动力提高交互价格,以阻止有害企业并投资资源来检测和删除平台中的有害企业。为了防止在检测和删除方面过度投资,分配给平台的残余责任可能是部分而不是全部。最佳平台责任水平取决于对用户参与的影响,平台组合的强度以及用户是非自愿旁观者还是自愿消费者。

基于(生成式)人工智能的文本需求分析

摘要。生成人工智能 (genAI) 创新为最终用户带来了新的潜力,影响到年轻人和缺乏经验的人。然而,作为一项创新技术,genAI 有可能产生无法识别的错误信息。非凡的人工智能输出可以提高可信度。最终用户评估系统对于揭露对错误响应的毫无根据的依赖是必要的。本文确定了评估系统的要求,以防止最终用户高估对生成文本的信任。因此,我们根据文献综述和两项国际调查进行了需求工程。结果证实了在处理 genAI 时实现人类保护、人类支持和内容真实性的要求。高估信任的根源在于校准错误;了解 genAI 及其提供者对于解决这一现象至关重要,并且需要人工验证。因此,我们的研究结果为未来以人为本的 genAI 信任解决方案的信息系统研究的重要性提供了证据。

已发布版本的引用 (APA):Ploug, T., & Holm, S. (2020)。可争议的人工智能诊断的四个维度——以患者为中心的可解释人工智能方法。医学人工智能,107,文章 101901。https://doi.org/10.1016/j.artmed.2020.101901

近年来,人工智能决策的可解释性问题引起了广泛关注。在考虑人工智能诊断时,我们建议将可解释性解释为“有效的可争议性”。从以患者为中心的角度来看,我们认为患者应该能够对人工智能诊断系统的诊断提出异议,而对人工智能诊断中与患者相关的方面进行有效质疑需要获得不同类型的信息,这些信息包括:1)人工智能系统对数据的使用,2)系统的潜在偏见,3)系统性能,以及 4)系统与医疗专业人员之间的分工。我们论证并定义了“可争议性”所要求的十三个具体信息。我们进一步表明,可争议性不仅比一些提出的可解释性标准要求更弱,而且它不会为人工智能和医疗专业人员的诊断引入毫无根据的双重标准,也不会以牺牲人工智能系统性能为代价。最后,我们简要讨论一下这里介绍的可争议性要求是否是特定于领域的。