XiaoMi-AI文件搜索系统

World File Search System引用:Piasecki, S. & Morosoli, S. & Helberger, N. & Naudts, L. (2024)。人工智能生成的新闻:《人工智能法案》中的透明度条款是否满足了新闻读者的期望?互联网政策评论,13 (4)。https://doi.org/10.14763/2024.4.1810

摘要:人工智能生成的内容在人们生活中的出现越来越多,而能够有效浏览和区分此类内容的重要性与透明度有着内在联系,我们的研究重点是透明度,我们通过评估《人工智能法案》第 50 条来研究这一概念。本文呼吁采取行动,在指定《人工智能法案》的透明度要求时考虑最终用户的利益。它侧重于一个特定的用例——媒体组织在生成人工智能的帮助下制作文本。我们认为,目前的形式下,第 50 条留下了许多不确定性,并且有可能在保护自然人免受操纵或赋予他们采取保护行动的权力方面做得太少。本文结合文献和调查数据分析(基于代表荷兰人口的样本),就《人工智能法案》透明度义务的实施提出了具体的政策和监管建议。其主要目的是回答以下问题:如何协调《人工智能法案》适用于人工智能生成的数字新闻文章的透明度规定与新闻读者对操纵和赋权的看法?

法案草案

根据《联邦公务员法》第 26 条第 2 款,该法经 2021 年 6 月 28 日法案第 1 条第 9 号(联邦法律公报 I 第 2250 页)修订,结合《联邦职业条例》第 10 条和第 10a 条第 8 款以及附件 2 第 9、31 和 43 号,其中第 10 条经 2013 年 2 月 20 日条例第 1 条第 2 号(联邦法律公报 I 第 316 页)修订,第 10a 条第 8 款经 2021 年 8 月 18 日条例第 1 条第 7 号(联邦法律公报 I 第 3582 页)修订,附件 2 第 9 号经 2020 年 9 月 15 日条例第 1 条第 4 号(联邦法律公报 I 第 1990 页)修订根据 2023 年 1 月 27 日法令(BGBl.2023 I No.30)第 1 条第 2 款第 d 项第 31 和 43 条的规定,联邦国防部发布以下命令:

发件人:海军记录更正委员会主席 收件人:海军部长 主题:审查海军记录 ICO USMC RET 参考:(a) 第 10 篇,美国法典第 1552 节 (b) DODI 1341.13,2018 年 7 月 12 日 (c) MARADMIN 391/19 (d) MARADMIN 017/20 (e) 第 38 篇,美国法典第 33 章 附件:(1) DD 表格 149 及附件 (2) 主体的海军记录 1. 根据参考 (a) 的规定,主体,以下简称为申请人,向海军记录更正委员会 (委员会) 提交了附件 (1),请求更正其海军记录以确定是否有资格将 9/11 后退伍军人权利法案教育福利转移给合格家属。 2. 委员会由 、 和 组成,于 2022 年 2 月 16 日审查了请愿人的错误和不公正指控,并根据其规定,确定应根据现有的记录证据采取以下纠正措施。委员会审议的文件材料包括附件、请愿人海军记录的相关部分以及适用的法规、条例和政策。 3. 委员会审查了与请愿人的错误和不公正指控有关的所有记录事实,发现在向委员会提出申请之前,他已用尽海军部现行法律和法规规定的所有行政补救措施。委员会得出以下结论:a. 《9/11 后退伍军人教育援助法案》(9/11 后退伍军人权利法案,公法 110-252)于 3 日签署成为法律

来自:海军记录修正委员会主席 致:海军部长 主题:审查海军记录 ICO USMC RET 参考:(a) 标题 10 U.S.C.§ 1552 (b) DODI 1341.13 of 12 Jul 18 (c) MARADMIN 391/19 (d) MARADMIN 017/20 (e) 标题 38 U.S.C.第 33 章 附件: (1) DD 表格 149 及其附件 (2) 主体的海军记录 1.根据参考 (a) 的规定,主体(以下简称为请愿人)向海军记录更正委员会(委员会)提交了附件 (1),要求更正其海军记录,以确定其有资格将 9/11 后退伍军人权利法案教育福利转移给符合条件的家属。2.委员会由 、 和 组成,于 2022 年 2 月 16 日审查了请愿人的错误和不公正指控,并根据其规定,确定应根据现有的记录证据采取以下指示的纠正措施。委员会审议的文件材料包括附件、申诉人海军记录的相关部分以及适用的法规、条例和政策。3.委员会审查了与申诉人的错误和不公正指控有关的所有记录事实,发现在向委员会提出申请之前,他已经用尽了海军部现行法律和法规规定的所有行政补救措施。委员会得出以下结论:a.《9/11 后退伍军人教育援助法案》(《9/11 后退伍军人权利法案》,公法 110-252)于 2008 年 6 月 30 日签署成为法律,并于 2009 年 8 月 1 日生效。该法案为 2001 年 9 月 11 日或之后服役至少 90 天的军人提供教育和住房方面的经济支持。该法案还包括规定符合条件的军人将教育福利转移给符合条件的家属。从 2008 年夏天开始,该法律基本组成部分的一般描述就广泛可用,但具体的实施指南直到 2009 年夏天才发布。

[FPF 幻灯片] 科罗拉多州人工智能法案

○ (i) 高风险人工智能系统在以下情况下继续学习:(a) 提供、出售、出租、许可、赠予或以其他方式提供给部署者;或 (b) 部署;○ (ii) 变更是……本节第 (10)(b)(i) 款所述的任何学习的结果;○ (iii) 当部署者或与部署者签约的第三方完成对此类高风险人工智能系统的初步影响评估时,该变更是由部署者或部署者签约的第三方预先确定的……;以及○ (iv) 该变更包含在高风险人工智能系统的技术文档中。

国家有机标准法案2024提交24

3财政部,澳大利亚政府,“澳大利亚政府成本恢复政策”(网页)https://www.finance.gov.au/government/managing-commonwealth-resources/implementing-charging-charging-charging-framework-frame-frame-frame-rmg--rmg- 302/澳大利亚gercovern-govern-govern-cost-cost-recocle-Recocle-Recolicy。4食品标准澳大利亚澳大利亚新西兰法案(CTH),S146。5 1994年农业和兽医化学法案(CTH),S26; 1994年(CTH)(CTH)农业和兽医化学产品(征税)法。

欧盟人工智能法案支持开源和开放科学

4 数据表记录了收集给定数据集背后的动机,以及任何数据处理和受影响的利益相关者。模型卡包括有关模型架构和开发、其预期和超出范围的用途、评估指标、训练数据和道德考虑的披露。

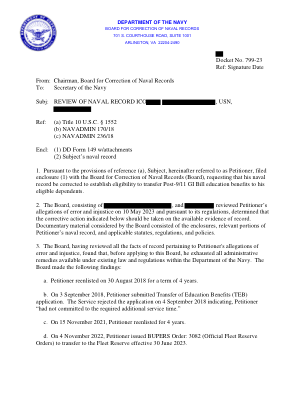

发件人:海军记录修正委员会主席 收件人:海军部长 主题:审查海军记录 ICO,美国海军,参考:(a) 标题 10 U.S.C.§ 1552 (b) NAVADMIN 170/18 (c) NAVADMIN 236/18 附件:(1) DD 表格 149 及附件 (2) 当事人的海军记录 1. 根据参考 (a) 的规定,当事人(以下简称为申请人)向海军记录修正委员会(委员会)提交了附件 (1),请求修正其海军记录以确定其有资格将 9/11 后退伍军人权利法案教育福利转移给其合格家属。 2. 委员会由 组成,于 2023 年 5 月 10 日审查了申诉人的错误和不公正指控,并根据其规定,决定根据现有的记录证据采取以下纠正措施。委员会审议的文件材料包括附件、申诉人海军记录的相关部分以及适用的法规、条例和政策。 3. 委员会审查了与申诉人的错误和不公正指控有关的所有记录事实,发现在向委员会提出申请之前,他已用尽海军部现行法律和法规规定的所有行政补救措施。委员会得出以下结论:a. 申诉人于 2018 年 8 月 30 日重新入伍,任期为 4 年。b. 2018 年 9 月 3 日,申诉人提交了教育福利转移 (TEB) 申请。该部门拒绝了

来自:海军记录更正委员会主席 致:海军部长 主题:审查海军记录 ICO,美国海军,参考:(a) 美国法典第 10 章§ 1552 (b) NAVADMIN 170/18 (c) NAVADMIN 236/18 附件:(1) DD 表格 149 及其附件 (2) 主题的海军记录 1。根据参考 (a) 的规定,主题,以下简称为请愿人,向海军记录更正委员会 (Board) 提交了附件 (1),请求更正其海军记录,以确定其有资格将 9/11 后退伍军人权利法案教育福利转移给其符合条件的家属。2.由 组成的委员会于 2023 年 5 月 10 日审查了请愿人的错误和不公正指控,并根据其规定,确定应根据现有的记录证据采取以下指示的纠正措施。委员会审议的文件材料包括附件、请愿人海军记录的相关部分以及适用的法规、条例和政策。3.委员会审查了与请愿人的错误和不公正指控有关的所有记录事实,发现在向委员会提出申请之前,他已用尽海军部现行法律和法规规定的所有行政补救措施。委员会得出以下结论: a. 请愿人于 2018 年 8 月 30 日重新入伍,任期为 4 年。b.2018 年 9 月 3 日,请愿人提交了教育福利转移 (TEB) 申请。服务部门于 2018 年 9 月 4 日拒绝了该申请,表示请愿人“未承诺所需的额外服务时间”。 c. 2021 年 11 月 15 日,请愿人重新入伍 4 年。d. 2022 年 11 月 4 日,请愿人发布了 BUPERS 命令:3082(官方舰队预备役命令),从 2023 年 6 月 30 日起转移到舰队预备役。

![[FPF 幻灯片] 科罗拉多州人工智能法案](/simg/e/ecff67a48a2b57f2eac469271169c6ca61be6ca6.png)