XiaoMi-AI文件搜索系统

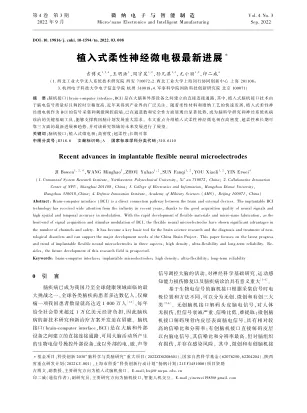

World File Search System植入式柔性神经微电极最新进展

∗ 基金项目 : 科技创新 2030“ 脑科学与类脑研究 ” 重大项目 (2022ZD0208601), 国家自然科学基金 (62076250,62204204), 陕西

什么是一代AI(人工智能)? 适当使用生成式人工智能! ≪初中生...

最近,我经常听到 AI(人工智能)、ChatGPT 和生成式 AI 等词。在这个系列中,我们将考虑人工智能技术已经渗透到我们日常生活中所带来的改变的“现在”和“未来”。这次的主题是“生成式AI”,我们请AI为初中生写一篇文章(修改为更容易阅读)。

什么是AI(人工智能)?明智地使用生成式人工智能! <<初中生……

最近,我们一直在听到AI(人工智能)、ChatGPT和生成式AI这些术语。在本系列中,我们将探讨已渗透到我们日常生活的人工智能技术将如何改变现在和未来。这次的主题是“生成式人工智能”,我们让人工智能撰写了一篇针对初中生的文章(我们对其进行了编辑,使其更容易阅读)。

生成式人工智能

ChatGPT 的趋势很难被忽视,因为该工具自 2022 年底以来就一直是媒体的头条新闻。除了众多相关用例之外,OpenAI 的解决方案的可访问性和自然语言质量也使其脱颖而出。虽然生成式人工智能并不新鲜——当然也不是人工智能——但到目前为止,它只是特定专家和研究实验室的领域。ChatGPT 的真正革命性不在于技术本身,而在于它针对广泛受众的能力。与社交网络和其他数字应用一样,生成式人工智能已迅速进入企业领域。63% 的法国公司正在考虑将生成式人工智能引入他们的工作方法中。1 原因是,虽然只有 13% 的员工每天使用生成式人工智能,但几乎一半 (45%) 的员工每周使用它几次。然而,很少有人确切知道生成式人工智能是什么或它是如何工作的。虽然 71% 的法国人听说过它,但只有 36% 的人了解它。因此,大多数用户不一定意识到生成式人工智能的风险,尤其是 ChatGPT。这种缺乏意识可能会给公司带来严重后果:68% 的员工在工作中使用 ChatGPT 时没有告知雇主。2