XiaoMi-AI文件搜索系统

World File Search System人工智能艺术中的艺术自主性

引言 对创造力和意图的伦理关怀 自动化在社会中的传统作用是通过外包日常任务来让人类生活更轻松,并且按照传统,它取代人类的工作以降低成本、增加利润。例如,推荐系统利用语言模型来吸引用户参与预测文本系统。然而,由于它改变了人们的写作方式,这种媒介受到了许多批评。研究发现,这些系统让人变得“像机器一样”——从其意图就可以看出这一点(Varshney 2020b)。这促使人们在实施自动化时要伦理关怀人类的属性——其中之一就是创造力。事实上,早在 1964 年,技术学者刘易斯·芒福德 (Lewis Mumford) 就引用了歌德的《魔法师的学徒》来论述:“首先,让我质疑这样一种观点,即自动化在任何意义上都是最终的利益,它在各个方面都如此有益,因此必须加快这一进程并坚持不懈地扩展到每个领域……”如果人类有机体仅按照这一原则发展,……人类将失去思维能力”(Mumford 1964)。在精神分析中,创造力是驱动艺术体验的表达要素或自然人类冲动(Zweig 2012)。它让观众感到惊讶,因为它突破了被认为是现实体验的界限。令人惊讶的是,它推动了创造力的产生,这一点可以通过好奇机器人的人工智能创造系统将其用作创造性行动的内在动机来检验(Saunders et al. 2010)。人工智能艺术,

Darktrace 网络人工智能分析师:自主调查

通过结合使用监督式和无监督式机器学习以及深度学习方法和高级数学,Cyber AI Analyst 可以完成大量原本需要人类完成的繁重工作。它利用 Darktrace 世界级专家多年来在威胁调查中收集的见解来做出高度准确的决策,并首次向公众提供这些丰富的知识。

迈向自主增长 - WW 罗斯托

作者:F Bator · 1956 · 被引用 1455 次 — 在真正自我强化的增长过程开始之前,经济中可能出现的实质性经济进步。英国经济扩张。

2024 ROBOTX的自主海洋系统...

I。多亏了不断增长的支持,阿莫尔(Amore)从入门级团队发展到了一支竞争激烈的球队,在比赛期间始终进入决赛,在Roboboat 2024和Virtual Robotx 2023中排名前五。Amore的工作涵盖了四个工程高级设计项目,研究课程,与其他机器人机构的国际合作,以及在北美大湖地区的机器人技术和生物学上发表的学术研究[1],[2]。

欧盟在经济领域通过什么方式和方法真正实现战略自主?

我们的分析采用了欧盟委员会提出的敏感生态系统概念,并重点关注了一系列战略行业,强调了欧盟内部值得密切关注的进口依赖性。在各种产品类别中,有一类产品特别值得关注:“计算机、电子产品和光学产品制造”。这一类产品定义了“数字”生态系统,并在“电子”和“航空航天和国防”生态系统中发挥着重要作用。它包括计算机芯片和半导体等关键组件,并且对非欧盟国家的进口依赖程度相当高。重要的是,其中一些产品的进口高度集中在“无自由”状态的国家,从而给这些依赖性带来了相对较高的风险。此外,对于这一类别中的某些产品,用欧盟生产的产品进行替代要么是不可能的,要么会带来重大挑战。

Xprize Wildfire自主响应轨道合格的团队...

The Crossfire solution is based on customized available technologies and features multiple drones (large, long-endurance UAVs as well as small, multicopter UAVs), standard communication and navigation technologies, dual fire detection technologies (thermal and optical cameras), enhanced water-based fire suppression (water containers featuring an innovative rupture and dispersion mechanism), all integrated into a System of Systems using optimization方法,AI和机器学习算法。

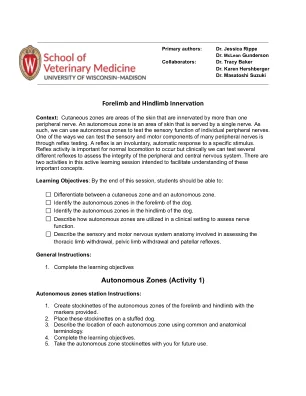

前肢和后肢神经支配 - 自主区和反射(更新2024)

前肢和后肢的反射途径利用了周围神经源自的脊髓的部分。测试肢体反射涉及诱导通过感觉神经元传输到CNS的感觉刺激。正如我们之前讨论的那样,这种感觉神经元的细胞体位于背根神经节中。感觉信号将从受体传播,通过周围神经检测刺激,到脊神经,再到背根,然后终止于背角灰质中的间神经元。那里 - 魔术发生了!通过将稍后在课程中进行研究的连接,这种感觉输入将导致脊髓同一区域中腹角灰质物质中的α运动神经元激活。电动机输出将穿过腹侧根部,到达脊神经,到达周围神经,最后到达目标肌肉以引起“反射性”收缩。在临床上,这被认为是肢体的预期运动,可能涉及一个或多个肌肉群和关节。

数字、自主和人工智能......

● 专注于使用高有效载荷无人机 - ULTRA 进行空运货物 ● 超视距操作 (BVLOS) ● ULTRA 无人机平台第三次迭代 - 内部开发高可靠性航空电子系统 ● 在英国拥有丰富的运营经验,并与民航局建立了安全案例 ● 获得美国联邦航空局豁免,可以在贾斯珀县以外运营 ● 在印度和英国建立制造合资企业 ● 与英国国防部签订飞机和培训合同 ● 目前在乌克兰用于供应交付 ● 用于南极气象研究 ● 开始与世界粮食计划署在南部非洲合作提供援助