机构名称:

¥ 2.0

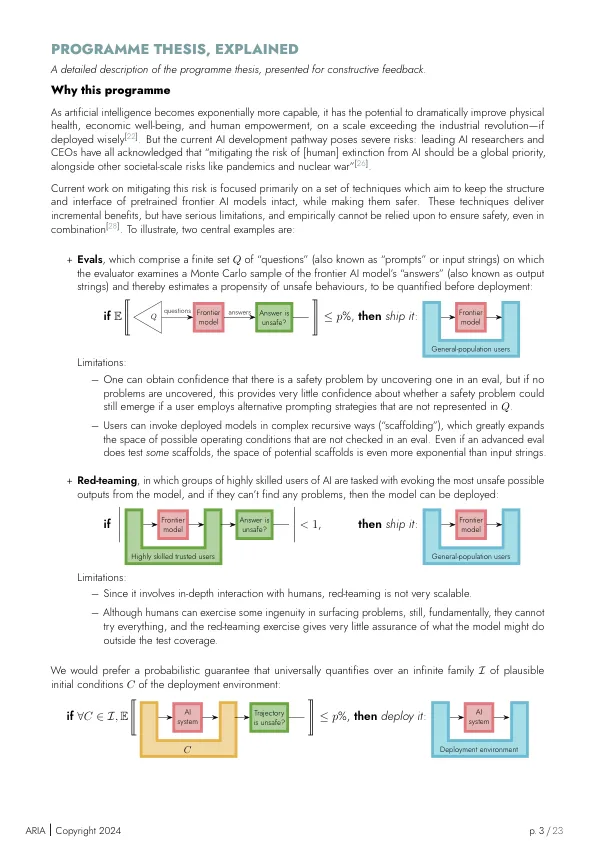

为了做出这样的证明,必须首先定义与人工智能系统相关的规范(理想情况下,将集体审议过程的意见与相关利益相关者的意见结合起来,确定适当的风险阈值和定义)。为了为作为现实世界网络物理系统一部分运行的人工智能系统定义安全规范,必须定义系统部署的环境和上下文的动态数学模型。然后,规范可以对环境中发生的事情提出要求(例如某种正式定义的“伤害”不会以高概率发生),而不是仅指人工智能系统本身的输入和输出之间的关系的正式规范(这足以定义一些非平凡的属性,如“对抗性鲁棒性”,但不能定义任何物理类型的安全性)。为了被视为部署环境中可能发生的情况的“基本事实”,作为系统认证的信任根源,这些数学模型必须经过人类团队的审核,因此表达这些数学模型的建模语言必须既是人类可理解的,又符合形式化方法。

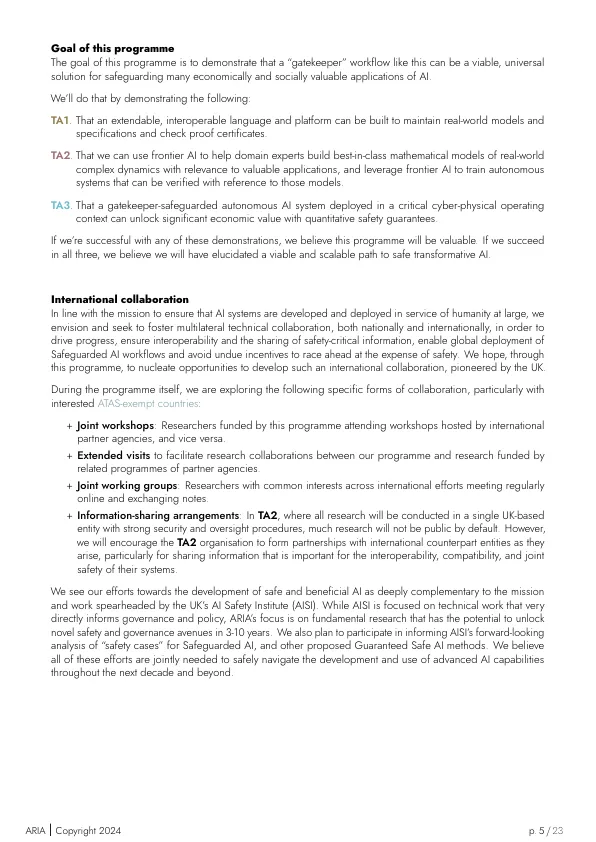

受保护的人工智能:构建有保障的安全

主要关键词