机构名称:

¥ 1.0

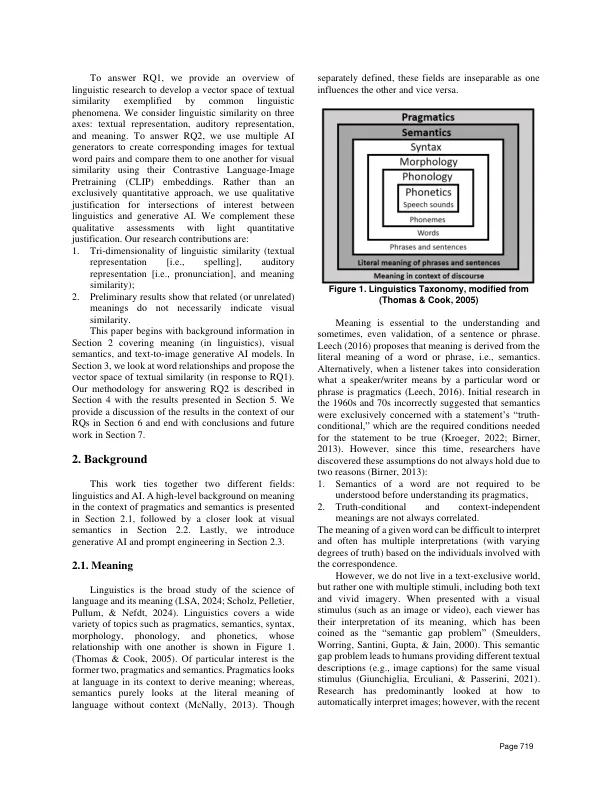

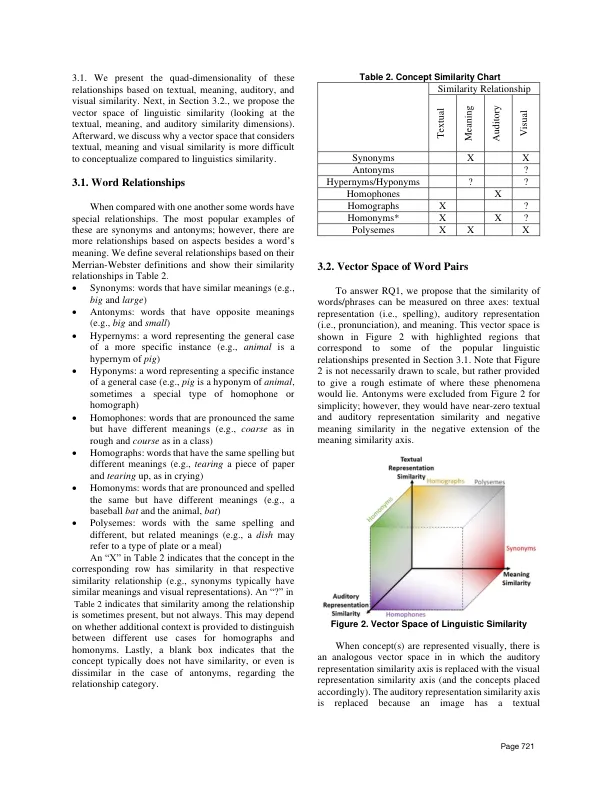

摘要 许多视觉生成人工智能 (AI) 模型使用文本“提示”作为输入来指导生成图像的开发。将文本转换为图像利用了语用学和语义学,这会对输出产生影响。为了促进更精确的提示,我们提出了文本相似性的三维向量空间,它使用文本表示、听觉表示和含义相似性作为轴。接下来,我们表明两个单词之间含义相似并不一定会导致相应的 AI 生成的这些单词图像之间视觉相似。我们利用八个图像生成器为抽象和具体的同义词、反义词和上义词-下义词对生成图像,并将它们的图像-图像 CLIPScore 与它们对应的文本-文本 CLIPScore 进行比较,从而定量地证明了这一点。在所有模型和关系类型中,文本与文本和图像与图像相似度的平均相似度同义词从 92.8% 下降到 70.1%,反义词从 89% 下降到 58.9%,上义词-下义词对的平均相似度从 85.6% 下降到 68.1%。

语言概念的视觉类比及其含义