机构名称:

¥ 1.0

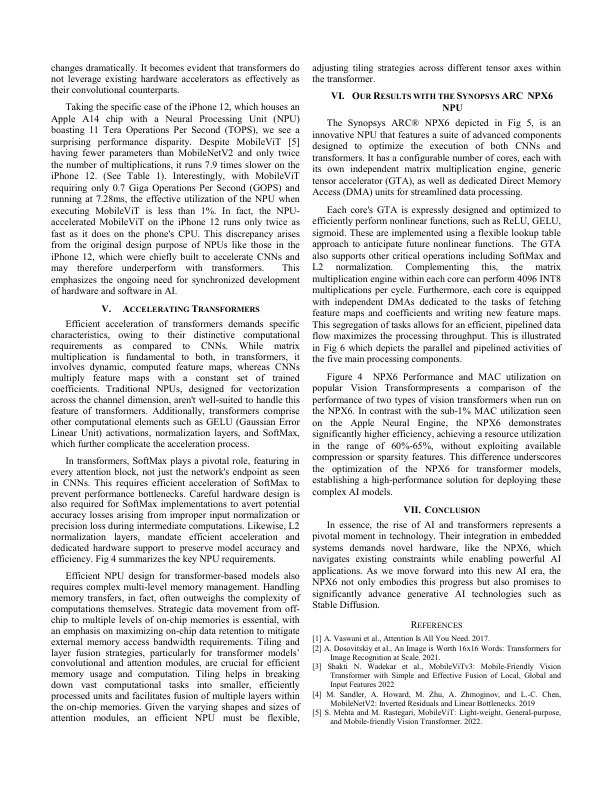

iii。transformers的大小诸如GPT之类的大语言模型的有效性是以大型模型大小为代价,而GPT-3则使用惊人的1750亿个参数。同样,在视力任务中提出了最新的VIT也是这样做的,以大小显着增加的成本,以参数数量来衡量。例如,超过CNN实现的先前最先进结果的变压器模型VIT-G/14的发展效果超过了参数的数量(见图2)。在表面上,可以假设这些变压器模型的巨大规模使它们在嵌入式应用程序中不切实际,通常以严格的功率和面积资源约束来表征。然而,最新的研究挑战了这一假设。