机构名称:

¥ 1.0

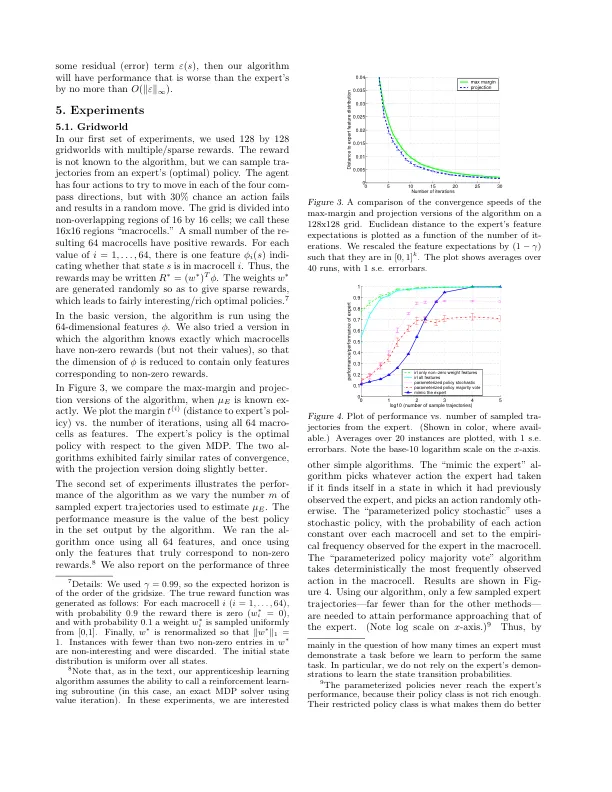

我们考虑在马尔可夫决策过程中学习,在马尔可夫决策过程中,我们没有明确地赋予重新功能,但是我们可以在这里遵守专家,以展示我们想学习的任务。此设置在应用程序(例如驾驶任务)中很有用,很难写下明确的奖励功能,以准确地指定应如何交易不同的desiderata。我们认为专家试图最大程度地发挥奖励功能,该奖励功能可作为已知功能的线性组合,并给出了一种学习专家所展示的任务的算法。我们的al-gorithm基于使用“逆增强学习”来试图恢复未知的奖励功能。我们表明,我们的算法终止了少数迭代,即使我们可能永远无法恢复专家的奖励功能,算法的策略也将达到与专家接近的绩效,在此,在此,相对于Expt exptt的未知奖励函数,在这里可以衡量。

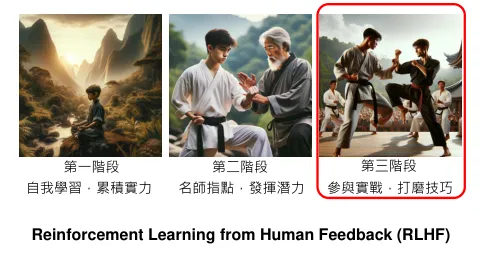

通过反强化学习的学徒学习