机构名称:

¥ 1.0

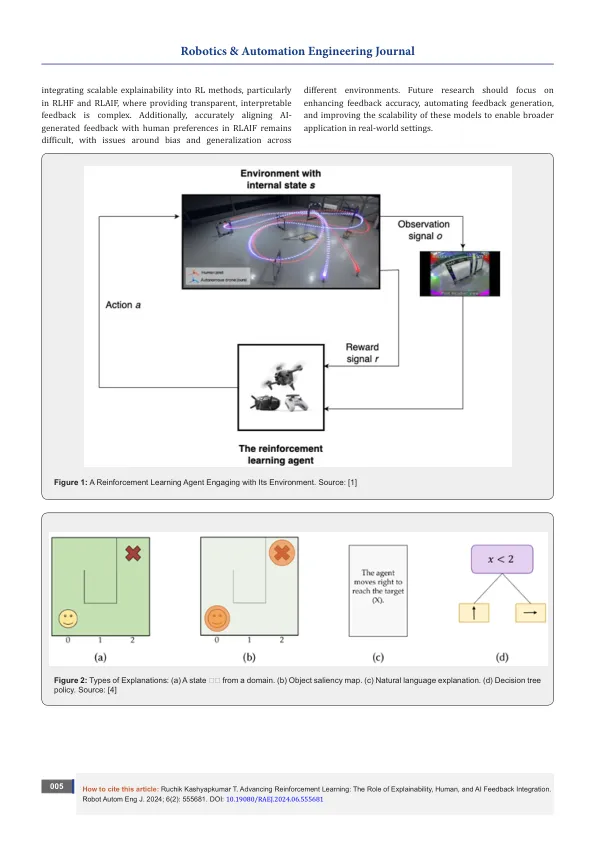

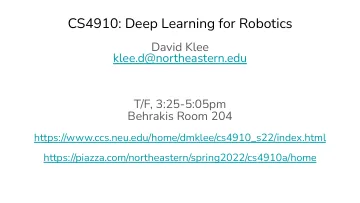

本文通过人类和AI的反馈对进步的增强学习(RL)进行了全面审查,重点是可解释的强化学习(XRL)的新兴子领域。它研究了解释性技术如何在顺序决策设置中提高RL代理决策过程的透明度,从而使从业者能够更好地理解和信任代理人的行为。该评论还探讨了从人类反馈(RLHF)学习增强性挑战的挑战,并从AI反馈(RLAIF)中引入了强化学习,这是一个有希望的选择。通过利用现成的大语言模型(LLMS)生成偏好标签,RLAIF解决了手动人类反馈的时间耗时和昂贵的性质,同时取得了可比或优越的结果。该论文进一步讨论了RLHF和RLAIF的开放问题和基本局限性,强调了对改善其实际实施的强大方法的需求。结束时,概述了旨在完善和补充RLHF和RLAIF的未来研究指示,以增强其在现实世界应用中的有效性和社会影响。

推进强化学习