机构名称:

¥ 1.0

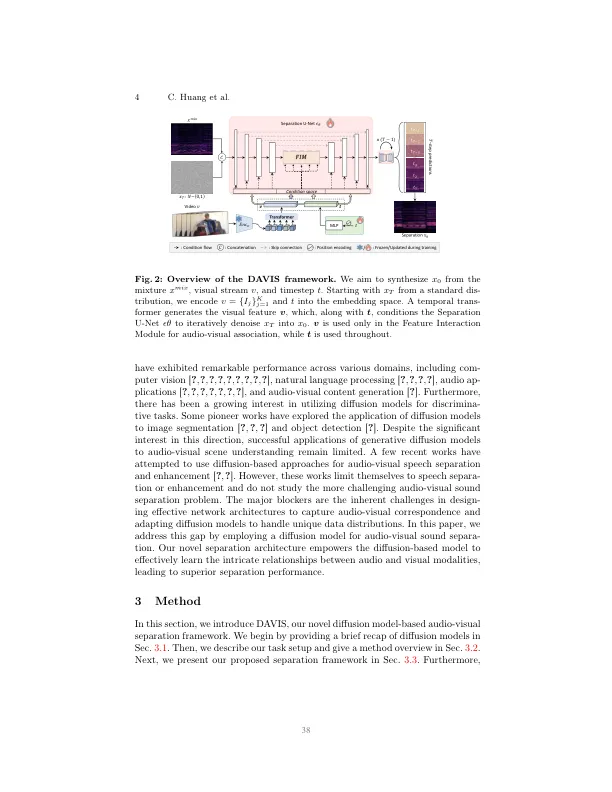

摘要。我们提出了戴维斯(Davis),这是一个基于i fifusion的udiovi sual separa the the trapion框架,该框架通过生成学习解决了视听声音源分离任务。现有方法通常将声音隔离作为基于面具的回归问题,从而取得了重大进展。但是,他们在捕获高质量分离声音与各种表情所需的复杂数据分布时面临局限性。相比之下,戴维斯利用生成扩散模型和分离U-net直接从高斯噪声中综合了分离的声音,并在音频混合物和视觉信息上进行条件。具有其生成性目标,戴维斯更适合实现各种声音猫的高质量分离的目标。我们将戴维斯与AVE和音乐数据集上现有的最新歧视性音频分离方法进行了比较,结果表明,戴维斯在分离质量方面胜过其他方法,这证明了我们可以解决视听源分离任务的框架的优势。我们的项目页面可在此处提供:https://wikichao.github.io/data/projects/davis/。

高质量的视觉引导的声音与不同类别的分离