机构名称:

¥ 3.0

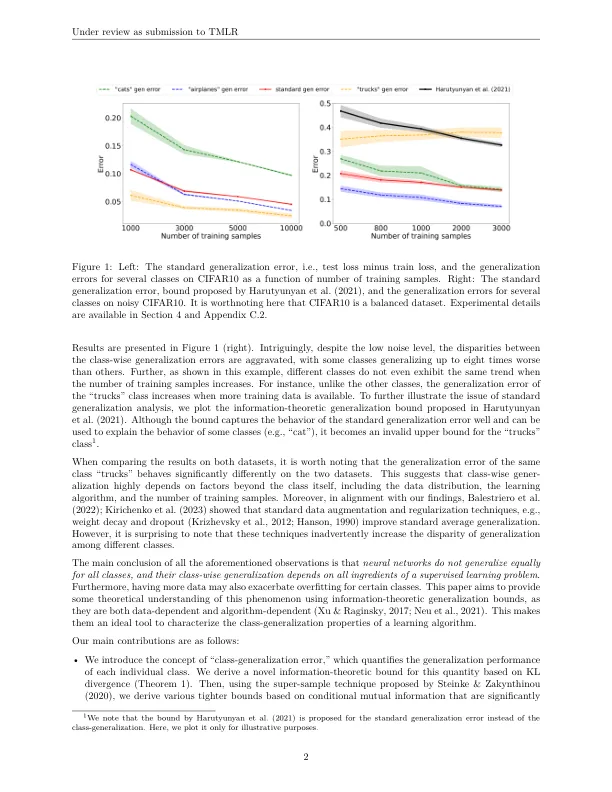

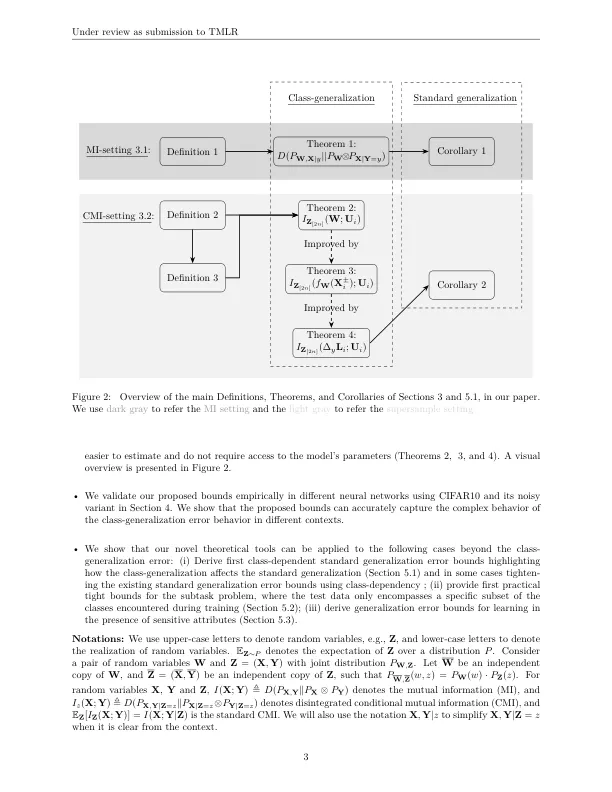

现有的监督学习的概括理论通常采用整体方法,并为整个数据分布的预期概括提供了界限,该方法隐含地假设该模型对所有不同类别的概括都相似。但是,在实践中,不同类别之间的概括性能存在显着差异,而现有的泛化范围无法捕获。在这项工作中,我们通过从理论上研究班级化误差来解决这个问题,从而量化了每个单独类别的模型的概括性能。我们使用KL Divergence得出了一种新的信息理论,用于类临时误差,并使用有条件相互构成的有条件相互结合的最新进展进一步获得了几个更紧密的界限,从而实现了实际评估。我们从经验上验证了各种神经网络中提出的界限,并表明它们准确地捕获了复杂的类概括行为。此外,我们证明了这项工作中开发的理论工具可以应用于其他几种应用程序。

班级概括错误:信息理论分析