机构名称:

¥ 1.0

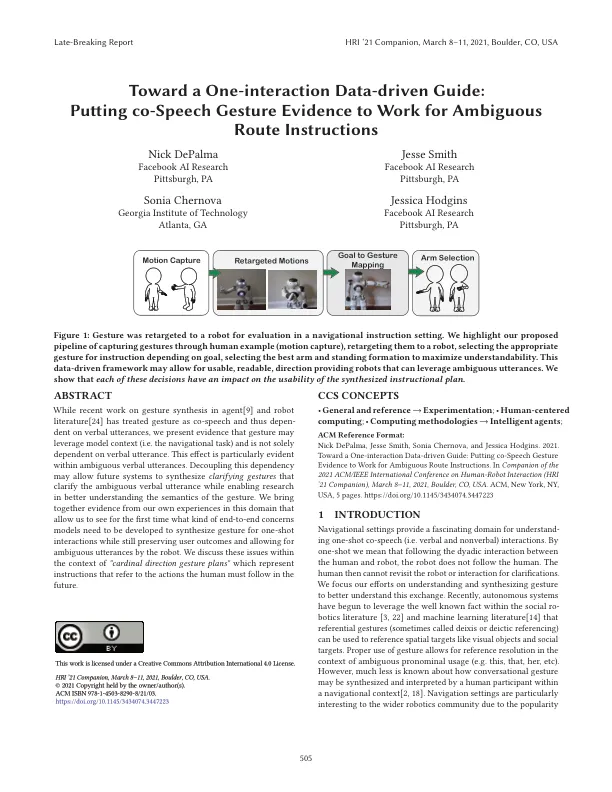

虽然最近在代理[9]和机器人文献[24]中进行手势合成的工作已将手势视为共同语音,因此依赖于口头话语,我们提供了表明手势可以利用模型上下文的证据(即导航任务),不仅取决于口头话语。这种效果在含糊不清的口头话语中尤为明显。将这种依赖性解耦可能会使未来的系统能够综合澄清手势,这些手势阐明了模棱两可的口头话语,同时使研究能够更好地理解手势的语义。我们从这个领域中的经验中汇集了证据,使我们能够首次看到需要开发哪种端到端的关注模型,以合成一声互动的手势,同时仍然可以保留用户的结果并允许机器人模棱两可。我们在“基本方向手势计划”的背景下讨论这些问题,该指示指的是人类将来必须遵循的行动。

迈向一项一次性数据驱动指南