XiaoMi-AI文件搜索系统

World File Search System基于视觉的先进精密进近和着陆...

先进空中机动 (AAM) 飞机需要感知系统,以便在城市、郊区、农村和区域环境中实现精确进近和着陆系统 (PALS)。目前批准用于自动进近和着陆的最先进的方法将难以用于支持 AAM 操作概念。但是,来自其他应用和低 TRL 研究的技术和系统使用视觉、红外、雷达和 GPS 方法为 AAM 飞机进近和着陆提供基线感知和传感要求。本文重点介绍基于视觉的 PAL,以演示闭环基线控制器,同时遵守联邦航空管理局的要求和规定。共面算法确定姿势估计,并将其输入到扩展卡尔曼滤波器中。将 IMU 与视觉相结合,为 GPS 拒绝的环境创建传感器融合导航解决方案。状态估计会导致下滑道和定位器误差计算,这对于设计和推导 AAM PALS 的制导律和控制律至关重要。 IMU 和视觉导航解决方案为 AAM PALS 提供了有希望的模拟结果,更高保真度的模拟将包括计算机图形渲染和特征对应。

用于计算机视觉的硬件和软件平台.pptx

c(,-1#$“ nq $ b $?; 4b- $ m $“ NQ $ 01 $ 4 $ L41, - 。 “ dk $ b $ b”*:0,$ 4) - $ .- 26 -.02> $ b $ b” EDKC $ E: - 。 “ NQC $ e2,0ce:04102> $ b $ <1- $($ i(,3 $ = 9 3- $ 0)4> - $ W+4:0,JM $ div>

基于深度学习和计算机视觉的河流洪水检测系统

摘要尽管OOD每年造成数百万美元的经济和社会损失,但居住在发展中国家(例如巴西)的许多人由于其成本而无法访问Ood Alert System。为了解决这个问题,我们提出了一个廉价且强大的河流洪水检测系统,可以将其放在任何河流中,并在其床边处有一个地面。我们系统的新颖性是使用o的原始图像,无需预处理。因此,我们的方法可以使用城市环境中现有的监视摄像机进行部署。建议的系统通过使用深神经网络(DNNS)对河水刀片进行语义分割来测量河流水平。然后,它使用计算机视觉(CV)来估计水位。如果水位接近或高于危险阈值,则它会在没有人类干预的情况下自动发送警报。此外,我们的系统可以以3.32 cm的平均绝对误差(MAE)的平均绝对误差(MAE)成功测量河流的水位,这足以检测到何时何时过度OW。该系统也可靠地从不同的相机观点和照明条件来测量河流水位。我们展示了我们的方法的生存能力,并评估了原型的

使提示适应性:视觉的贝叶斯建模 - ...

最近预估计的视觉语言(VLP)模型已成为许多下游任务的骨干,但它们被用作冷冻模型而无需学习。提示学习是一种通过在文本编码器的输入中添加可学习的上下文向量来改善预训练的VLP模型的方法。在下游任务的几次学习方案中,MLE训练可以导致上下文向量在训练数据中拟合占主导地位的图像特征。这种过度适应的可能会损害概括能力,尤其是在训练和测试数据集之间的分布变化的情况下。本文介绍了基于贝叶斯的迅速学习的框架,这可以减轻几乎没有射击的学习应用程序中的过度问题,并提高提示在看不见的情况下的适应性。具体来说,建模与数据相关的先验增强了文本特征的适应性,可用于可见的和看不见的图像特征,并在其之间取决于它们之间的折衷。基于贝叶斯框架,我们在估计目标后分布中利用了Wasserstein等级流,这使我们的提示可以灵活地捕获图像特征的复杂模式。我们通过与现有方法相比显示出统计学上显着的性能改善,证明了在基准数据集上的方法的有效性。该代码可在https://github.com/youngjae-cho/app上找到。

gri:一般增强模仿及其在基于视觉的自动驾驶中的应用

摘要:深入强化学习(DRL)已被证明对几种复杂的决策应用有效,例如自主驾驶和机器人技术。但是,众所周知,DRL受到其高样本复杂性和缺乏稳定性的限制。先验知识,例如,作为专家演示,通常可以使用,但要挑战以减轻这些问题。在本文中,我们提出了一般增强模仿(GRI),这是一种新颖的方法,结合了探索和专家数据的好处,并且可以直接实施任何非政策RL算法。我们做出了一个简化的假设:可以将专家演示视为完美的数据,其基础政策将获得不断的高奖励。基于此假设,GRI介绍了示范剂的概念。该代理发送专家数据,这些数据是与在线RL勘探代理所带来的经验同时且无法区分的。我们表明,我们的方法可以对城市环境中基于摄像机的自动驾驶进行重大改进。我们在使用不同的非政策RL算法的穆约科克连续控制任务上进一步验证了GRI方法。我们的方法在Carla排行榜上排名第一个,在先前的最新方法中,在Rails上胜过17%。

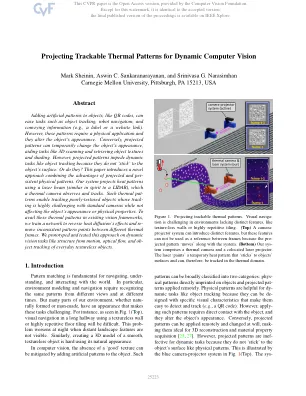

投影动态计算机视觉的可跟踪热图案

将人造模式添加到QR码之类的对象中可以简化诸如对象跟踪,机器人导航和传达信息(例如标签或网站链接)之类的任务。但是,这些模式需要物理应用,它们会改变对象的外观。相反,投影模式可以暂时更改对象的外观,协助3D扫描和检索对象纹理和阴影等任务。但是,投影模式会阻碍动态任务,例如对象跟踪,因为它们不会“粘在对象的表面上”。还是他们?本文介绍了一种新颖的方法,结合了预测和持久的物理模式的优势。我们的系统使用激光束(精神类似于激光雷达)进行热模式,热摄像机观察和轨道。这种热功能可以追踪纹理不佳的物体,其跟踪对标准摄像机的跟踪极具挑战性,同时不影响对象的外观或物理特性。为了在现有视觉框架中使用这些热模式,我们训练网络以逆转热扩散的效果,并在不同的热框架之间移动不一致的模式点。我们在动态视觉任务上进行了原型并测试了这种方法,例如运动,光流和观察无纹理的无纹理对象的结构。

基于视觉的3D移动目标的非线性动力学发现

数据驱动的理事方程发现在许多科学和工程领域都引起了重大利益。现有的研究主要集中于基于系统状态的直接测量(例如轨迹)的直接测量来揭示非线性dynamics的方程。有限的努力是针对从视频中蒸馏出的,即在3D空间中移动目标的视频。为此,我们提出了一种基于视觉的方法,可以通过一组摄像机记录的原始视频自动发现3D移动目标的非线性动力学方程。该方法由三个关键块组成:(1)一个目标跟踪模块,该模块在每个视频中提取移动目标的平面像素运动动作,(2)Rodrigues的基于旋转公式的坐标转换模块,该模块重建了3D坐标,该模块与预测的参考点和(3)基于图书馆的范围相关的3D坐标,该模块是spress-Encress-Encress-nuff the Spress-Encress of gress of gress of gress of gress of gress of sprys of gress of sprys of gress nuff spression of gress of gress of。动力学。此框架能够有效地处理与介绍数据相关的挑战,例如,视频中的噪声,不精确的跟踪导致数据缺失的目标等。通过多组综合视频考虑了不同的非线性动力学,我们的方法的功效已经证明了。

机器和人类视觉的图像压缩具有空间频率适应

摘要。机器和人类视力(ICMH)的图像压缩近年来引起了人们的关注。现有的ICMH方法受到高训练和存储开销的限制,这是由于特定于任务的网络设计的大量设计。为了解决此问题,在本文中,我们为ICMH(名为Adapt-ICMH)开发了一种新颖的基于轻量级适配器的调整框架,可以更好地平衡任务性能和比特率与减少的开销。We propose a spatial-frequency modulation adapter (SFMA) that simultaneously eliminates non-semantic redundancy with a spatial modulation adapter, and enhances task-relevant frequency com- ponents and suppresses task-irrelevant frequency components with a fre- quency modulation adapter.所提出的适配器是插件播放的,并且与几乎所有现有的学到的图像压缩模型兼容,而不会损害预训练模型的性能。实验表明,适应性ICMH始终在各种机器视觉任务上的现有ICMH框架较少,并且较少的微调参数和降低的计算复杂性。代码将在https://github.com/qingshi9974/eccv2024-adpaticmh上发布。

使用计算机视觉的结直肠息肉的自动化尺寸

消息结直肠息肉大小是影响管理决策的重要生物标志物,但目前使用的主观方法有缺陷。我们探索了两种计算机视觉(CV)技术,用于将息肉大小为≤5mm或> 5 mm的二进制分类。首先,我们使用了固定在猪结肠模型上的预先幻象息肉(22个这样的息肉的视频)来探索使用Motion(SFM)方法结构(SFM)方法的自动化尺寸的概念,并将其与10个独立的内窥镜医生进行比较:SFM System(85.2%)的总体,平均诊断精度(85.2%)是Onsos-eneros-Ondos-Copist-Copists-59.5%。第二,我们开发了一个基于卷积神经网络(CNN)的深度学习模型,并在10个人类息肉视频中发现了80%的精度。与人工智力(AI)相结合时,实时自动化息肉尺寸可以改善息肉管理策略。

基于视觉的自主降落和抗己型无人机的充电系统

基于无人机的系统的挑战之一是车载电池的容量有限。为了克服机载电池容量的限制,本文介绍了一种智能的决策系统,用于自动着陆和充电过程。该系统旨在充电排干电池并延长飞行持续时间。基于红外发光二极管(LED)检测和标记识别。在这项研究中精心设计和使用了一个具有二十个红外LED和八个条形码的新型着陆垫。着陆过程分为两个阶段。在第一阶段,由配备红外通滤波器的摄像机观察到LED,而在第二阶段中,两个像素摄像机观察到条形码。将无人机降落在适当的极性上,然后开始充电过程,这是一种基于OTSU阈值方法的基于层次视觉的自主着陆算法(HVALA)和高斯(LOOD)操作员的Laplacian。整个系统是通过一系列自动驾驶飞行设计和测试的。在着陆过程的最后阶段获得的实验结果证实了系统的可行性和鲁棒性,在该系统平均观察到4.4厘米的较小误差为4.4厘米,最大着陆时间为10秒。在本应用程序中可以接受此类错误,并导致较高的着陆成功率。