XiaoMi-AI文件搜索系统

World File Search Systeminpainting

一种用于推进机器学习模型的混合脉冲卷积神经网络方法

在本文中,我们提出了一种新颖的独立混合脉冲卷积神经网络 (SC-NN) 模型,并在图像修复任务上进行了测试。我们的方法利用 SNN 的独特功能(例如基于事件的计算和时间处理)以及 CNN 强大的表示学习能力来生成高质量的修复图像。该模型在专为图像修复设计的自定义数据集上进行训练,其中使用蒙版创建缺失区域。混合模型由 SNNConv2d 层和传统 CNN 层组成。SNNConv2d 层实现泄漏积分和发射 (LIF) 神经元模型,捕捉脉冲行为,而 CNN 层捕捉空间特征。在本研究中,均方误差 (MSE) 损失函数演示了训练过程,其中训练损失值为 0.015,表示在训练集上的表现准确,并且模型实现了低至 0 的验证损失值。 0017 的测试结果。此外,大量的实验结果证明了其最先进的性能,展示了在单个网络中集成时间动态和特征提取进行图像修复的潜力。

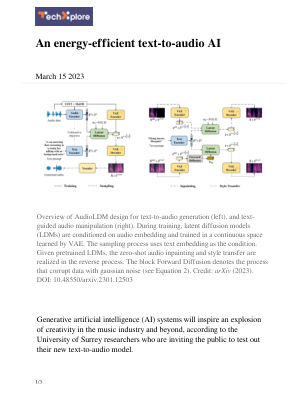

节能的文本转音频 AI

AudioLDM 设计概览,用于文本到音频生成(左)和文本引导的音频处理(右)。在训练期间,潜在扩散模型 (LDM) 以音频嵌入为条件,并在 VAE 学习的连续空间中进行训练。采样过程使用文本嵌入作为条件。给定预训练的 LDM,零样本音频修复和风格迁移以反向过程实现。前向扩散块表示用高斯噪声破坏数据的过程(参见公式 2)。来源:arXiv (2023)。DOI:10.48550/arxiv.2301.12503

svg:3D立体视频生成...

视频生成模型已经证明了产生令人难以置信的单眼视频的功能,但是,3D立体视频的产生仍然不足。我们提出了一种使用现成的单眼视频生成模型的无姿势和无训练方法,用于发电3D立体视频。我们的方法使用估计的视频深度将生成的单眼视频扭曲到立体基线的相机视图中,并采用了一种新型的框架矩阵视频介绍框架。该框架利用视频代理模型来从不同的时间戳和视图中观察到的框架。这种有效的方法会产生一致且具有语义相干的立体视频,而无需场景优化或模型调整。此外,我们开发了一个不合格的边界重新注射方案,该方案通过减轻潜在空间中分离的区域传播的负面影响进一步提高视频介绍的质量。我们通过对包括Sora(Brooks等,2024),Lumiere(Bar-Tal等,2024),Walt(Gupta等,2023)和Zeroscope(Wang等人(Wang et al。,2023A)的视频进行实验来验证我们提出的方法的效率。实验表明我们的方法比以前的方法具有显着改善。项目页面https://daipengwa.github.io/svg_projectpage/

来自恶化视频的非接触性心率测量

摘要 - 转机光绘画学(RPPG)提供了一种最先进的非接触式方法,用于通过分析面部视频来估算人类脉搏。尽管具有潜力,但RPPG方法仍可能会受到各种伪影的影响,例如噪声,倾斜度和其他由太阳镜,口罩甚至非自愿面部接触引起的障碍物,例如个人无意间接触脸。在这项研究中,我们将图像处理转换应用于有意降低视频质量,模仿这些具有挑战性的条件,并随后评估非学习和基于学习的RPPG方法在衰落的数据上的表现。我们的结果表明,在存在这些人工制品的情况下,准确性显着降低,促使我们提出了恢复技术的应用,例如denois和inpainting,以改善心率的估计结果。通过解决这些具有挑战性的条件和遮挡伪像,我们的方法旨在使RPPG方法更加健壮,适合现实情况。为了评估我们提出的方法的有效性,我们对三个公开可用的数据集进行了全面的实验,其中包括各种场景和人工制品类型。我们的发现强调了通过采用最佳恢复算法和RPPG技术的最佳组合来构建强大的RPPG系统的潜力。此外,我们的研究为注重隐私意识的RPPG方法的发展做出了贡献,从而在现实和多样化的条件下加强了这项创新技术在远程心率估计领域的总体实用性和影响。索引术语 - 记录光摄影学,图像变速器,插入,远程医疗

纹理特征提取方法:调查

抽象的纹理分析用于非常广泛的场和应用,从纹理分类(例如,用于遥感)到分割(例如,在生物医学成像中),通过图像合成或模式识别(例如,用于图像inpainting)。对于这些图像处理过程中的每一个,首先,必须从原始图像中提取描述纹理属性的象征性特征。在过去的几十年中,已经提出了各种特征提取方法。每个人都有其优点和局限性:其中一些的性能不是通过翻译,旋转,affin和perspective变换来修改的;其他人的计算复杂性低;其他人再次容易实施;等等。本文对纹理特征提取方法进行了全面的调查。后者分为七个类:统计方法,结构方法,基于转换的方法,基于模型的方法,基于图形的方法,基于学习的方法和基于熵的方法。对于这七个类中的每种方法,我们介绍了概念,优势和缺点,并给出了应用程序的示例。这项调查使我们能够确定两类方法,特别是在将来值得关注的方法,因为它们的表现似乎很有趣,但是他们的详尽研究尚未进行。

igflow:从头抗体设计的流匹配

在这项工作中,我们提出了IGFlow,这是抗体结构从头设计的SE(3)流量匹配模型。我们专注于生成抗体的新型可变结构域区域,并评估模型在1)无条件重链和轻链生成以及2)互补性确定区域(CDRS)的框架条件循环设计。我们的结果表明,IgFlow生成的抗体在结构上与自然观察到的抗体相似。我们将我们的方法与IGDIFF进行了比较,IGDIFF是一种无条件变量域生成的SE(3) - 扩散模型,在可设计性上。此外,我们在抗体设计中通常遇到的两个有条件的CDR介入任务上对IGFLOW和IGDIFF进行了基准测试。我们发现,Igdiff和Igflow在无条件设计抗体时都表现出色,并且IGFlow有条件地设计具有比IGDIFF更高自符合性的完整CDR循环。总体而言,我们的方法为抗体生成提供了另一种方法,具有其他计算益处,包括样本数据效率和推理速度。

补偿抽样,以改善扩散模型的收敛性

摘要。扩散模型在图像一般方面具有出色的质量,但以一定的代价。迭代denoising需要许多时间步骤来产生高保真图像。由于目标数据的初始不准确重建,重建误差的积累至关重要的限制。这会导致质量降低,收敛速度较慢。为了解决这些问题,我们提出了补偿抽样,以指导生成目标领域。我们引入了一个用U-NET实施的薪酬术语,该薪酬添加了可忽略的培训间接费用。我们的方法是灵活的,我们将其在基准数据集Cifar-10,Celeba,Celeba-HQ,FFHQ-256和FSG上的无条件生成,面对介绍和面对外划分中的应用。我们的方法始终从图像质量方面产生最先进的结果,同时加速了在训练过程中以最高数量级收敛的转化过程。

cheapnvs:实时在设备上狭窄的基线新型视图综合

摘要 - 各种视图的新视图合成(NVS)是由于其规模不足而臭名昭著的概率,并且通常需要大型,计算昂贵的方法来产生切实的结果。在本文中,我们提出了CheapNVS:基于新颖,有效的多个编码器/解码器设计的狭窄基线单视NVS的完全端到端方法,该方法以多阶段的方式训练。cheapnvs首先近似于在目标视图的摄像头姿势嵌入在摄像头姿势嵌入的轻巧可学习模块的费力3D图像翘曲,然后在遮挡的区域进行介绍,并并行,以实现显着的性能增长。一旦接受了开放式图像数据集的一部分训练,便宜的NVS却超过了最先进的图像,尽管更快的速度更快,并且记忆力少6%。此外,CheapNVS在移动设备上实时舒适地运行,在Samsung Tab 9+上达到30 fps。索引术语 - Novel视图合成; 3D摄影

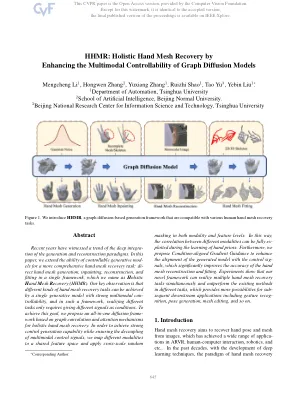

HHMR:通过增强图扩散模型的多模式可控性

近年来见证了一代和重建范式深入融合的趋势。在本文中,我们扩展了可控制的生成模块的能力,以实现更全面的手网恢复任务:在单个框架中,手工网格的生成,内部网状,重建,重建和拟合,我们将其命名为H olistic H和MESH R Ecovery(HHMR)。我们的主要观察结果是,具有强大多模式可偿还性的单个生成模型可以实现不同类型的手网恢复任务,并且在这样的框架中,实现不同的任务只需要给出不同的信号作为条件。为了实现这一目标,我们提出了基于图形卷积和整体手工网状恢复的注意力卷积和注意力机制的多合一扩散框架。为了实现强大的控制能力,同时确保多模式控制信号的解耦,我们将不同的模态映射到共享特征空间并应用跨尺度随机