XiaoMi-AI文件搜索系统

World File Search System人工智能安全的关键概念:机器学习的可解释性

现代机器学习系统在自动化决策中越来越普遍,涵盖了私人和公共领域的各种应用。随着这种趋势的持续,机器学习系统的部署越来越缺乏人类监督,包括在其决策可能对人们的生活产生重大影响的领域。这些领域包括自动信用评分、医疗诊断、招聘和自动驾驶等。1 与此同时,机器学习系统也变得越来越复杂,很难分析和理解它们如何得出结论。这种复杂性的增加——以及随之而来的可解释性的缺乏——对在高风险环境中使用机器学习系统提出了根本挑战。

标签外疫苗的使用:国家的解释性注释

疫苗的许可和注册程序以及使用注册和疫苗许可及其使用建议的建议及其使用的建议基于单独但相关的程序。在将疫苗投放市场之前,他们需要获得国家监管局(NRA)的市场授权。NRA根据制造商提供的档案来评估疫苗的质量,安全性和功效。NRA然后评估所有可用的数据,以了解疫苗所需的(益处)和不良影响(风险),并对潜在的不良影响产生有益效果。当NRA决定有足够的证据表明疫苗制造质量一致,并且有足够的疗效和安全性数据,NRA授权将疫苗用于疫苗产品信息表中概述的给定指示。疫苗产品信息表,也称为疫苗标签,由制造商拥有,但由NRA监督。一旦T疫苗标签被NRA(通常是国家免疫技术咨询小组(NITAG))NRA批准,可以发出用于使用疫苗的公共卫生建议。

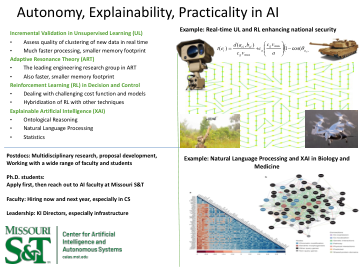

空中战术多代理增强学习中的解释性

人工智能(AI)在塑造未来的技术景观方面至关重要。多机构增强学习(MARL)已成为一种重要的AI技术,用于模拟各个领域的复杂动态,从而为自主代理之间的先进战略计划和协调带来了新的潜力。但是,其在敏感军事环境中的实际部署受到缺乏解释性的限制:可靠性,安全性,战略验证和人机相互作用的关键因素。本文回顾了MARL内解释性的最新进步,并提出了新颖的用例,强调了其不可或缺的检查代理决策过程。我们首先对现有技术进行了严格评估,并将其与军事策略的领域联系起来,重点是模拟空中战斗场景。然后,我们介绍了一种新型信息理论解释性描述符的概念,以分析代理人的合作能力。通过我们的研究,我们旨在强调精确理解AI决策并将这些人为产生的策略与人类理解和战略军事教义保持一致的必要性,从而提高AI系统的透明度和可靠性。通过阐明解释性在推进MARL进行操作防御方面的关键重要性,我们的工作不仅支持战略计划,而且还支持对军事人员进行洞察力和可理解的分析的培训。

2025 USDA解释性笔记 - 国家食品和农业研究所

该部门的高等教育任务是与州,大学和私营部门进行的强大联盟。naretpa指定美国农业部为粮食和农业科学领域的高等教育联邦高等教育机构。通过NIFA,USDA通过各种计划,以将教学,研究和扩展联系起来,实施了这一指控。改善食品和农业科学家和专业人士的培训;并加强全国教育计划的质量。Naretpa的第1417条(美国法典第7条 FCEA第7106条对3152)进行了修改,以提供哥伦比亚大学的资格,以获得食品和农业科学教育的赠款和奖学金。 该计划也受Naretpa中发现的规定的约束;酒吧 L. 97-98;酒吧 1985年的《粮食安全法》(Pub。 L. 99-198); 1890年的《第二莫里尔法案》; 1988年6月17日的法案,(Pub。 L. 100-339);事实行为; 1994年的教育土地奖励地位法案(Pub。) L. 103-382);公平行为; areera;酒吧 L. 106-78,2001年11月19日的航空和运输安全法案(Pub。) L. 107-71)和2003年12月6日的国家兽医医疗服务法 L. 108-161)(NVMSA)。Naretpa的第1417条(美国法典第7条FCEA第7106条对3152)进行了修改,以提供哥伦比亚大学的资格,以获得食品和农业科学教育的赠款和奖学金。该计划也受Naretpa中发现的规定的约束;酒吧L. 97-98;酒吧1985年的《粮食安全法》(Pub。L. 99-198); 1890年的《第二莫里尔法案》; 1988年6月17日的法案,(Pub。L. 100-339);事实行为; 1994年的教育土地奖励地位法案(Pub。L. 103-382);公平行为; areera;酒吧L. 106-78,2001年11月19日的航空和运输安全法案(Pub。L. 107-71)和2003年12月6日的国家兽医医疗服务法L. 108-161)(NVMSA)。

机器学习专家是否讨论过人工智能系统的可解释性?

对于希望在行业中脱颖而出的所有公司来说,在不同领域应用人工智能 (AI) 工具正成为必修课。成功应用人工智能的一个主要挑战是将机器学习 (ML) 专业知识与领域知识相结合,以获得应用人工智能工具的最佳效果。领域专家了解数据以及数据如何影响他们的决策。ML 专家能够使用基于 AI 的工具处理大量数据并为领域专家提供见解。但如果不深入了解数据,ML 专家就无法调整他们的模型以获得特定领域的最佳结果。因此,领域专家是 ML 工具的主要用户,这些 AI 工具的可解释性成为该背景下的重要特征。人们为研究不同背景、用户和目标的 AI 可解释性付出了很多努力。在这篇立场文件中,我们讨论了关于 ML 专家如何在定义要为特定领域开发的 ML 工具的功能时表达对 AI 可解释性的担忧的有趣发现。我们分析了两次头脑风暴会议的数据,讨论了 ML 工具的功能,以支持地球科学家(领域专家)使用 ML 资源分析地震数据(特定领域数据)。

人工智能模型可解释性的理论框架及其在生物医学中的应用

摘要 — 可解释人工智能 (XAI) 是人工智能界一个充满活力的研究课题。它引起了各种方法和领域的关注,尤其是那些涉及高风险决策的领域,例如生物医学领域。关于这个主题的文章已经很多,但 XAI 仍然缺乏共享的术语和能够为解释提供结构合理性的框架。在我们的工作中,我们通过提出一种新颖的解释定义来解决这些问题,该定义综合了文献中的内容。我们认识到解释不是原子的,而是来自模型及其输入输出映射的证据与人类对这些证据的解释的组合。此外,我们将解释纳入忠实性(即,解释是对模型内部运作和决策过程的准确描述)和可信度(即,解释对用户的说服力有多大)的属性中。我们的理论框架简化了这些属性的操作方式,并为我们作为案例研究分析的常见解释方法提供了新的见解。我们还讨论了我们的框架可能对生物医学产生的影响,这是一个非常敏感的应用领域,XAI 可以在建立信任方面发挥核心作用。索引术语 — 可解释性、机器学习、生物医学

解释性项目指南 - 美国农业部森林服务局

解释是值得的。但很容易做得不好。错误的信息、错误的地方、枯燥的文字、令人困惑的插图、技术问题、太简单、太复杂、重复的主题……任何一个小问题都可能使一个好主意变成访问者忽略或不理解的东西。避免这种情况的最好方法是真正坐下来仔细考虑你的项目——诚实地审视它——并找到和使用你需要的所有技能来实现它。最重要的是,解释是有原因的,也是有结果的。

视觉变形金刚的解释性:全面审查和新观点

变形金刚对自然语言处理产生了重大影响,最近证明了它们在计算机视觉中的潜力。他们在基本的计算机视觉任务中显示了卷积神经网络的有希望的结果。然而,科学界并未完全掌握视觉变形金刚的内部运作,也没有做出决策的基础,这强调了解释性方法的重要性。了解这些模型如何做出决定不仅可以改善其绩效,还可以建立对AI系统的信任。本研究探讨了为视觉变压器提出的不同解释性方法,并提出了根据其动机,结构和应用方案组织它们的分类法。此外,它提供了对评估标准的全面审查,可用于比较解释结果以及解释性工具和框架。最后,本文重点介绍了可以增强视觉变形金刚的解释性的基本但未开发的方面,并建议有前途的研究方向以进行未来的投资。关键字:解释性,视觉变压器,VIT,注意力,修剪。

第二补充预算2024年至2025年:解释性注释

支付分配主要支出组(MEGS)£M健康与社会护理171.914住房和地方政府53.395教育29.718运输1.069气候变化和农村事务2.170经济,能源和计划1.270社会正义0.251中央服务和行政