机构名称:

¥ 1.0

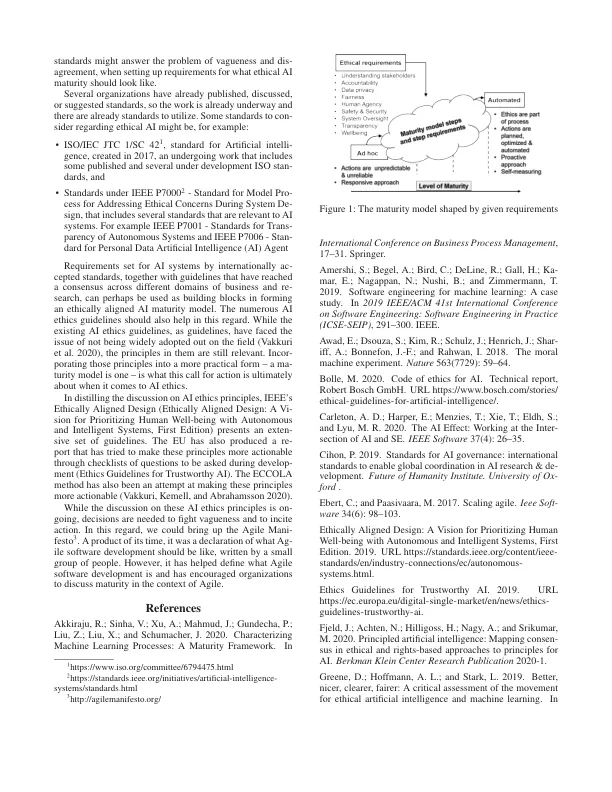

人们似乎普遍认为,当涉及到配备某种人工智能 (AI) 的系统时,道德问题非常重要。各方都提出了道德 AI 的要求。作为回应,近年来,公共机构、政府和大学纷纷提供一套在设计和使用基于 AI 的系统时需要考虑的原则。然而,我们已经了解到,高级原则并不容易转化为对从业人员可行的建议。因此,公司也在发布自己的道德准则来指导他们的 AI 开发。本文认为,AI 软件仍然是软件,需要从软件开发的角度来处理。软件工程范式引入了成熟度模型思维,为公司从被称为关键能力的选定观点提高绩效提供了路线图。我们希望呼吁采取行动,开发人工智能软件的成熟度模型。我们希望讨论是否应该关注人工智能伦理,或者更广泛地说,关注人工智能系统的质量,即人工智能系统开发的成熟度模型。

现在是人工智能(伦理)成熟度模型的时候了