机构名称:

¥ 1.0

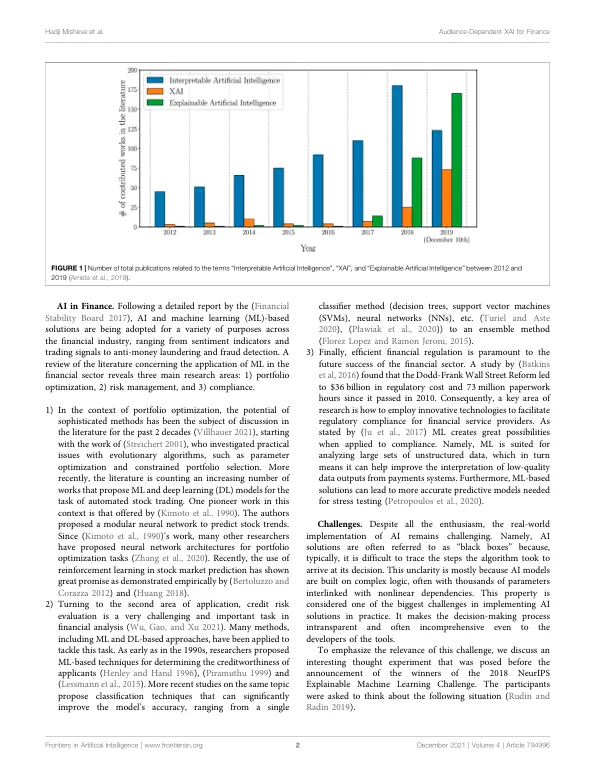

人工智能 (AI) 是金融行业最受追捧的创新之一。然而,随着它的日益普及,人们也呼吁基于 AI 的模型变得易于理解和透明。但是,以可理解的方式解释算法的内部机制及其解释完全取决于受众。现有文献未能将越来越多的可解释人工智能 (XAI) 方法与不同利益相关者的可解释性需求相匹配。本研究通过探讨瑞士金融行业内的各个利益相关者如何在各自的背景下看待可解释性来解决这一差距。基于对金融行业从业人员的一系列访谈,我们深入回顾并讨论了他们对当前 XAI 技术在满足不同解释要求方面的潜力和局限性的看法。

基于人工智能的风险管理工具的受众相关解释:一项调查