机构名称:

¥ 14.0

• 定义与 AI 系统相关的关键术语和概念,以及其目的和预期用途的范围。• 将 AI 治理与现有的组织治理和风险控制联系起来。• 与更广泛的数据治理政策和实践保持一致,特别是敏感或其他风险数据的使用。• 详细制定实验设计、数据质量和模型训练的标准。• 概述和记录风险映射和测量流程和标准。• 详细说明模型测试和验证流程。• 详细审查法律和风险职能的流程。• 确定监控、审计和审查流程的频率和细节。• 概述变更管理要求。• 概述内部和外部利益相关者参与的流程。• 制定举报政策,以促进对严重 AI 系统问题的报告。• 详细说明并测试事件响应计划。• 验证正式的人工智能风险管理政策是否符合现有法律标准以及行业最佳实践和规范。• 制定与人工智能系统可信特征大致一致的人工智能风险管理政策。• 验证正式的人工智能风险管理政策是否包括当前部署的和第三方人工智能系统。

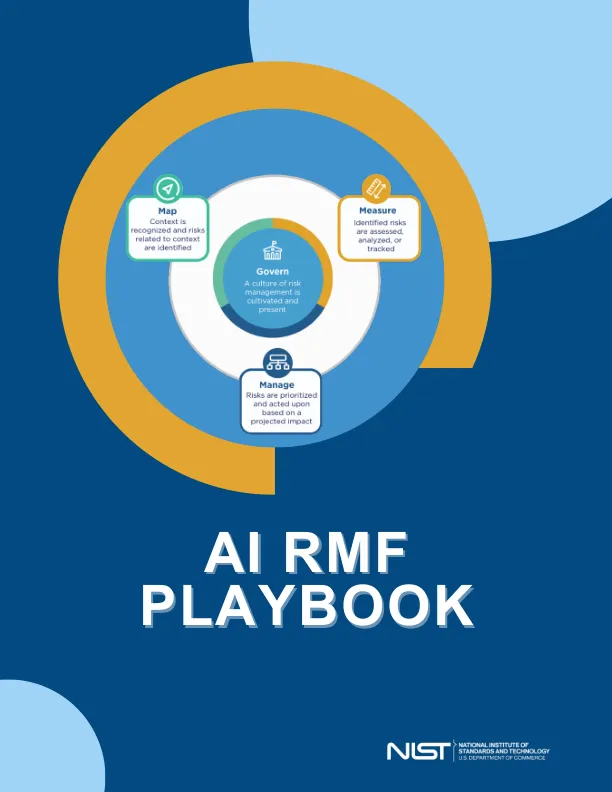

AI RMF PLAYBOOK