机构名称:

¥ 1.0

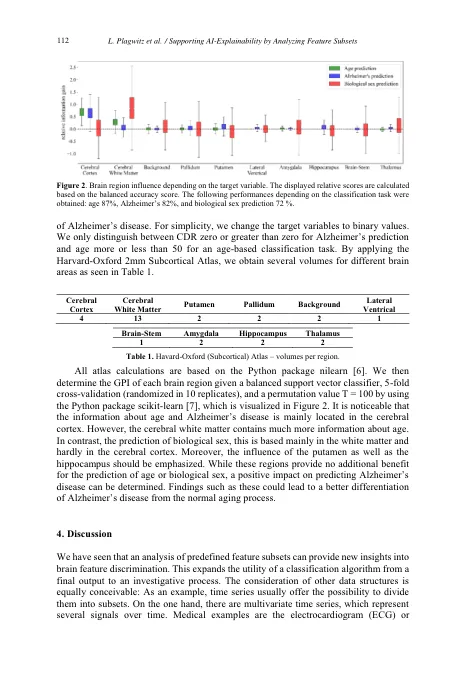

无论是在临床研究还是风险因素计算中,机器学习算法都可以在许多医学领域中找到。这给这些算法的使用带来了重大挑战 - 特别是在伦理背景方面 - 如监管方面、可解释性或互操作性 [1]。对于这项工作,我们提出了一个关于特征贡献可解释性的特殊观点。也就是说,这不应被视为一种应用手段,而是一种更好地理解潜在问题的方法。我们的重点是人类可理解的特征子组及其各自的重要性分数的组合。特征重要性分析是机器学习模型检查和解释的主要组成部分。问题出现在解决问题的基础之上,例如在分类中,为什么对某个类别的决定是那样的。这种分析背后的方法可能因问题和模型的不同而有很大差异。我们接下来重点介绍置换重要性分析 [2]。在这里,基于测试集分析预测准确度的变化。对正在研究的特征进行置换,并将预测与未修改的特征进行比较。因此,该方法不依赖于预测过程的具体实现,因此可以应用于任何基于特征的监督机器学习模型。

通过分析机器学习模型中的特征子集来支持人工智能可解释性

主要关键词