机构名称:

¥ 1.0

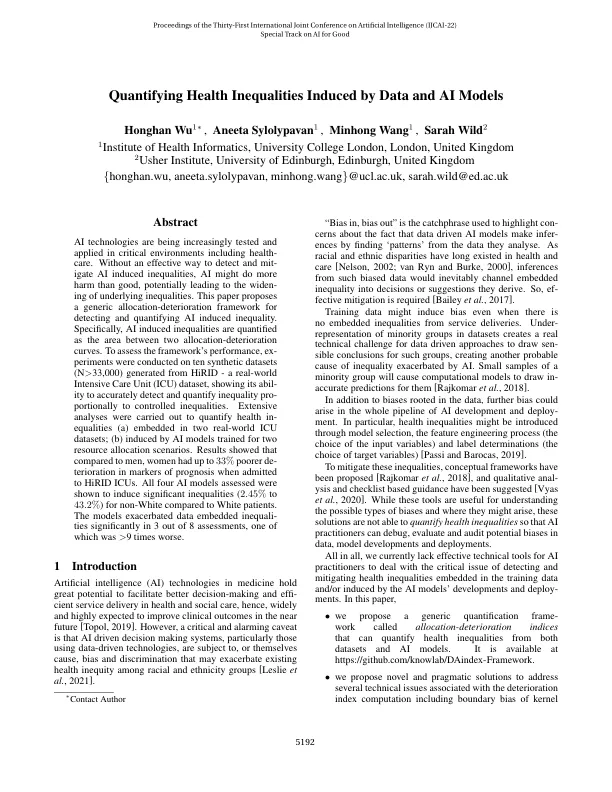

人工智能技术正越来越多地在包括医疗保健在内的关键环境中进行测试和应用。如果没有有效的方法来检测和减轻人工智能引起的不平等,人工智能可能会弊大于利,有可能导致潜在不平等的扩大。本文提出了一个通用的分配-恶化框架,用于检测和量化人工智能引起的不平等。具体来说,人工智能引起的不平等被量化为两个分配-恶化曲线之间的面积。为了评估该框架的性能,在由 HiRID(一个现实世界的重症监护病房 (ICU) 数据集)生成的十个合成数据集 (N > 33,000) 上进行了实验,结果表明它能够准确检测和量化与受控不平等成比例的不平等。进行了广泛的分析以量化健康不平等(a)嵌入在两个现实世界的 ICU 数据集中;(b)由针对两种资源分配场景训练的人工智能模型引起。结果显示,与男性相比,女性在入住 HiRID ICU 时预后指标恶化程度最高低 33%。评估的所有四种 AI 模型都表明,非白人患者与白人患者之间存在显著的不平等(2.45% 至 43.2%)。在 8 次评估中的 3 次中,这些模型显著加剧了数据嵌入不平等,其中一次恶化程度超过 9 倍。

量化数据和人工智能模型引起的健康不平等

主要关键词