机构名称:

¥ 1.0

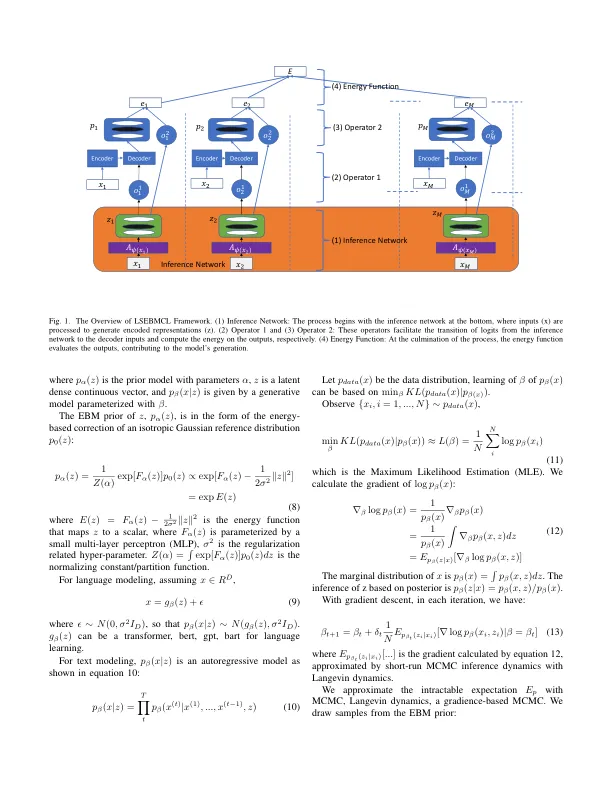

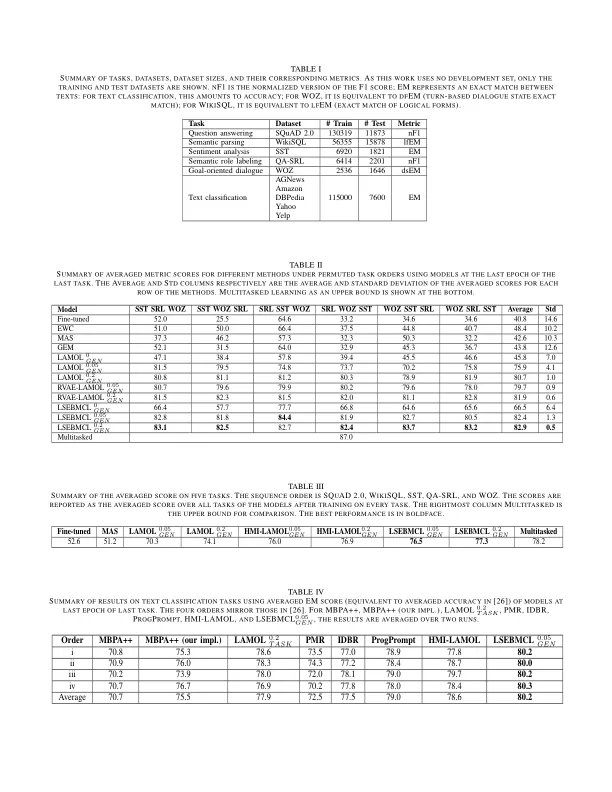

摘要 — 持续学习已成为许多实际应用(例如在线新闻摘要和产品分类)中必不可少的部分。主要挑战被称为灾难性遗忘,即模型在接受新任务训练时无意中丢弃先前学习的知识的现象。现有的解决方案包括存储以前类别的样本、在微调过程中规范参数或为每个任务分配不同的模型参数。这项工作中提出的解决方案 LSEBMCL(基于潜在空间能量的持续学习模型)是使用基于能量的模型 (EBM) 来防止灾难性遗忘,方法是在对新任务进行训练时从先前的任务中采样数据点。EBM 是一种将能量值与每个输入数据点相关联的机器学习模型。所提出的方法使用 EBM 层作为 NLP 任务持续学习框架中的外部生成器。该研究证明了 EBM 在 NLP 任务中的有效性,在所有实验中都取得了最先进的结果。索引词——持续学习、基于能量的模型、灾难性遗忘、问答、语言生成

基于潜在空间能量的持续学习模型

主要关键词