机构名称:

¥ 1.0

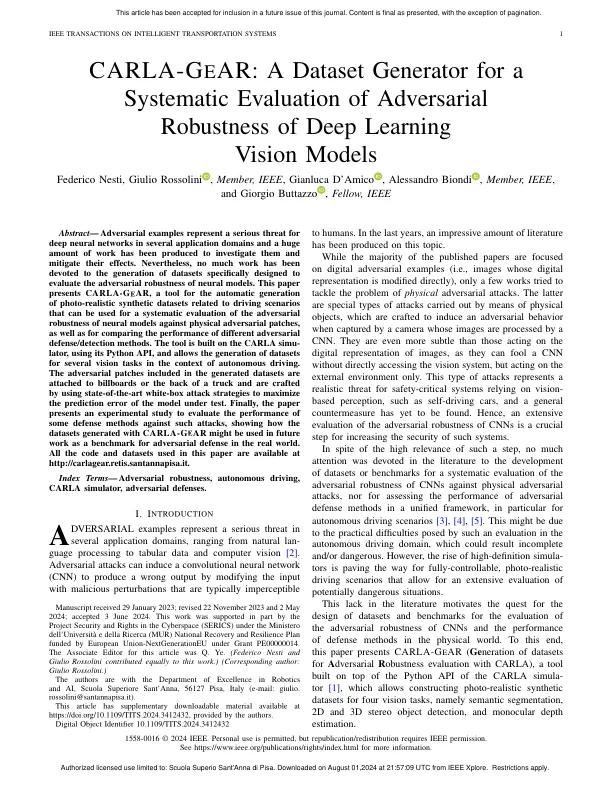

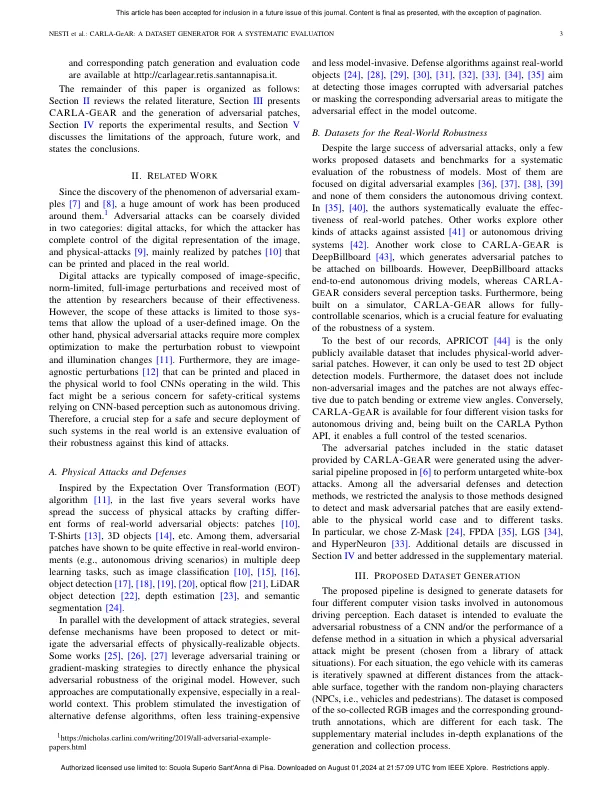

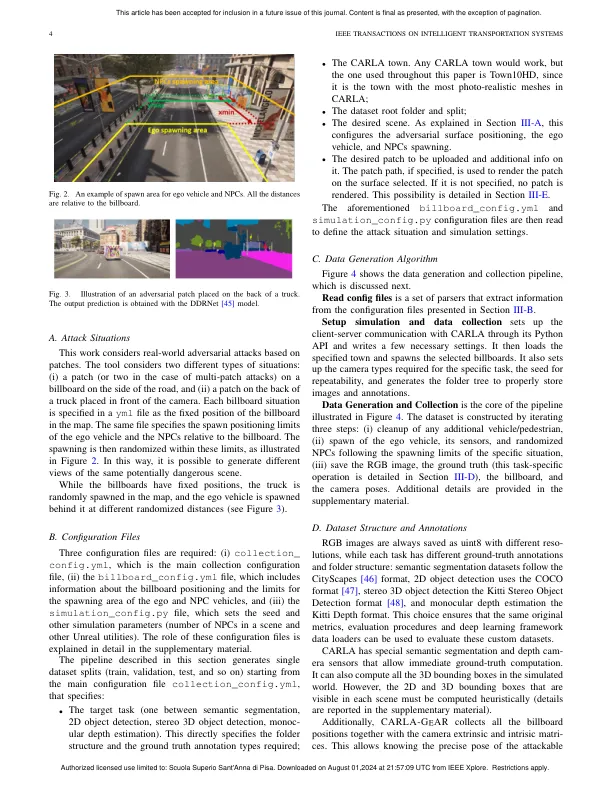

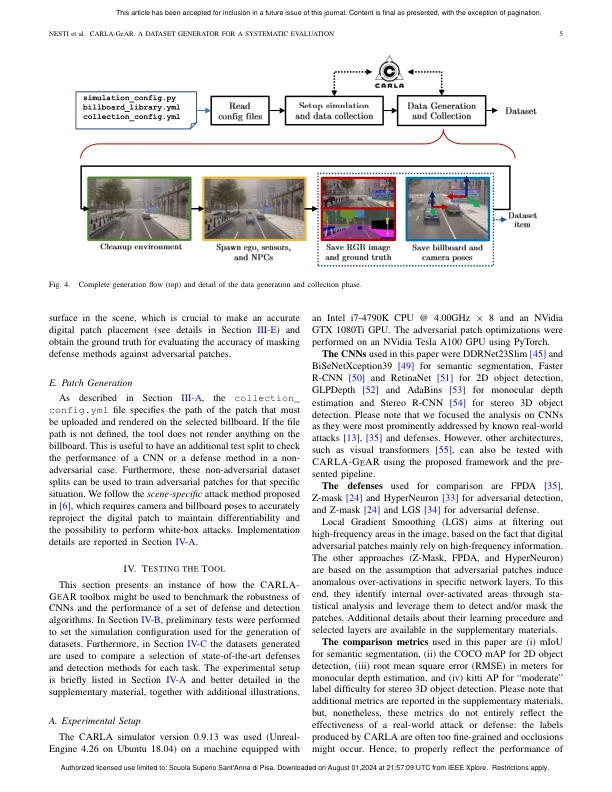

摘要 - 对抗性示例代表了几个应用程序域中深层神经网络的严重威胁,并且已经制作了大量的工作来调查它们并减轻其效果。尽管如此,没有太多的工作专门用于评估神经模型的对抗性鲁棒性的数据集的生成。本文介绍了Carla-g Ear,这是一种自动生成与驾驶场景相关的照片真实合成数据集的工具,这些数据集可用于系统评估神经模型的对抗性鲁棒性,以针对物理对抗性斑块,以及比较不同对抗性防御/检测方法的性能。该工具是使用其Python API建立在Carla Simulator上的,并允许在自动驾驶的背景下生成数据集来完成多个视觉任务。生成的数据集中包含的对抗贴片连接到广告牌或卡车的背面,并通过使用最先进的白色盒子攻击策略来制定,以最大程度地提高测试模型的预测错误。最后,本文提出了一项实验研究,以评估某些防御方法针对此类攻击的性能,以表明如何将使用Carla-g e AR生成的数据集用作现实世界中对抗性防御的基准。本文中使用的所有代码和数据集可在http://carlagear.retis.santannapisa.it上获得。

Carla -Gear -Iris

主要关键词