机构名称:

¥ 1.0

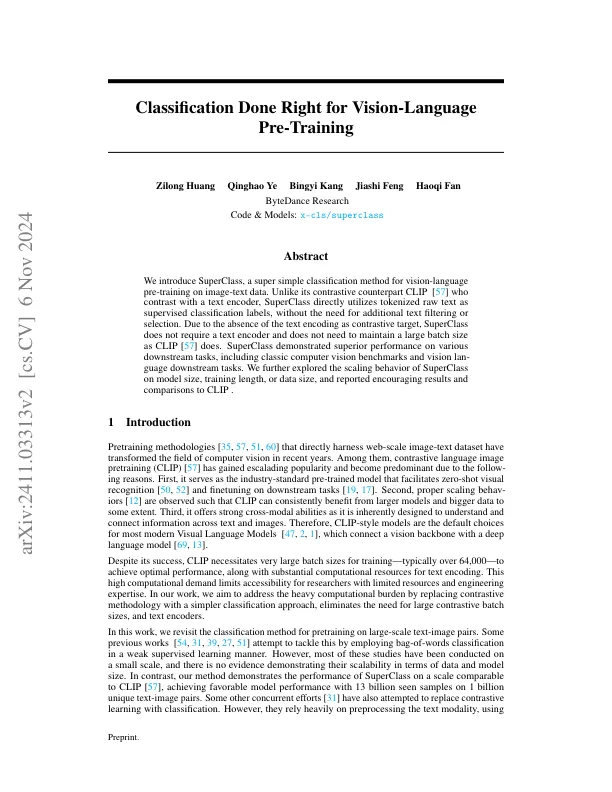

我们介绍了超类,这是一种超级简单的分类方法,用于对图像文本数据进行视觉预训练。与与文本编码器对比的对比度剪辑[57]不同,SuperClass直接利用令牌化的原始文本作为监督分类标签,而无需其他文本过滤或选择。由于没有文本编码为对比目标,超级类不需要文本编码器,也不需要像夹子[57]那样保持较大的批量大小。超类在各种下游任务上表现出卓越的性能,包括经典的计算机视觉基准和下游任务的视觉语言。我们进一步探索了超类对模型大小,训练长度或数据大小的缩放行为,并报告了令人鼓舞的结果和剪辑比较。

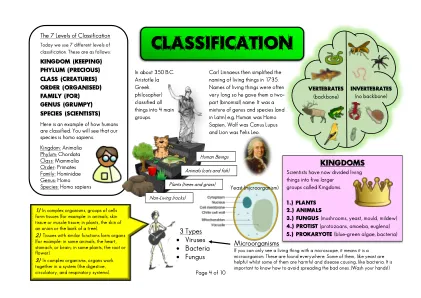

对视力语言预训练的正确分类