机构名称:

¥ 1.0

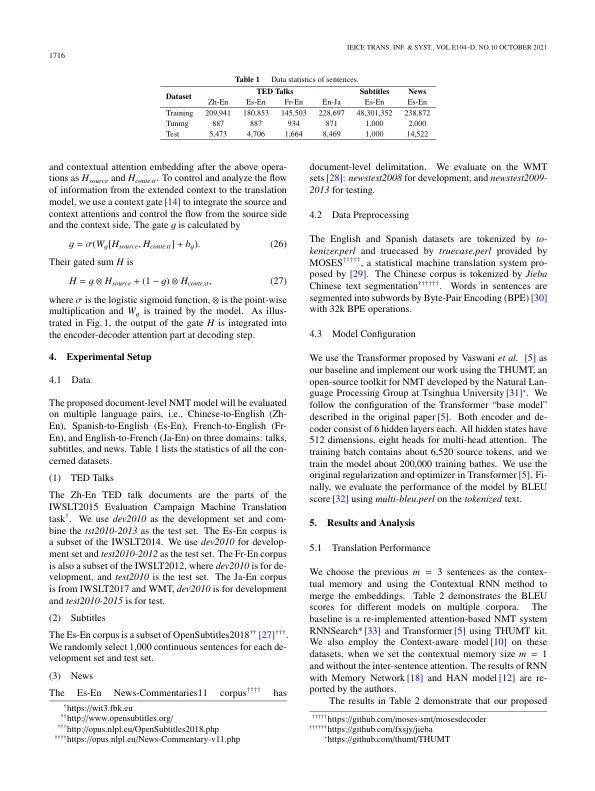

摘要标准神经机器翻译(NMT)是关于文档级上下文是独立的。大多数现有的文档级别的NMT方法都充满了全局文档级信息感,而这项工作着重于在内存网络中利用详细的文档级别上下文。从内存中检测到当前句子中最相关部分的内存网络的容量,这是一种自然解决方案,可以对丰富的文档级上下文进行建模。在这项工作中,实现了拟议的文档感知内存网络,以增强变压器NMT基线。对几个任务的实验表明,所提出的方法显着提高了强大变压器基准和其他相关研究的NMT性能。关键词:内存网络,神经机器翻译,文档级上下文

纸质文档级神经机器与关联的内存网络∗